原文链接:https://zhuanlan.zhihu.com/p/2010009557003425240

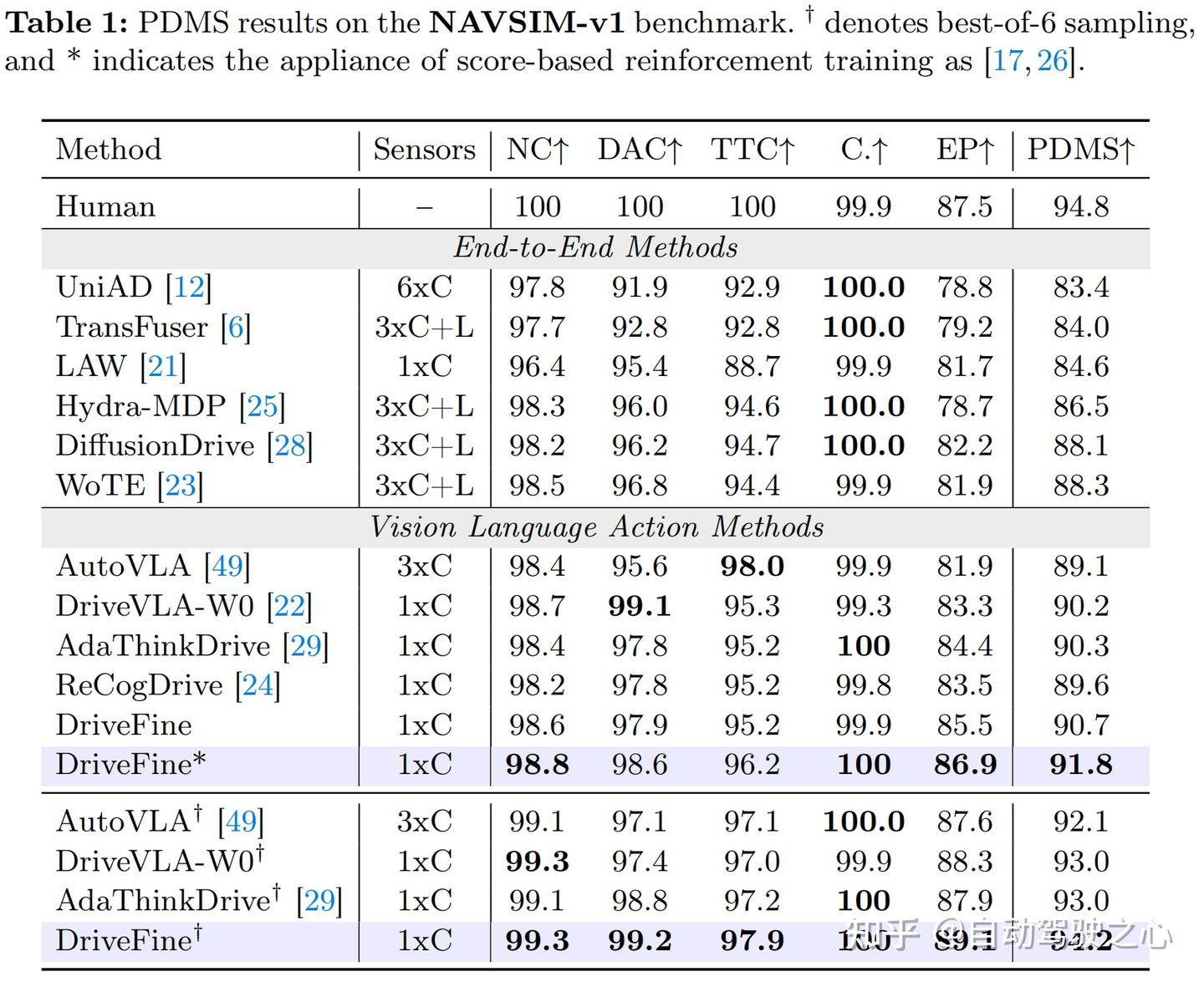

华科、小米和清华AIR的一篇VLA工作,比较有意思。和以往VLA的方法不同,本文是利用扩散语言模型实现的VLA,最终效果很不错,超越了DriveVLA-W0,PDMS达到了94.2,做这个方向的小伙伴可以重点关注下,感觉近几个月会是热点。

现有自动驾驶的VLA模型的训练大多是经模仿学习训练、再结合强化学习优化的生成式规划器。基于扩散模型的规划器存在模态对齐困难、训练效率低下和泛化能力有限的问题,而基于token的规划器则受困于累积因果误差与不可逆解码的缺陷。综上,这两种主流范式的优势与劣势具有互补性。本文提出DriveFine —— 融合了灵活解码与自校正能力的掩码扩散VLA模型。具体而言,设计了一种全新的即插即用的block-MoE架构,在生成专家模块之上无缝嵌入精修专家模块。通过在推理阶段实现显式的专家选择、在训练阶段进行梯度阻断,两个专家模块实现完全解耦,保留了预训练权重的基础能力与通用模式,这也凸显了block-MoE设计的灵活性和可扩展性。此外,我们设计了一种混合强化学习策略,在保证训练稳定性的同时,促进精修专家模块的有效探索。在NAVSIM v1、v2和Navhard基准数据集上的大量实验表明,DriveFine展现出优异的性能和鲁棒性。

背景回顾

用于自动驾驶(AD)的视觉-语言-动作(VLA)系统整合了传感器观测数据与文本指令,由规划器负责生成驾驶动作或轨迹。早期的确定性规划器(如基于多层感知器(MLP)或基于锚点的分类器)倾向于模仿单一的专家轨迹,难以应对分布偏移问题,也无法捕捉驾驶行为固有的多模态特性。

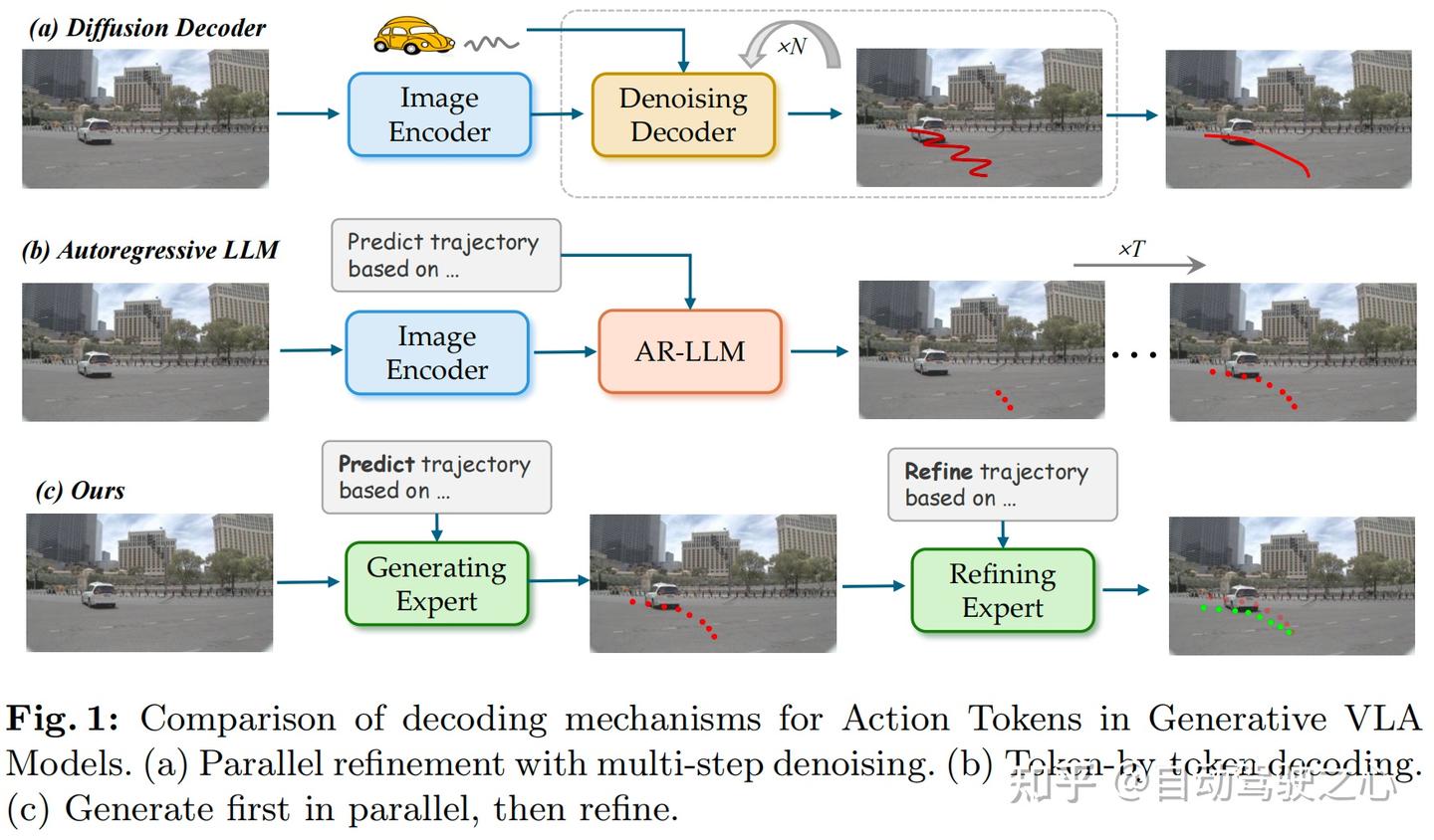

近期,非确定性生成式规划器已成为自动驾驶VLA领域的主流范式。这类规划器将动作预测为概率分布,能有效捕捉驾驶行为的多模态特征。此外,其与生俱来的采样能力可支持主动探索,并能与基于规则的强化学习策略(如GRPO)无缝结合,为策略学习提供指导。当前最先进的生成式VLA模型可分为两类:采用连续动作建模的基于扩散模型的规划器,以及采用离散动作表征的基于token的规划器。

(1)基于扩散模型的VLA模型:构建马尔可夫链,通过预测噪声轨迹的均值和方差,对其进行迭代精修,实现并行解码,提升了效率,但额外的扩散变换器会阻碍跨模态对齐,导致训练效率低下,通常需要数百个训练轮次才能收敛。此外,基于扩散模型的规划器本质上是条件生成模型,这限制了其鲁棒性和泛化能力——实验结果表明,当采用面向PDMS的强化微调时,这类规划器的EPDMS指标会出现显著下降。PDMS和EPDMS均为NAVSIM数据集提供的评价指标。我们认为,性能退化的原因在于扩散规划器与视觉-语言模型(VLM)之间的耦合性较弱,这会引发奖励投机行为,并导致预训练知识丢失,极大限制了其实际应用价值。

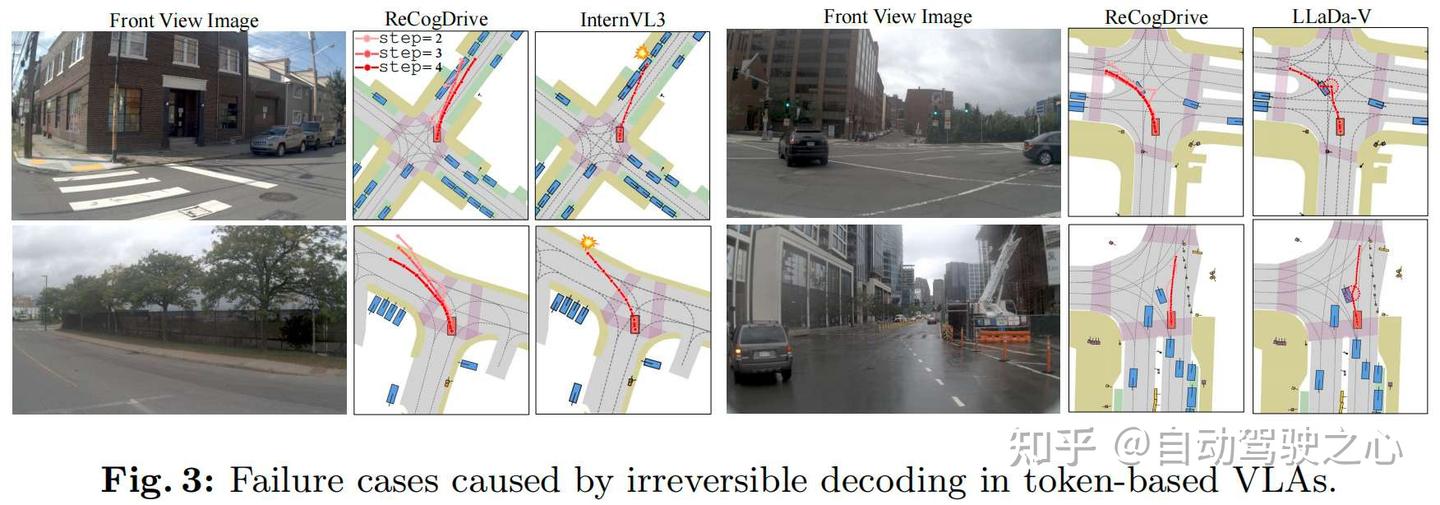

(2)基于token的VLA模型:将动作自回归解码为预定义词汇表中的token,实现了视觉、语言和动作的统一表征。实验表明,对InternVL模型进行面向PDMS的强化微调时,其PDMS和EPDMS指标会同步提升,体现出更强的泛化能力和可扩展性。但这类模型在性能和效率上整体落后于基于扩散模型的同类模型,主要原因是其采用的因果注意力机制和固定的逐token解码方式计算成本高昂,且推理过程中易产生误差累积。更关键的是,这类模型继承了大语言模型的不可逆解码特性:token一旦解码完成便无法修改。而驾驶规划对噪声高度敏感,哪怕是点位级的偏差,也可能导致整个轨迹规划失败,例如引发碰撞或车辆驶离道路。

近期有研究探索将掩码扩散大语言模型(dLLMs)应用于自动驾驶,该模型支持更灵活的解码顺序,但这种灵活性进一步加剧了不可逆解码的问题:早解码的token缺乏全局一致性约束,更易成为异常值,且后续无法修正,最终导致轨迹级规划失败。与之相反,基于扩散模型的规划器会对轨迹进行迭代精修,通过连续的优化过程保证高质量的轨迹生成。

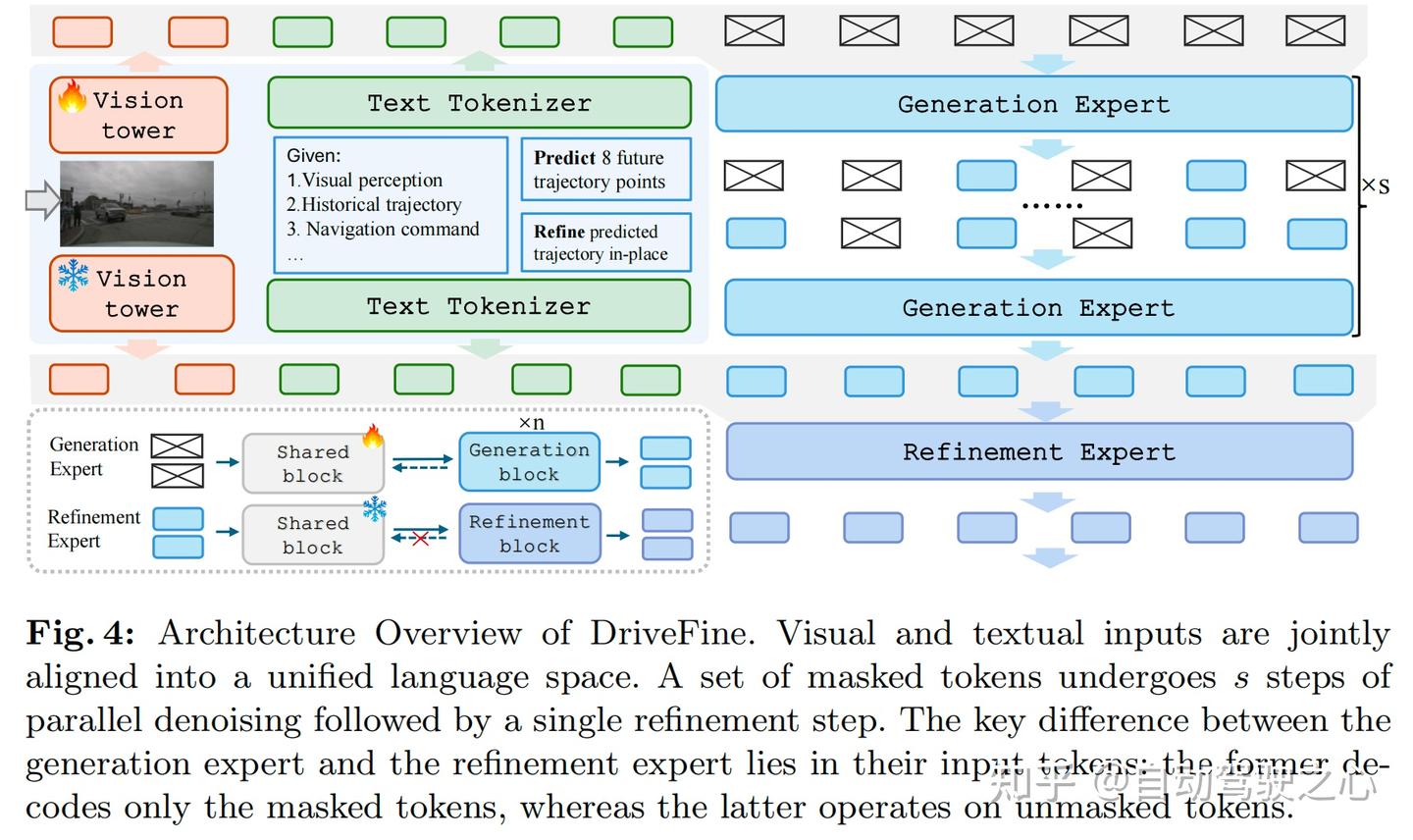

显然,两种VLA规划器的优劣势高度互补,这也促使我们探索一种能融合二者优势的模型。本文提出DriveFine,首次将显式的精修能力融入基于token的VLA模型,以实现更精准、更鲁棒的自动驾驶规划。我们采用预训练的多模态掩码扩散大语言模型(以LLaDA为大语言模型基础的LaViDa)作为基础规划器,相较于自回归大语言模型,该模型具备多项优势:并行解码提升效率、双向注意力实现更丰富的上下文建模、灵活的解码策略支持自适应学习。

为基于token的VLA模型融入精修能力并非易事,且需遵循若干原则:保留基础视觉-语言模型原有的训练和推理范式,防止其基础能力失效;最小化计算和参数量的额外开销;与轨迹生成模块解耦,避免相互干扰。显然,这带来了诸多挑战。

为此,我们设计了一种block-MoE架构。具体而言,大部分LLaDA块作为处理通用上下文的共享专家模块,剩余模块则被显式划分为生成专家模块和精修专家模块。推理阶段,模型会主动选择适用于特定任务的专家模块;训练阶段,精修分支的梯度流被严格限制在精修专家模块内,与生成专家模块解耦。这种显式的隔离设计保留了生成专家模块的基础能力,有效防止模式崩溃和跨任务干扰。

为契合主流技术流程,我们进一步提出一种在线-离线混合强化学习范式:生成专家模块采样一组轨迹,并通过GRPO算法进行强化优化;同时,将这些轨迹配对为离线锚点-目标轨迹元组。与之并行的是,精修专家模块对上述轨迹进行主动精修,计算相关奖励并生成在线轨迹元组,结合离线轨迹元组共同监督精修专家模块的训练。实验结果表明,块级混合专家架构在参数量小幅增加、推理开销轻微上升的情况下,显著提升了轨迹质量,突破了基于token的VLA模型的性能上限。

本文的核心贡献总结如下:

- 对主流的基于扩散模型和基于token的VLA规划器的优劣势进行了全面分析;

- 提出DriveFine模型,其核心的即插即用型块级混合专家(block-MoE)架构能以极低的成本为基于token的VLA模型注入精修能力;

- 设计了针对性的混合强化学习策略,进一步提升DriveFine的性能上限;

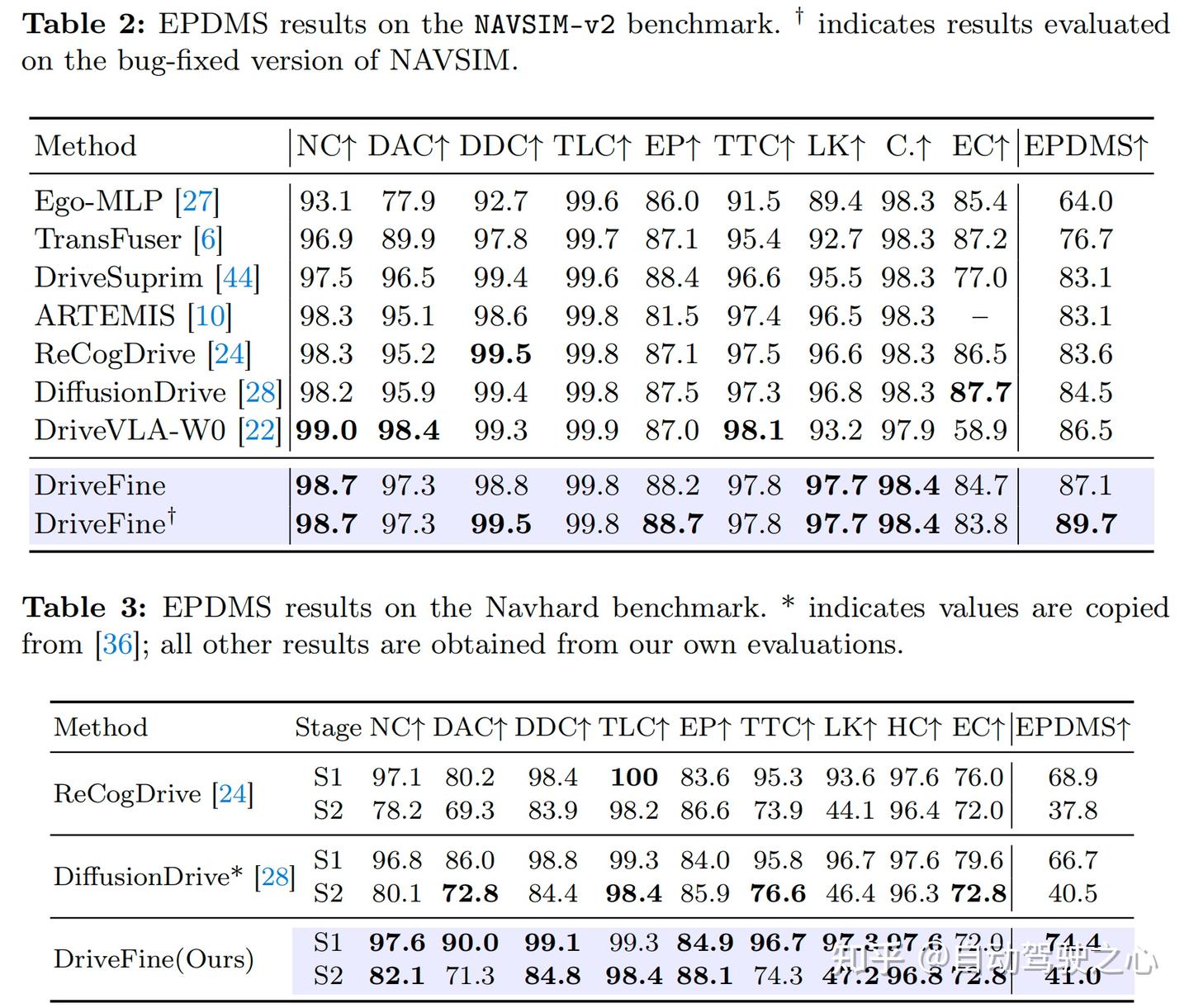

- 大量实验表明,DriveFine在NavSim v1、v2和Navhard基准数据集上均持续取得当前最优(SOTA)性能。

DriveFine算法详解

本节将详细介绍DriveFine模型,整体框架如图4所示。

用于规划任务的掩码扩散大语言模型

用于轨迹优化的块级混合专家模型

强化微调

现有研究已从理论和实验两方面证明,强化学习在自动驾驶任务中发挥着关键作用。本节将详细说明如何通过强化微调(RFT)充分挖掘DriveFine模型的性能潜力。

用于生成专家的分组相对策略优化算法

用于优化专家的混合强化学习策略

实验结果

主要实验结果:

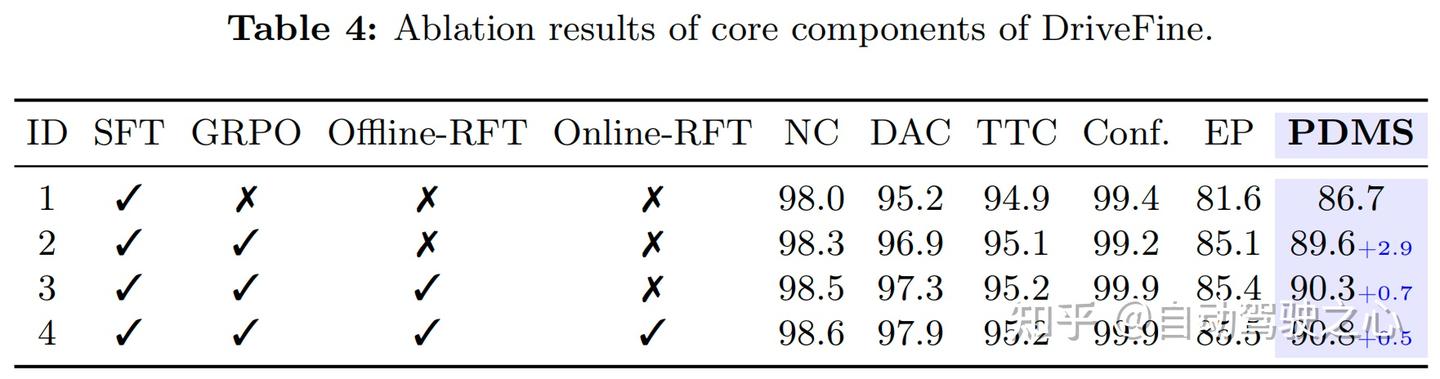

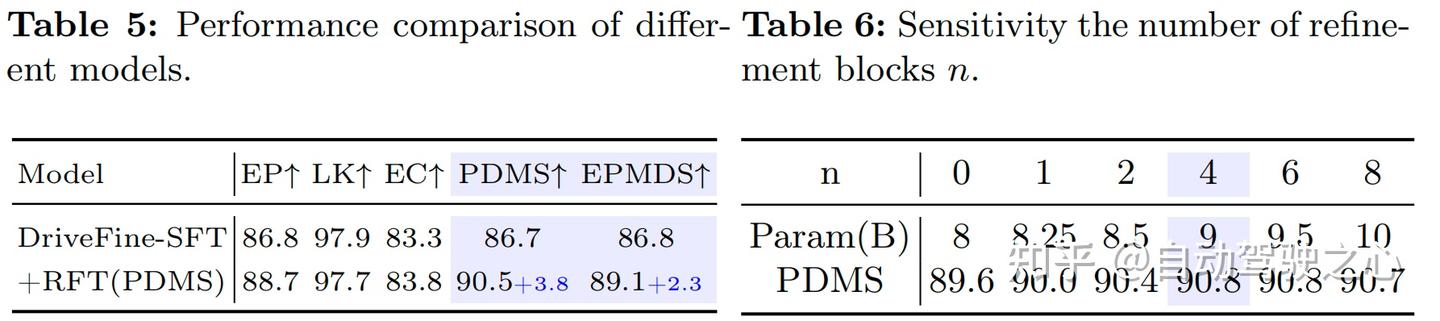

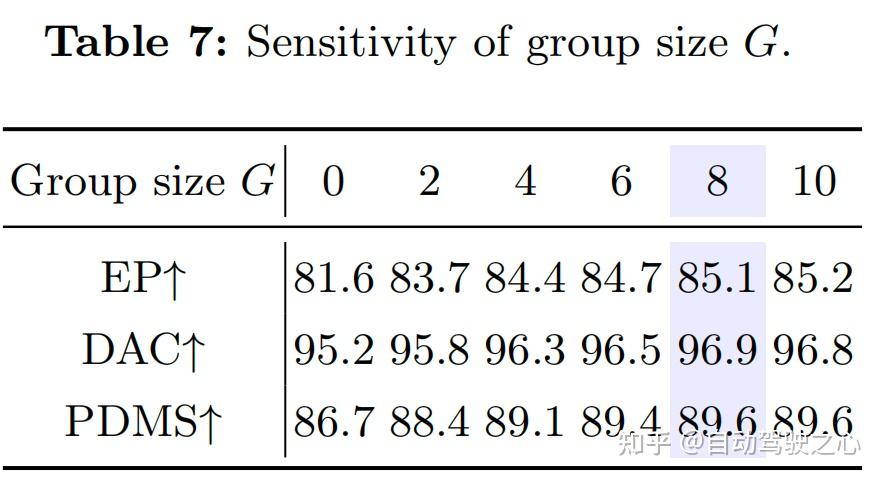

消融实验:

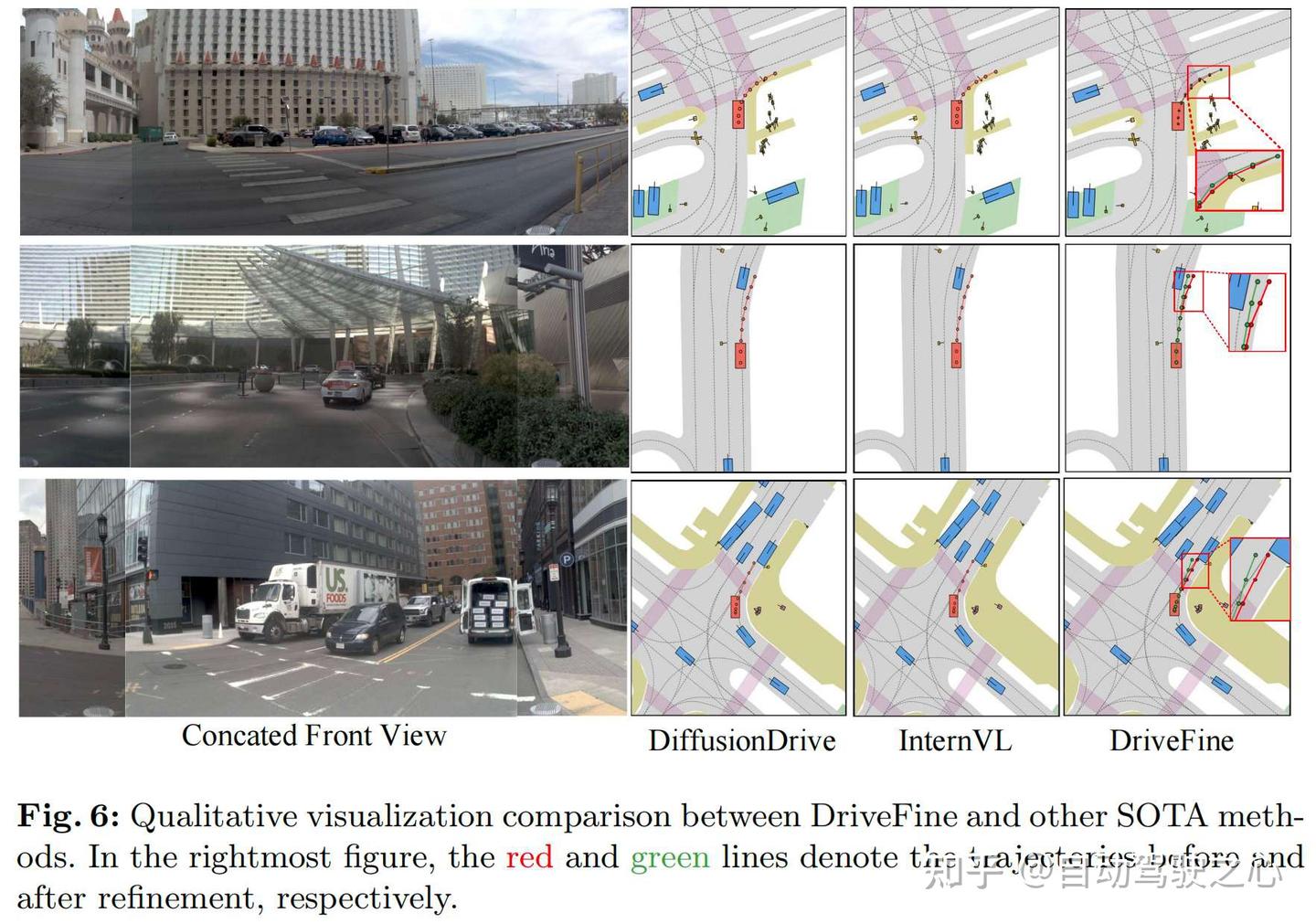

可视化:

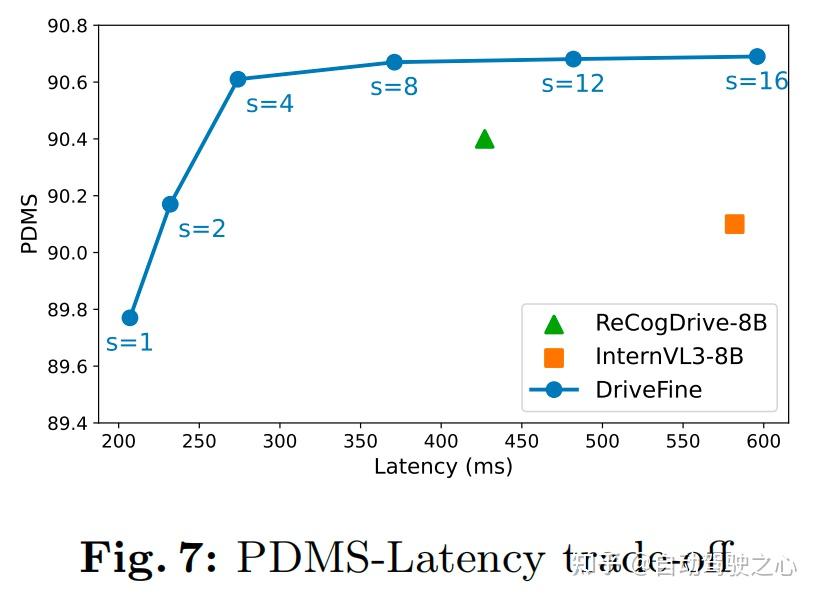

耗时和性能的关系:

结论

本文对自动驾驶领域中两类主流的视觉-语言-动作(VLA)规划器——基于扩散模型的范式与基于token的范式展开了全面分析,阐明了二者各自的优势与局限性。在此基础上,我们进一步探索了将掩码扩散大语言模型作为缓解上述缺陷的潜在解决方案。

基于上述研究结论,我们提出了DriveFine模型,该模型以即插即用的block-MoE架构为核心,并结合混合强化学习训练策略,为基于token的VLA模型注入了轨迹精修能力。我们在NAVSIM v1、NAVSIM v2,以及更具挑战性的Navhard基准数据集上对DriveFine进行了全面评估,通过大量的消融实验与对比分析,验证了该模型的有效性与鲁棒性。

发表回复