原文链接:https://zhuanlan.zhihu.com/p/1938894046367025120

自动驾驶VLA深入行业视野以来,一直面临两个关键的问题:

- 现有的VLA架构通常基于开环设置中的模仿学习,倾向于捕捉数据集中的记录行为,性能在一定程度上收到了限制;

- 闭环训练严重依赖高保真的传感器仿真,但仿真环境和真实环境的domain gap和计算效率的问题阻碍了VLA的泛化。

针对这两个问题,博世、上海大学、上交和清华AIR的团队提出了IRL-VLA,一个全新的闭环强化学习方法,通过逆向强化学习奖励世界模型结合设计的VLA方法。IRL-VLA采用三阶段范式:在第一阶段,提出了一种VLA架构,并通过模仿学习对VLA策略进行预训练。在第二阶段,通过逆向强化学习构建一个轻量级的奖励世界模型,以实现高效的闭环奖励计算。为了进一步提高规划性能,最后设计了专门的奖励世界模型引导的强化学习,通过PPO(近端策略优化)有效平衡安全事件、舒适驾驶和交通效率。IRL-VLA在NAVSIM v2端到端驾驶基准测试中达到了SOTA,在CVPR2025自动驾驶大奖赛

中获得亚军。

总结来说,有三个亮点:

- 提出了一种基于逆向强化学习的高效奖励世界模型(RWM);

- 提出了一种全新的VLA模型,该模型在模仿学习和强化学习两种设置下均能实现卓越的性能

- 在CVPR2025挑战赛的NAVSIM v2取得了第二的成绩。

非常不错的工作,后续自动驾驶之心也会持续跟踪~

引言

端到端自动驾驶已成为一个意义重大且迅速发展的研究领域。随着大量人类驾驶演示数据的可用,从大规模数据集中学习类人驾驶策略具有巨大的潜力。诸如UniAD和VAD等方法将传感器数据作为输入,并在一个完全可优化的模型内直接回归出单模态轨迹。SparseDrive进一步探索了稀疏表示,并提出了一个带有并行运动规划器的对称稀疏感知模块。借鉴机器人学中的扩散策略,DiffusionDrive、Diffusion Planer和Diff-semanticFusion通过锚定高斯分布设计和精心设计的去噪过程生成多样化的驾驶动作。尽管端到端自动驾驶取得了实质性进展,但系统的性能仍然脆弱,在长尾驾驶场景中表现出明显的性能下降。

近期的研究方法试图通过利用嵌入在视觉-语言模型(Vision-Language Models, VLMs)中的海量世界知识来缓解这一挑战,即所谓的视觉-语言-动作(Vision-Language-Action, VLA)模型,该模型以视频为输入并直接输出驾驶轨迹和动作。

一些方法将VLM连接到一个端到端模型,以提高轨迹规划的准确性。RecogDrive引入了一种新颖的驾驶框架,该框架结合了视觉-语言模型、基于扩散的规划器以及模拟器辅助的强化学习,以生成安全、类人的轨迹。SimLingo引入了“动作梦境”(action dreaming)任务,以严格评估指令条件下的驾驶行为。ORION通过名为QT-Former的基于查询的时间模块,将视觉-语言推理与生成式轨迹规划相结合,并采用基于变分自编码器(VAE)的规划器。

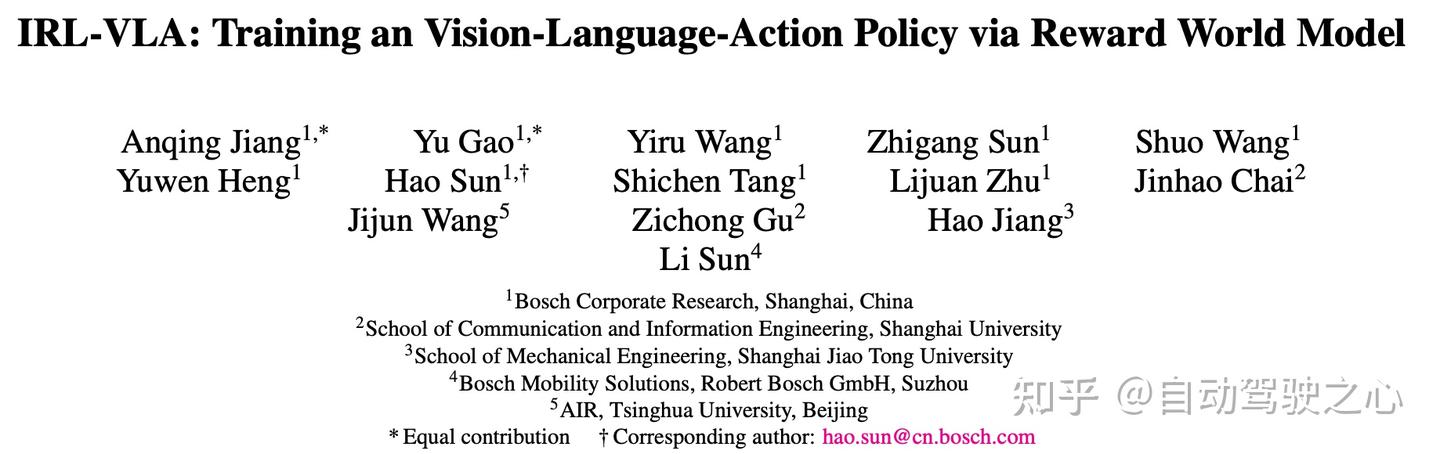

尽管如图1.a所示的模仿学习VLA方法,凭借VLM的卓越能力实现了优越的性能,但我们认为,由于在开环框架内进行模仿学习,大模型的全部潜力仍未被充分探索,这种方法倾向于复制数据集中的记录行为。这是因为驾驶本质上是一个多目标且多模态的任务,其中多模态反映了存在多个最优解,而多目标则要求满足多样化的评估标准(例如,碰撞避免、可行驶区域合规性、交通规则合规性等)。一种更自然的策略是让模型在模拟环境中自主探索,如图1.b所示,从而模仿现实世界中观察到的经验学习过程。然而开发一个完全交互式且闭环的模拟框架仍然是一个重大的技术挑战:1)仿真到现实(Sim2Real)的领域差距;2)巨大的计算开销。

在本文中,如图1.c所示,我们介绍了一种新颖的闭环强化学习框架,该框架通过逆向强化学习(Inverse Reinforcement Learning)与我们自建的VLA方法相结合,命名为IRL-VLA。利用我们的框架,设计并学习了一个实时奖励世界模型(Reward World Model, RWM),该模型通过从多样化策略中进行逆向强化学习获得。它捕捉了驾驶的多模态和多目标本质,同时能够以一种成本效益高的方式扩展到大量真实世界数据,从而规避了Sim2Real的领域适应问题。我们应用所学习的RWM来指导我们VLA模型的强化学习。我们的方法在NAVSIM v2端到端驾驶基准测试中达到了最先进的性能,在CVPR2025自动驾驶大奖赛中以45.0 EDPMS的成绩获得亚军。

据我们所知IRL-VLA是首个通过端到端强化学习(包括传感器输入)实现的闭环VLA方法。我们工作的关键贡献总结如下:

- 提出了IRL-VLA,这是一种为视觉-语言-动作(VLA)模型量身定制的、从模拟器反馈中进行强化学习的开创性框架。为了取代计算成本高昂的基于仿真器的奖励计算,引入了一种基于逆向强化学习的高效奖励世界模型(RWM),从而实现可扩展且有效的奖励估计。这个学习到的奖励模型随后被用于通过强化学习训练VLA智能体,显著增强了其实用性。据我们所知,这是首个在训练过程中不依赖仿真器开发基于强化学习的VLA自动驾驶模型的工作。

- 提出了一种全新的VLA模型,该模型在模仿学习和强化学习两种设置下均能实现卓越的性能,从而在不同的训练范式中实现最优性能。

- IRL-VLA框架在CVPR2025挑战赛的NAVSIM v2端到端驾驶基准测试上取得了卓越的性能。这些结果证明了我们方法的有效性和通用性。

相关工作回顾

端到端自动驾驶:由于其将感知、预测和规划等模块化任务整合在一个完全可微分的设计中,从而能够为追求最终目标而进行优化,因此端到端自动驾驶的研究兴趣激增。UniAD引入了一个全面的框架,将全栈驾驶任务整合到单个网络中。VAD以完全向量化的方式表示驾驶场景——涵盖智能体轨迹和地图元素——从而消除了对计算密集型光栅化表示的需求。Sparsedrive进一步探索了稀疏表示,并提出了一个对称稀疏感知模块和一个并行运动规划器。借鉴机器人学中的扩散策略,DiffusionDrive、Diffusion Planer和DiffSemanticFusion通过锚定高斯分布设计和适当的去噪过程生成多样化的驾驶动作。

自动驾驶中的视觉-语言-动作模型:近期的方法,建立了视觉-语言模型(Vision-Language Models, VLMs)与端到端框架之间的桥梁,以提高轨迹规划的准确性。Recogdrive介绍了一种新颖的端到端驾驶架构,该架构结合了视觉-语言模型、基于扩散的规划器和模拟器辅助的强化学习,以生成安全且类人的轨迹。SimLingo引入了“动作梦境”(Action Dreaming)任务,以严格评估指令条件下的驾驶行为。此外,ORION提出了使用QT-Former和变分自编码器(VAE)将视觉-语言推理与轨迹规划相融合。然而,这些方法依赖于模仿学习,这限制了它们在真实世界多模态和多目标驾驶场景中的泛化能力。

自动驾驶中的强化学习:强化学习(Reinforcement Learning, RL)已成为一种有前景的方法,在大语言模型(LLMs)和游戏中已证明其成功。在自动驾驶的背景下,RL已被用于解决特定的决策挑战和复杂的驾驶场景。RAD在基于光真实感3D高斯点阵(3DGS)的仿真框架内,采用强化学习来训练一个端到端的自动驾驶智能体。然而,由于传感器渲染的计算量巨大,且未解决仿真到现实(Sim2Real)的领域差距,该方法仅限于离线策略学习。其他研究提出了基于学习的轨迹规划框架,其中动作被直接表示为以自我为中心的规划轨迹。Car-Planner提出了一种基于RL的规划器,在具有挑战性的大规模真实世界数据集nuPlan上,其性能超越了模仿学习(IL)和基于规则的最先进方法(SOTAs)。DiffVLA提出了一种高效的VLA模型,该模型采用分层的由粗到精的扩散式轨迹生成,并结合VLM的导航引导。尽管它在NAVSIMv2基准测试上取得了最先进的性能,但其模仿学习的设置限制了其潜力。我们的IRL-VLA框架将RL的应用范围从规划器扩展到了整个VLA模型架构,从而进一步提升了模型性能的上限。

IRL-VLA算法详解

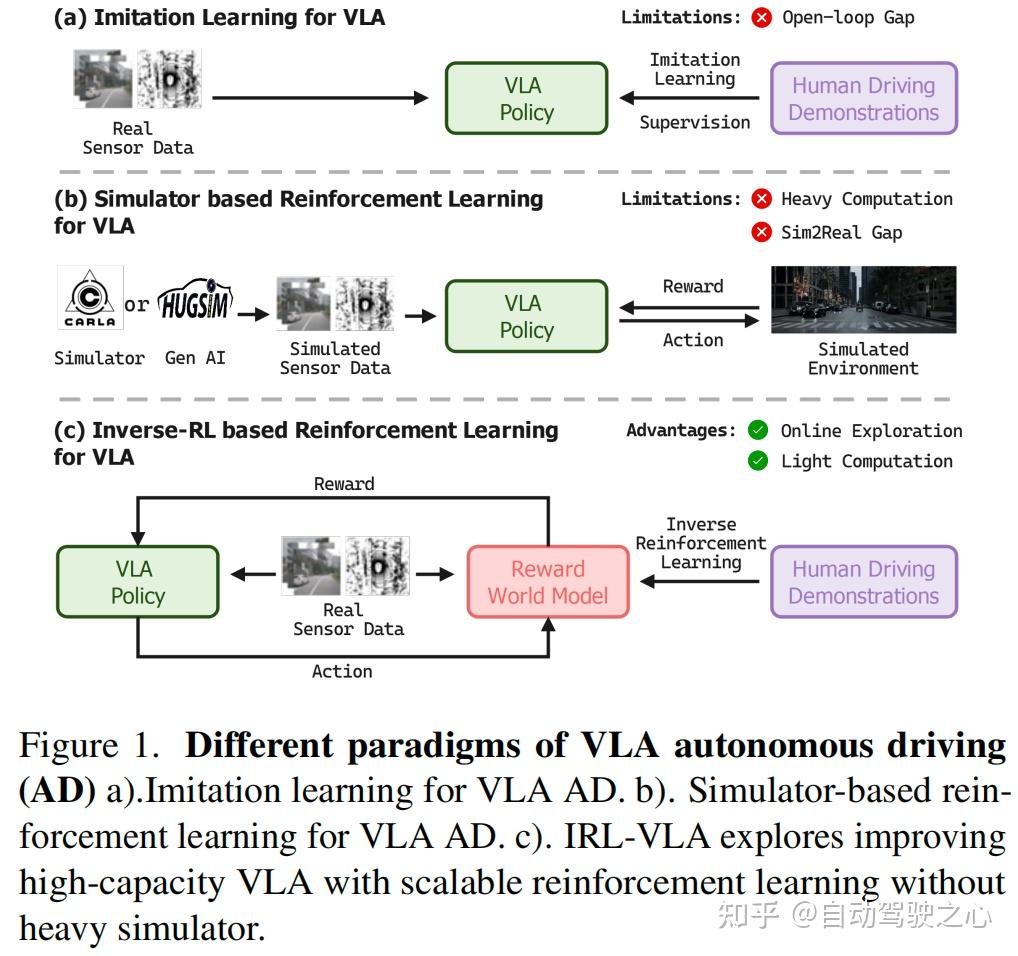

本节将详细介绍我们所提出的视觉-语言-动作(VLA)模型,该模型通过一个奖励世界模型进行闭环强化学习训练,如图2所示。

模仿策略学习

视觉-语言-动作模型:受具身智能领域内双重过程理论最新进展的启发,我们提出了一种用于自动驾驶的高效VLA模型,该模型包含三个不同的模块:(1) 用于深度场景理解的语义推理模块(2) 用于精确几何推断的3D推理模块以及(3) 一个统一的基于扩散的规划器,用于生成多样化的驾驶轨迹。

语义推理:如图2.d所示,为了在自动驾驶场景中实现多模态信息的有效处理和融合,我们提出了VLM指令引导模块。该模块基于Senna-VLM

框架构建,利用多图像编码策略和多视角提示机制,实现高效且全面的场景理解。

3D推理:如图2.e所示,我们首先使用一个BEV视觉编码器和一个适配器,将多视角图像编码为BEV空间中的特征图。然后,我们利用一组检测token(detection tokens)和地图token(map tokens)从BEV特征空间中学习向量化的地图元素和智能体运动信息。

统一扩散规划器:如图2.f所示,为了生成多样化且信息丰富的未来轨迹分布,采用了一种基于扩散的方法,该方法对带有高斯噪声的anchor proposal轨迹进行处理,条件扩散模型学习一种强大的去噪机制,能够捕捉未来运动的固有多模态性。为了增强去噪过程,我们分层地将丰富的场景语义(如BEV标记、地图标记和检测标记)整合到轨迹生成管道中。这确保了模型合成的轨迹与环境约束保持一致。在最终的条件解码步骤之后,通过一个轻量级的基于MLP的回归头,从精细化的轨迹标记中重构出多模态轨迹。这使得每种模式都能与可行、可解释且符合场景的运动模式对齐,从而提高了轨迹的真实性和对物理约束的遵守程度。

逆环境学习

奖励数据收集:为了开发一个有效的奖励世界模型(RWM),一个全面的数据集至关重要。IRL-VLA使用EPDMS

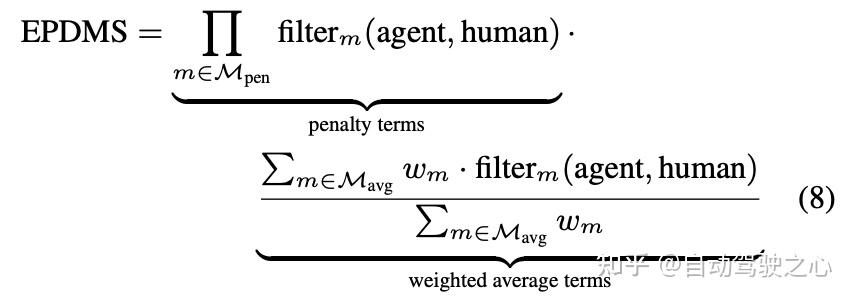

的人类设计指标,该系统包含九个子分数:无责碰撞(No At-Fault Collision, NC)、可行驶区域合规性(Drivable Area Compliance, DAC)、驾驶方向合规性(Driving Direction Compliance, DDC)、交通灯合规性(Traffic Light Compliance, TLC)、自车进度(Ego Progress, EP)、碰撞时间(Time to Collision, TTC)、车道保持(Lane Keeping, LK)、历史舒适度(History Comfort, HC)和扩展舒适度(Extended Comfort, EC),以及一个加权总和分数,记为EPDMS。我们排除了EC,因为其需要对每个场景进行两次独立的模拟。这些指标提供了关于环境和智能体交互的详细洞察。然而,仅靠模仿数据往往缺乏多样性,因为它们无法充分捕捉在各种场景下的多样化轨迹。

为了增强分数和轨迹的多样性并确保模型的泛化能力,我们采用了三种策略。首先,我们记录扩散过程每一步的轨迹及其对应的EPDMS分数。其次,我们不使用固定的轨迹集,而是使用K-means聚类从人类演示数据中采样多种轨迹模式,K值范围从32到8192。第三,我们对NAVSIM数据集中的每个场景应用多个自车姿态进行模拟,以生成多样化的样本。

奖励世界模型:本文提出了一种奖励世界模型(RWM),作为一种轻量级、数据驱动的替代方案,以取代传统的仿真器,从而实现对自动驾驶系统的闭环评估,并通过逆向强化学习收集下游驾驶统计数据(如碰撞率、交通规则合规性和驾驶舒适度)。RWM通过直接基于真实世界演示建模奖励结构,消除了对计算密集型仿真器的需求,并缓解了仿真到现实(sim-to-real)的领域差距。其架构如图2(b)所示,与智能体类似,使用多视角相机信息和智能体预测的未来轨迹作为输入。RWM预测智能体在模拟环境中的未来奖励。

基于RWM的强化学习

实现细节

实验结果分析

在我们的实验中,我们重点关注以下几个问题:

- IRL-VLA在常见的开环和闭环自动驾驶基准测试上的表现如何?

- 所提出的技术和实现细节如何影响IRL-VLA的性能?

实验设置

数据集与指标:NAVSIM是一个基于OpenScene(nuPlan的新版本)构建的、以规划为导向的自动驾驶数据集。它提供了八个1920×1080的相机和一个由五个传感器在当前及前三帧中聚合而成的融合激光雷达点云。该数据集被划分为navtrain(1,192个训练场景)和navhard(136个评估场景)。

NAVSIM基准测试提供了一个非交互式仿真环境,并采用扩展预测驾驶员模型分数(Extend Predictive Driver Model Score, EPDMS)作为其闭环规划指标:

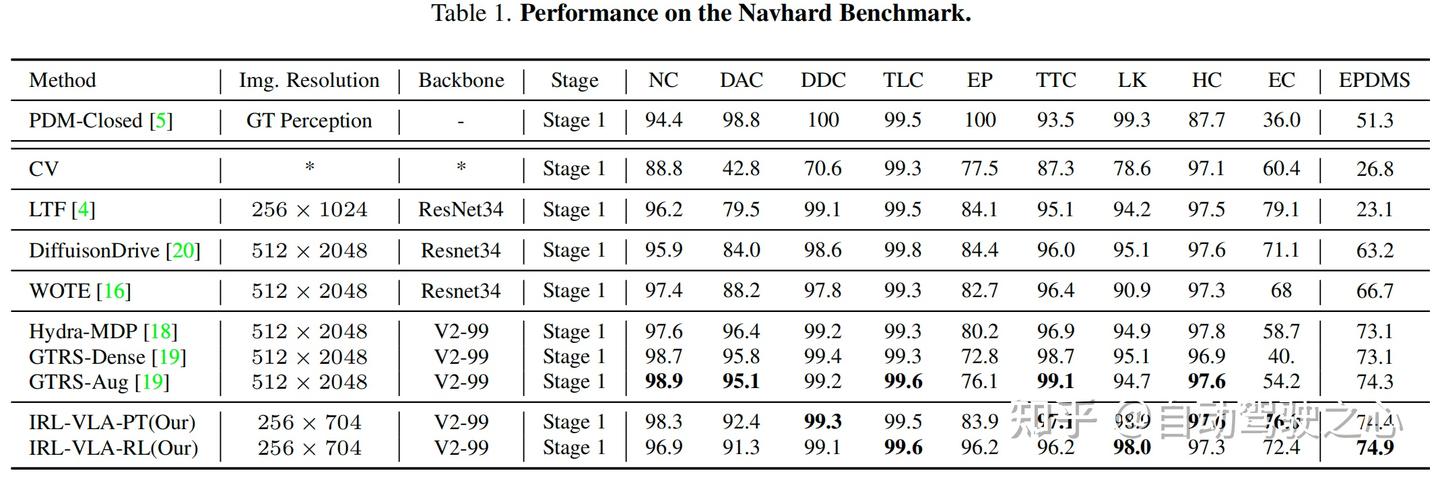

与SOTA对比

表1展示了IRL-VLA在Navhard基准测试上与基线方法的性能对比。我们的预训练模型(IRL-VLA-PT)在多个指标上取得了具有竞争力的结果,EPDMS得分为74.4,优于DiffusionDrive(63.2)、WOTE(66.7)和GTRS-Aug(74.3)等几种最先进的方法。与GTRS-Dense和GTRS-Aug等基于评分的模型相比,这些模型通过评分机制在提升安全指标(如无碰撞NC,GTRS-Aug为98.9)的同时,牺牲了舒适性相关分数(如扩展舒适度EC,GTRS-Aug为54.2),而我们的IRL-VLA-PT模型在保持近乎相当的安全性能(NC:98.3 vs. 98.9)的同时,显著提升了自车进度(EP:83.9 vs. 76.1)和扩展舒适度(EC:76.0 vs. 54.2)。这种平衡凸显了我们的VLA架构在优化安全性和舒适性方面的有效性,且无需依赖显式的评分机制。

消融实验

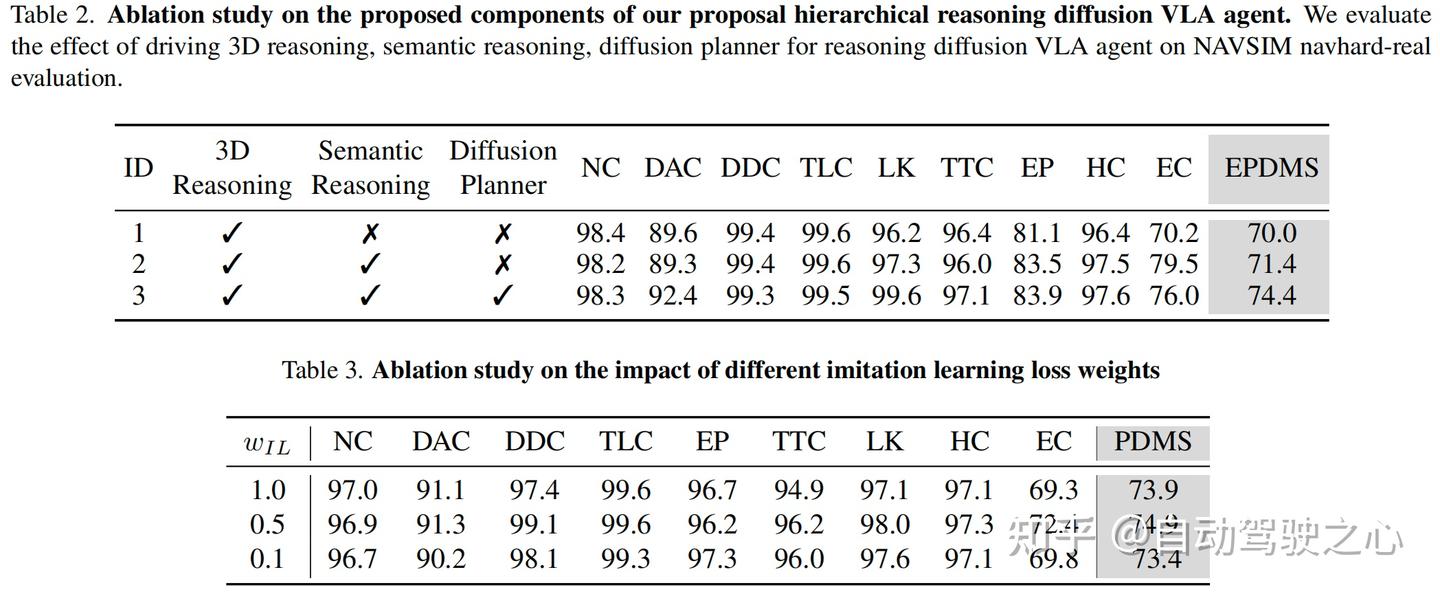

为了评估所提出的技术和实现细节对IRL-VLA性能的影响,我们进行了两项消融研究。这些研究考察了最佳VLA结构、奖励世界模型的效果,以及结合强化学习(RL)和模仿学习(IL)的重要性。

分层推理扩散VLA智能体的消融研究:表2展示了我们提出的IRL-VLA分层推理扩散VLA智能体的消融研究。仅使用3D推理并通过人类驾驶演示数据进行训练时,模型在Navhard-real基准测试上取得了70.0的EPDMS。引入语义推理模块和我们的高层驾驶指令查询后,EPDMS提升了1.4。最后,引入用于连续轨迹预测的扩散规划器后,EPDMS进一步达到了74.4,提升了3.0。这证明了我们分层推理扩散VLA方案的价值,该方案在产生更安全、更舒适的驾驶行为方面具有强大的预训练性能。

结论

在本文中,我们提出了IRL-VLA,一种新颖的闭环强化学习框架,该框架通过奖励世界模型(Reward World Model)为端到端自动驾驶中的视觉-语言-动作(VLA)模型服务。我们的三阶段方法——模仿策略学习、逆向环境学习和闭环强化学习——解决了开环模仿学习和基于仿真器训练的局限性。通过使用语义和3D推理模块以及基于扩散的规划器对VLA模型进行预训练,通过逆向强化学习构建一个轻量级的奖励世界模型(RWM),并使用PPO微调策略,IRL-VLA在NAVSIM v2 CVPR挑战赛基准测试上取得了最先进的性能,获得了45.0 EDPMS,并在CVPR 2025自动驾驶大奖赛中获得亚军。同时,在NAVSIM Navhard real基准测试上也表现出最先进水平,得分为74.9。据我们所知,IRL-VLA是首个在不依赖仿真器的情况下、结合传感器输入的闭环VLA方法。我们的贡献包括一个开创性的VLA模型强化学习框架、一个用于可扩展奖励计算的高效RWM,以及所证明的通用性,为闭环自动驾驶的未来发展铺平了道路。

发表回复