原文链接:https://zhuanlan.zhihu.com/p/1920167407336555667

导读

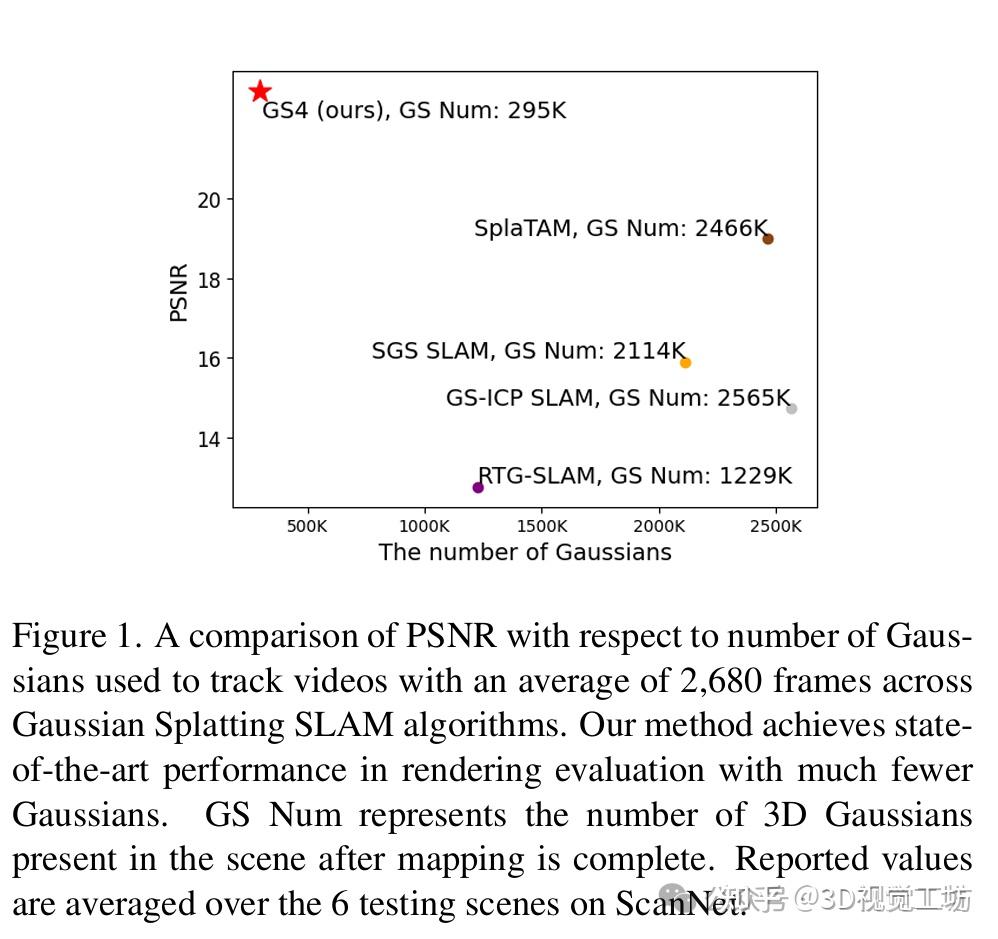

GS4是首个基于泛化高斯溅射的语义SLAM系统,旨在解决传统方法的三大瓶颈。传统SLAM算法如ORB-SLAM依赖稀疏特征点,难以构建稠密地图;而神经辐射场(NeRF)方法虽提升重建质量,却需高昂计算成本与逐场景优化。高斯溅射技术虽加速渲染,仍面临高斯冗余、语义分离和泛化性差的问题。GS4通过端到端前馈网络直接预测3D语义高斯参数,实现三大突破:泛化能力上可直接处理未知场景而无需测试时优化;效率上仅需基线方法10%的高斯数量(ScanNet平均29.5万对比基线246.6万);语义层面则共享主干网络同步预测几何与语义,避免分割模型的开销。在ScanNet数据集上,GS4以22.71dB的峰值信噪比刷新渲染记录,并在NYUv2、TUM

等未训练数据集上实现零样本泛化。

论文信息

标题:GS4: Generalizable Sparse Splatting Semantic SLAM

作者单位:Mingqi Jiang,et al. Collaborative Robotics and Intelligent Systems (CoRIS) Institute,etc

主页:https://mingqij.github.io/projects/gs4/

效果展示

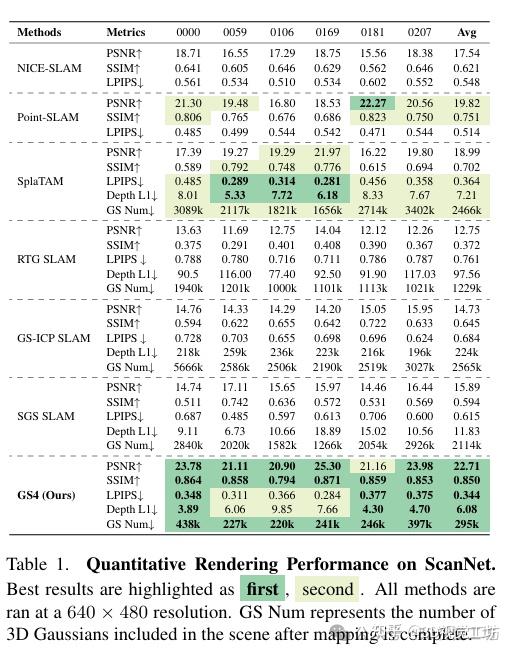

高斯效率(图1)显示,GS4在ScanNet场景0059仅用22万高斯即达到21.11dB PSNR,而基线SplaTAM

需246万高斯。

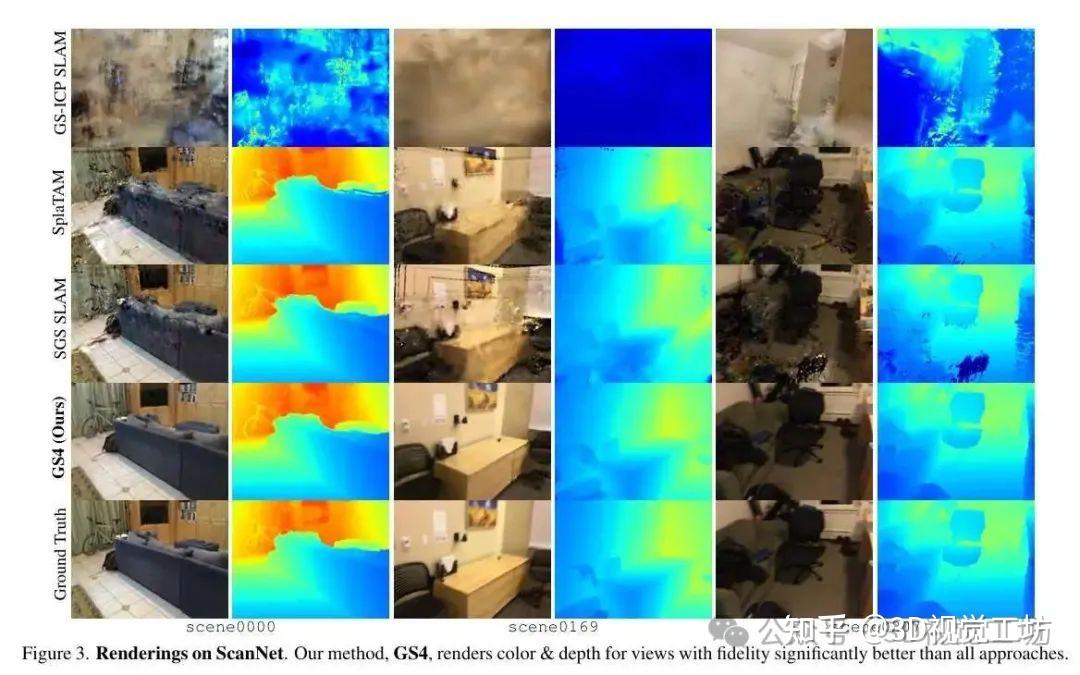

几何重建细节(图3)表明,GS4能完整重建自行车轮胎的连续轮毂结构,而基线结果断裂模糊;在椅子靠背重建中,GS4还原了镂空支架细节,优于含噪声的真值深度数据。

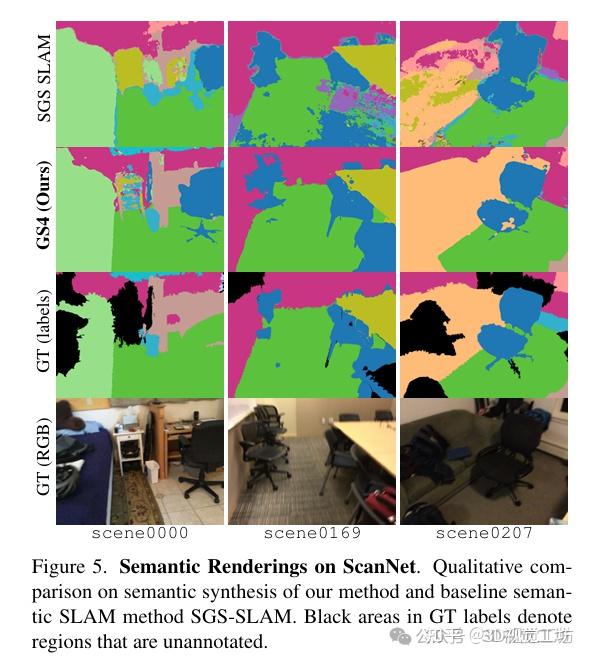

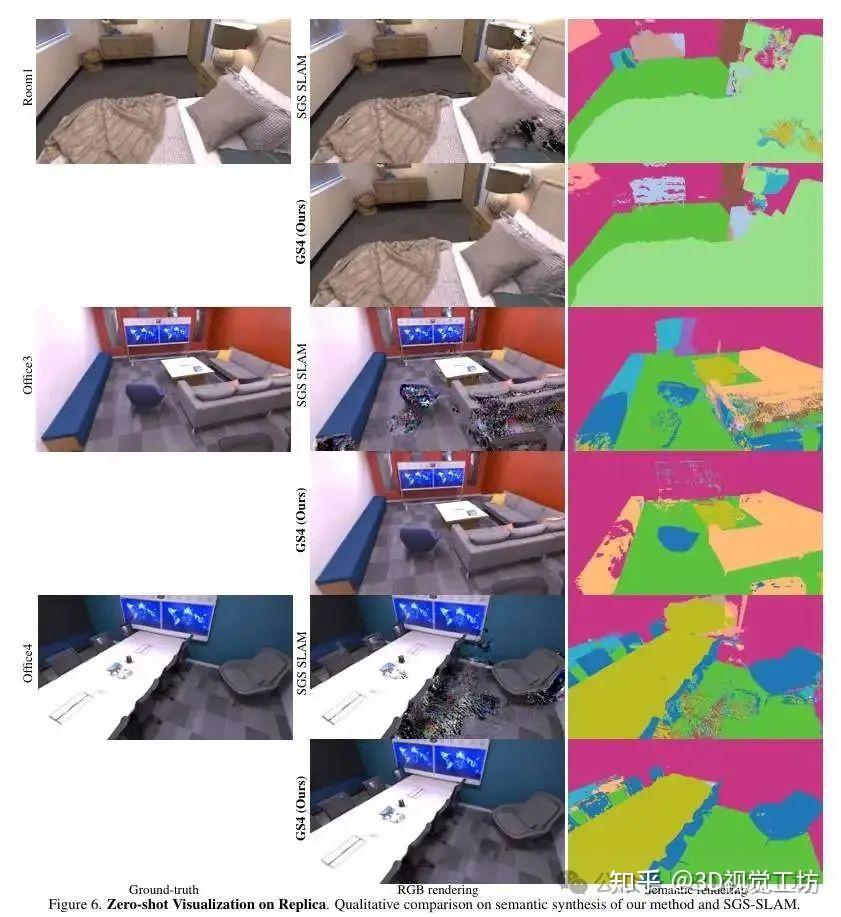

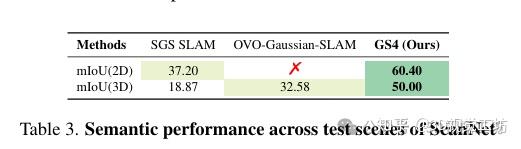

语义分割对比(图5)中,GS4对卧室场景的”书桌/椅子/床头柜”分割精准(mIoU 60.40%),显著优于SGS-SLAM

的37.20%(后者出现桌面与墙壁粘连错误)。

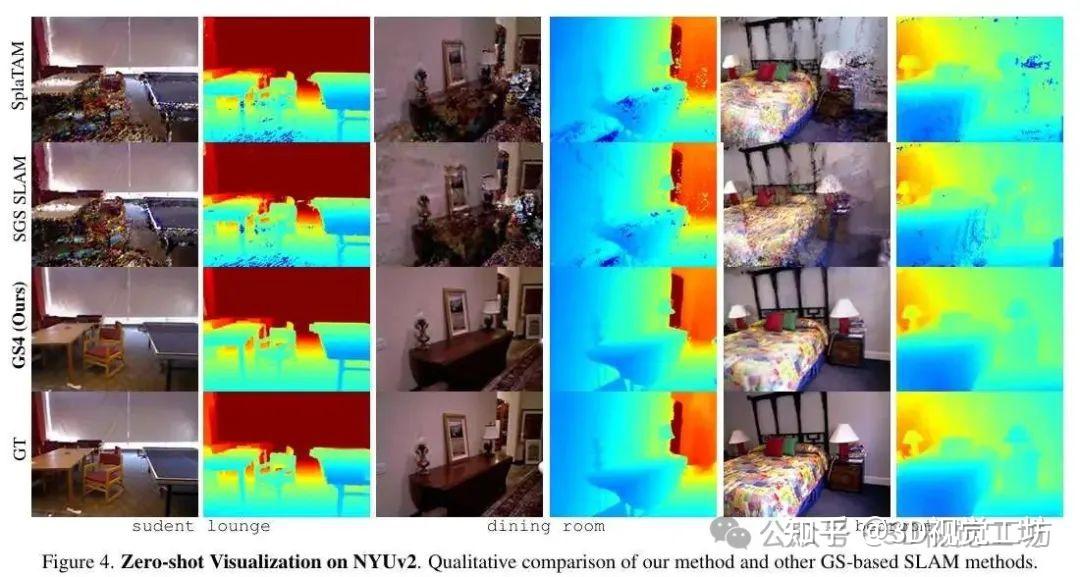

零样本泛化能力(图4、图6)在NYUv2学生公寓和Replica合成数据集得到验证,GS4重建出清晰的桌椅、显示器,语义边界锐利无重影。

引言

语义SLAM需同步解决相机定位、稠密建图与场景理解三大挑战。传统稠密SLAM如BundleFusion通过体素网格实现重建,但细节平滑且计算量大;NeRF-SLAM方法如NICE-SLAM虽提升质量,体积渲染耗时且泛化性差。3D高斯溅射技术通过可微溅射实现实时渲染,但现有方案如SplaTAM存在固有缺陷:依赖启发式高斯增删策略导致单场景需超200万高斯;需逐场景梯度优化而无法实时部署;语义分割依赖外部模型(如SGS-SLAM需Mask2Former

),造成计算流程割裂。GS4提出泛化前馈架构,首次以统一网络端到端预测语义高斯参数,为机器人交互与AR应用提供实时三维认知基础。

主要贡献

- 首个泛化高斯溅射语义SLAM框架

- 高效稀疏的高斯优化网络

- 单次迭代优化解决位姿漂移

- 统一语义与几何建模

方法

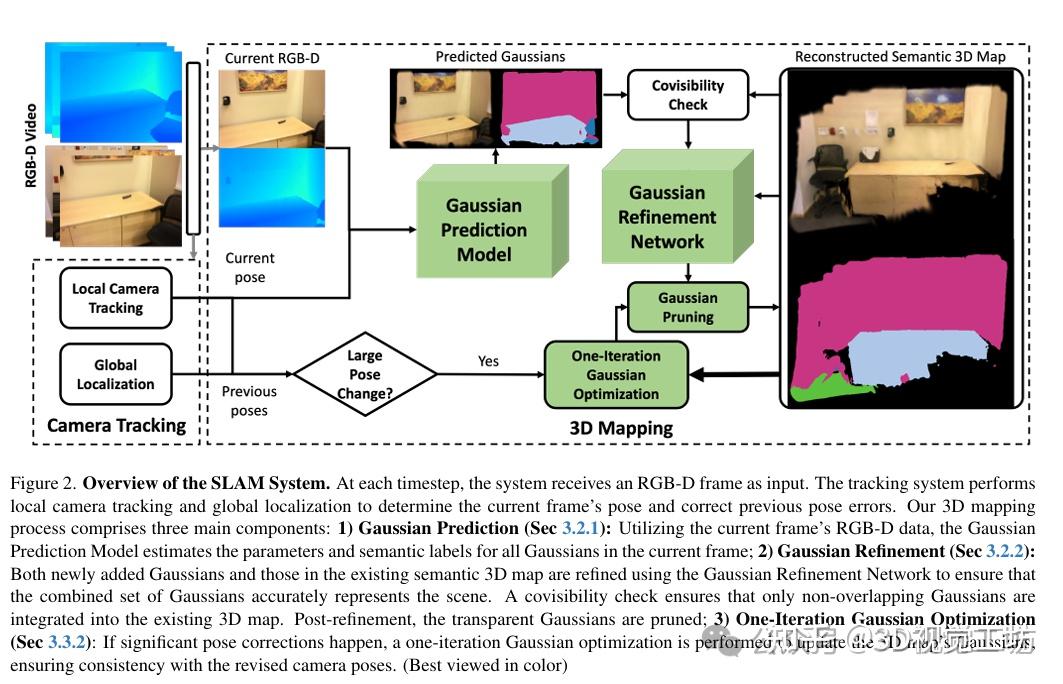

GS4系统流程包含紧密协作的跟踪与建图模块(图2)。跟踪模块采用GO-SLAM

框架,通过RGB-D光流计算帧间运动,并在并行线程执行全局束调整。

建图模块的核心是高斯预测与优化:高斯预测网络以ODIN

为主干,输入RGB-D帧输出高斯位置偏移、尺度、旋转等参数及语义向量;高斯优化网络则通过特征融合机制对齐新旧高斯,预测颜色、尺度等参数增量。关键技术改进包括精简ODIN架构——删除冗余3D注意力层并用点基上采样替代体素插值,速度提升1.7倍;以及多视图语义监督策略,结合当前帧与重叠新视角的渲染损失,并采用Mask2Former强化物体边界的分割监督。

实验结果

实验在ScanNet(训练与测试)、NYUv2和TUM等数据集验证GS4性能。在ScanNet渲染任务中(表1),GS4以22.71dB PSNR和0.850 SSIM超越所有基线,高斯数量仅为29.5万(SplaTAM需246.6万)。

深度重建误差低至6.08厘米,较SplaTAM降低15.7%,薄结构如椅子腿重建更完整。语义分割方面(表3),GS4的3D mIoU达50.00%,显著优于OVO-Gaussian-SLAM的32.58%,关键提升源于共享主干网络促成的几何语义特征对齐。

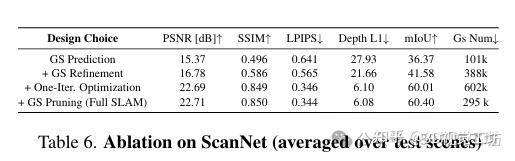

零样本泛化测试中,GS4在NYUv2的PSNR达22.15(超SplaTAM 17.5%),每秒帧率7.01;在TUM的轨迹误差仅1.48厘米接近最优,高斯数量保持132万的低位。消融实验(表6)证实各模块必要性:单次迭代优化使PSNR提升5.93dB,后续剪枝去除51%冗余高斯。

总结

GS4首次实现泛化、稀疏与语义融合的实时SLAM系统。其核心创新是端到端前馈网络直接预测3D语义高斯,消除传统逐场景优化;高斯优化网络通过动态剪枝机制,以10%资源达到最优重建质量;单次迭代优化则有效解决位姿校正导致的漂浮物问题。实验证明GS4在ScanNet的渲染质量、语义精度均达最先进水平,且能零样本泛化至多样场景。未来工作将探索纯RGB输入方案,并进一步优化推理速度至10帧/秒以上。

发表回复