原文链接:https://zhuanlan.zhihu.com/p/1893126291550605626

我们提出了一种新颖的方法,称为ADGaussian,用于可泛化的街景重建。所提出的方法能够从单视图输入实现高质量的渲染。与之前主要侧重于几何优化的GS方法不同,我们强调图像和深度特征联合优化对于精确高斯预测的重要性。为此,我们首先将稀疏LiDAR深度作为额外的输入模态,将高斯预测过程表述为视觉信息和几何线索的联合学习框架。此外,我们提出了一种多模态特征匹配策略,并结合多尺度高斯解码模型,以增强多模态特征的联合优化,从而实现高效的多模态高斯学习。在两个大规模自动驾驶数据集Waymo和KITTI

上的广泛实验表明,我们的ADGaussian达到了最先进的性能,并在新视角变换中表现出优越的零样本泛化能力。

本文引言

最近,3DGS(3DGS)因其实时渲染速度和高质量输出在3D场景重建和新视角合成领域引起了广泛关注。一个关键应用是从图像序列中对街道场景进行建模,这在自动驾驶等领域中起着至关重要的作用。 在城市场景建模中,一些方法遵循逐场景优化技术,特别是Street-Gaussians,它将动态城市街道表示为一组配备语义逻辑和3D高斯点的点云。尽管逐场景优化方法在高质量重建方面表现出色,但它通常面临昂贵的训练成本和大范围的新视角合成问题。

为了实现可泛化的街景重建,大多数现有方法都基于PixelSplat或MVSplat

的架构。例如,GGRt引入了一种无姿态架构来迭代更新多视角深度图,随后基于PixelSplat估计高斯原语。类似地,GGS通过集成多视角深度细化模块增强了MVSplat的深度估计。然而,基于多视角特征匹配的深度估计在诸如无纹理区域和反射表面等挑战性条件下可能会失败。为了解决这个问题,同期工作DepthSplat结合了来自Depth Anything V2的预训练深度特征与多视角深度估计,以实现准确的深度回归,其中估计的深度特征进一步用于高斯预测。

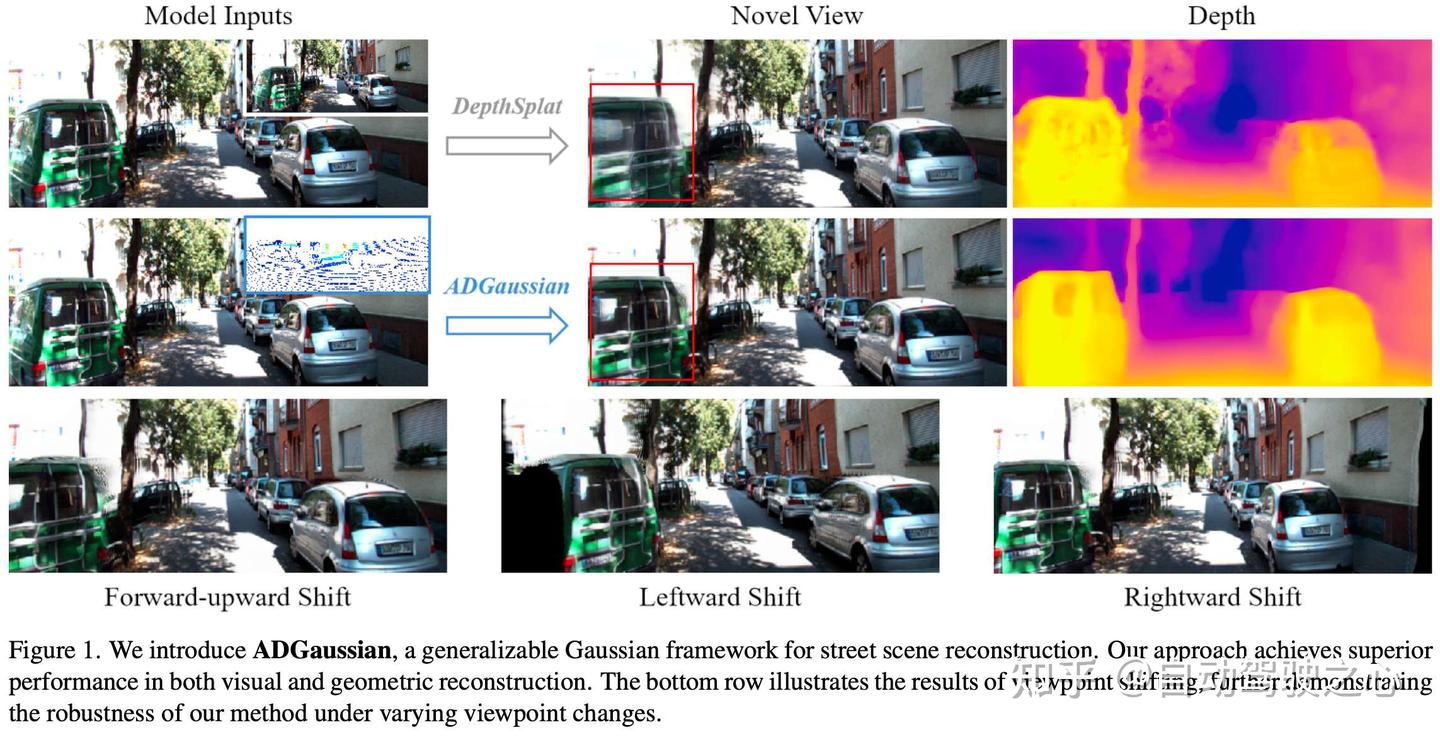

鉴于Depth Anything V2的强大泛化能力,将其扩展到城市街道场景是合理的。然而,当应用于这些环境时,DepthSplat面临特定的限制。首先,视觉渲染质量受到预训练深度模型有效性的限制。此外,即使在深度质量较高的情况下,直接串联图像和深度特征来进行高斯预测,在复杂的自动驾驶情境中也会导致不令人满意的视觉重建(见图1)。

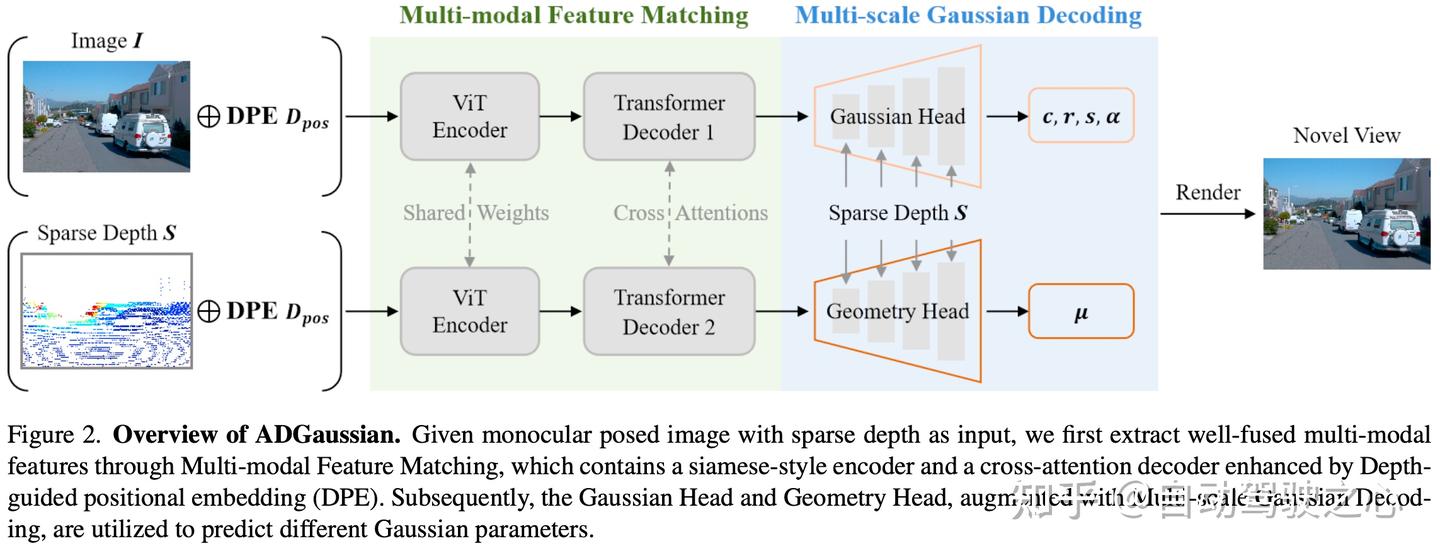

为此,我们提出了一种新的多模态表示框架,旨在增强街景中的几何建模和视觉渲染。该框架利用两种互补的模态:图像视觉线索和深度几何线索。关键见解在于促进不同模态之间的有效信息共享和联合优化。具体而言,我们的框架首先将稀疏LiDAR深度信息作为额外的输入模态进行整合,这为增强几何重建提供了精确的度量尺度先验。给定图像数据和稀疏深度图,我们介绍了一种有效的多模态特征匹配策略,通过暹罗式编码器和由深度引导位置嵌入(DPE)增强的信息交叉注意解码器实现。这种设计确保了几何和外观信息的融合,从而产生对齐良好的多模态令牌。随后,我们采用多尺度高斯解码模型将多尺度深度信息聚合到图像和深度令牌中,以进行最终的高斯预测。值得注意的是,我们的模型即使在大视角变化下也表现出优越的性能,如图1底部所示。这一能力证明了联合优化多模态特征的有效性,从而实现了优越的几何和纹理重建。 总体而言,这项工作做出了以下贡献:

- 我们提出了ADGaussian,这是第一个使用多模态数据(特别是彩色图像和深度图)对街景进行建模的可泛化框架。

- 我们开发了一种多模态特征匹配策略以及多尺度高斯解码模型,以促进有效的多模态高斯学习。

- 我们在两个大规模驾驶数据集上进行了广泛的比较,展示了我们方法的最先进性能,并证明了所提出组件的有效性。

相关工作回顾

可泛化的3DGS

可泛化的GS旨在学习强大的先验知识,以实现跨未见场景的有效泛化。现有方法大致可以分为两类。第一类包括PixelSplat、MVSplat、MVS-Gaussian和SplatterImage等方法,它们利用已知的相机参数预测每像素的3D高斯原语。

第二类方法则提出同时预测相机参数和3D表示,消除了对已知相机姿态的需求。例如,GGRt采用迭代姿态优化网络来估计并迭代更新目标图像与参考图像之间的相对姿态。然而,在街道场景建模中,相机姿态为从视频序列中确定场景尺度和增强重建精度提供了关键约束。此外,街道场景中的相机姿态易于获取,使其成为一种实用且可靠的数据资源。因此,我们选择利用有姿态的图像进行我们的方法。

深度与高斯GS

深度质量在GS中起着关键作用。为了确保精确的几何重建,GPS-Gaussian和DN-Splatter等方法将额外的深度监督纳入优化过程。然而,由于密集的真实深度数据通常不可用,研究方向转向利用预训练的深度基础模型提供可靠的几何线索。

例如,Chung等人使用稀疏COLMAP点重新缩放预训练的深度图,从而为模型优化提供准确的深度约束。此外,Flash3D利用冻结的现成网络估计度量深度,随后直接作为重建模型的输入。为了减少误差传播,DepthSplat融合了预训练的深度特征与多视角成本体积特征,同时保持预训练网络的学习能力。与先前的方法相比,这些方法主要侧重于几何改进,我们认为图像和深度特征的联合优化对于实现高质量重建更为关键。

集成LiDAR的GS

LiDAR数据的集成已成为街道场景重建中广泛采用的方法,主要是因为它在促进几何学习方面的有效性。 传统的LiDAR方法通常包括两个主要步骤:从LiDAR点云初始化高斯分布,并进一步用LiDAR先验监督预测的高斯位置。然而,在没有LiDAR测量值的区域,重建质量往往会下降。为了解决这一限制,HGS-Mapping从相邻RGB帧中提取匹配特征点,并利用估计的空间位置初始化LiDAR覆盖范围之外的区域。类似地,TCLC-GS通过结合LiDAR几何和图像颜色构建混合3D表示,能够同时初始化3D高斯的几何和外观属性。我们不直接使用LiDAR点云,而是建议利用稀疏LiDAR深度来弥合LiDAR和相机数据之间的差距。此外,我们将深度先验整合到训练过程中,实现深度几何和图像光度属性的联合优化,而不是仅限于初始化的做法。

方法详解

深度基础模型已被集成到GS中以改善几何重建。然而,由于光度和几何线索之间的交互不足,这种框架往往在渲染质量上表现不佳。为了解决这个问题,我们提出了ADGaussian,这是一种同步多模态优化架构,结合了稀疏深度数据与单目图像,用于增强街景建模。

预备知识:GS的深度基础模型

最近,像DepthSplat这样的工作研究了使用预训练深度基础模型进行基于图像条件的3D高斯重建的优势,利用其在各种现实世界数据集上的卓越表现。所有这些方法都利用预训练的单目深度特征来增强最终的深度估计,从而提高高斯渲染的质量。

直观地,这种模型可以轻松适应城市场景。尽管如此,我们观察到重建效果很大程度上依赖于预训练深度基础模型的表现,导致不同街道数据集和场景中的准确性不一致。此外,图像和深度特征的处理总是针对每个视图并行进行,没有任何信息共享或同步优化,这限制了模型的学习能力。

多模态特征匹配

在本节中,我们寻求一种有效的方法,将稀疏LiDAR深度整合到GS中,并充分利用多模态特征。为此,我们提出了一种专为城市场景设计的多模态特征匹配架构,以实现稀疏深度信息与彩色图像数据的同步整合。在此过程中,深度引导的位置嵌入将深度线索整合到位置嵌入中,增强了3D空间感知并改善了多模态上下文理解。

实验分析

实现细节

数据集。我们在两个广泛使用的自动驾驶数据集上评估了我们提出的方法:Waymo开放数据集和KITTI跟踪基准。对于这两个数据集,我们采用了大约1:7的训练-测试分割比例。具体来说,在Waymo数据集上,我们的重点主要在于静态和动态场景,每种场景类型分为4个测试场景和28个训练场景。同样,对于KITTI数据集,分割包括5个测试场景和37个训练场景。这种分区确保了在不同场景中对我们的方法进行平衡评估,同时也提供了足够的训练数据以进行有效的模型训练。

度量标准。为了评估渲染质量,我们采用了标准的图像质量度量,包括峰值信噪比(PSNR)、结构相似性指数测度(SSIM)和学习感知图像块相似性(LPIPS)。还提供了运行时间和GPU内存使用情况,以便全面比较速度和精度之间的权衡(详见补充材料)。

训练细节。我们的实现基于PyTorch框架。我们采用Adam优化器和余弦学习率调度策略,初始学习率为1e − 4。我们在3090 Ti GPU上训练我们的模型,在Waymo和KITTI数据集上运行150k次迭代,批处理大小为1。为了确保公平比较,所有实验都在Waymo数据集的320 × 480分辨率和KITTI数据集的256 × 608分辨率下进行。

与现有技术的比较

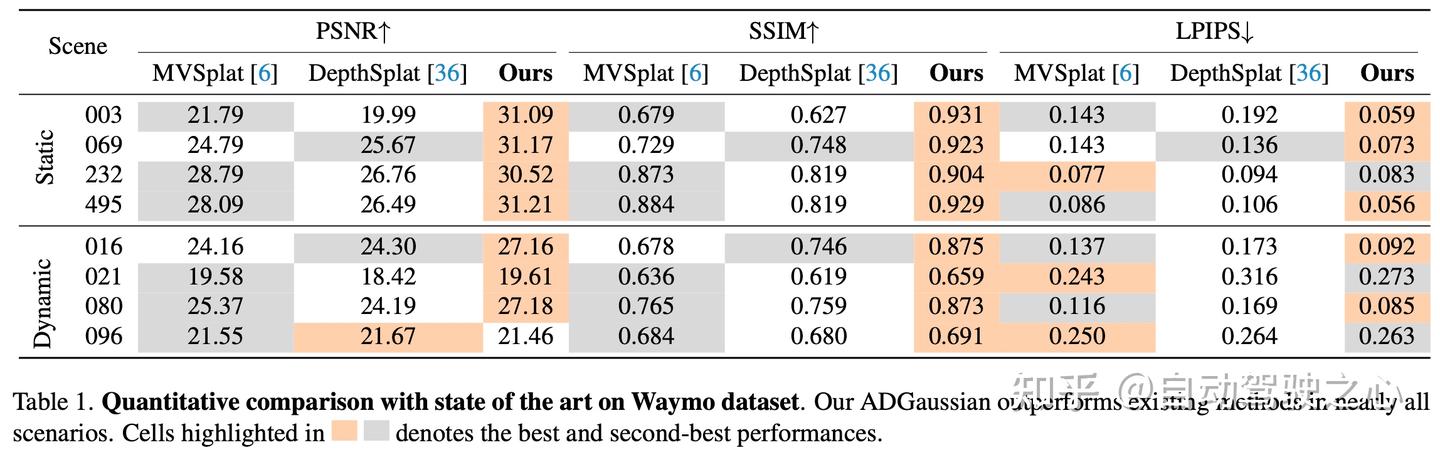

在将我们的工作与当前最先进的GS方法进行比较时,我们选择了基于多视图成本体积的方法MVSplat和基于深度基础模型的方法DepthSplat。由于GGRt具有无姿态架构,我们将其排除在比较之外。在每个场景中,MVSplat和DepthSplat利用两帧作为输入来生成后续新帧以供评估。

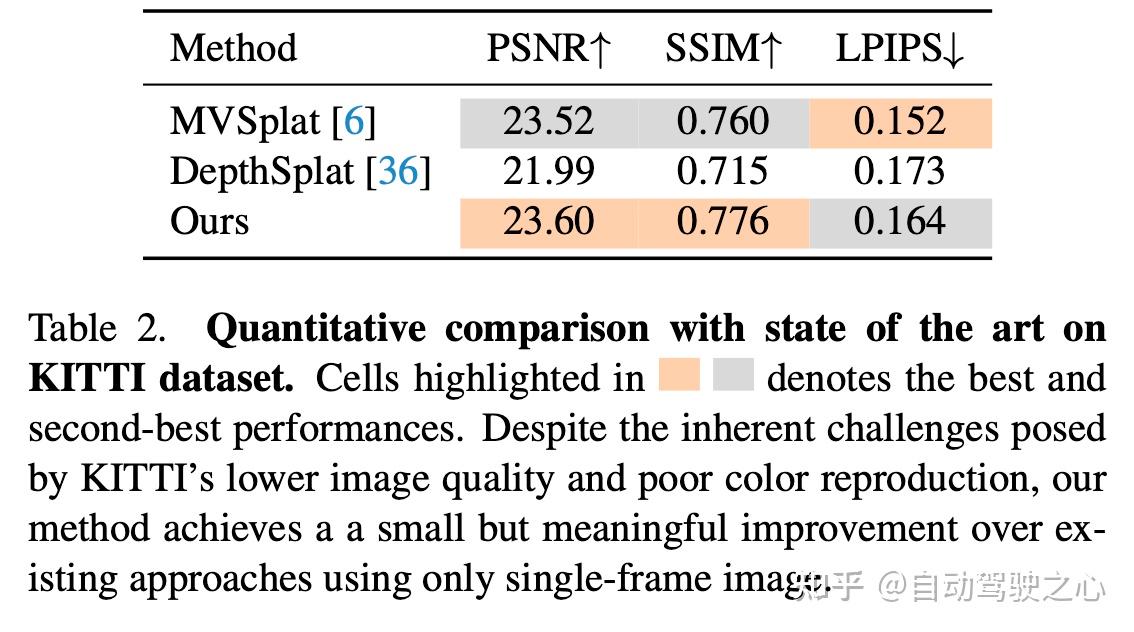

Waymo和KITTI基准上的定量比较分别在表1和表2中呈现。在Waymo数据集上,我们的ADGaussian在几乎所有视觉度量上都超过了先前的最先进模型,特别是在静态场景中表现尤为显著。此外,我们的方法在不同场景中表现出一致的性能,突显了其多模态特征匹配能力的稳健性。

从表2可以看出,我们的方法在KITTI数据集上的性能提升不如在Waymo数据集上那么显著。这主要是由于KITTI数据集整体图像质量较低且色彩再现不佳。由于我们的方法仅依赖单张图像作为输入,因此相比之前的工作保留了较少的图像细节,这进一步限制了其在图像质量较差的数据集上的表现。

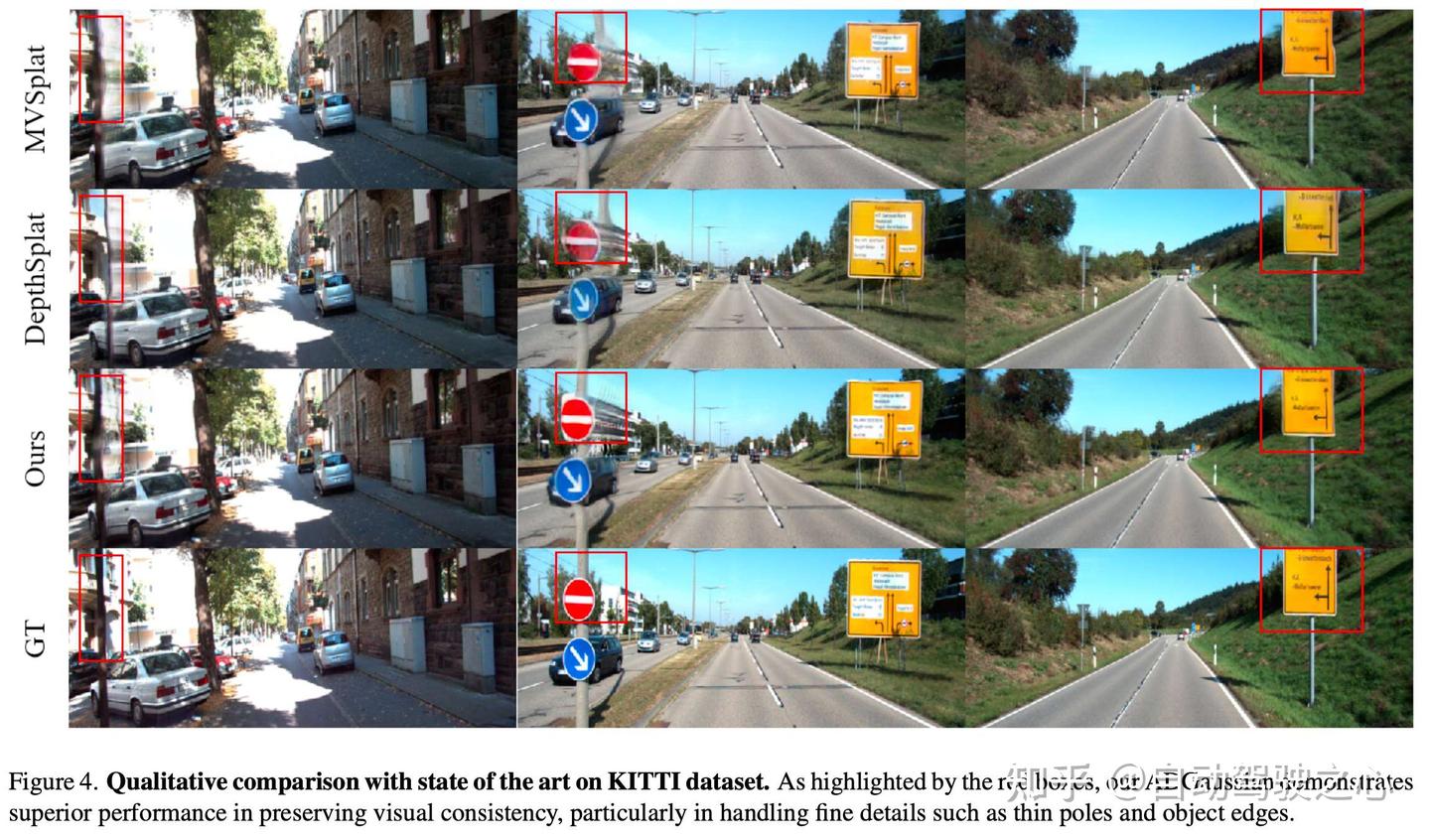

我们在图3和图4中提供了两个数据集的定性比较。可以看出,我们的模型在遮挡区域和细小细节(如纤细信号杆)方面实现了优越的渲染质量。

此外,DepthSplat与MVSplat的比较显示,DepthSplat表现出更强的深度推理能力,这归因于其通过预训练深度模型增强的几何重建。然而,由于外观属性整合不足,DepthSplat在整体视觉重建质量方面表现欠佳,这与我们前面部分的分析一致。

消融研究与分析

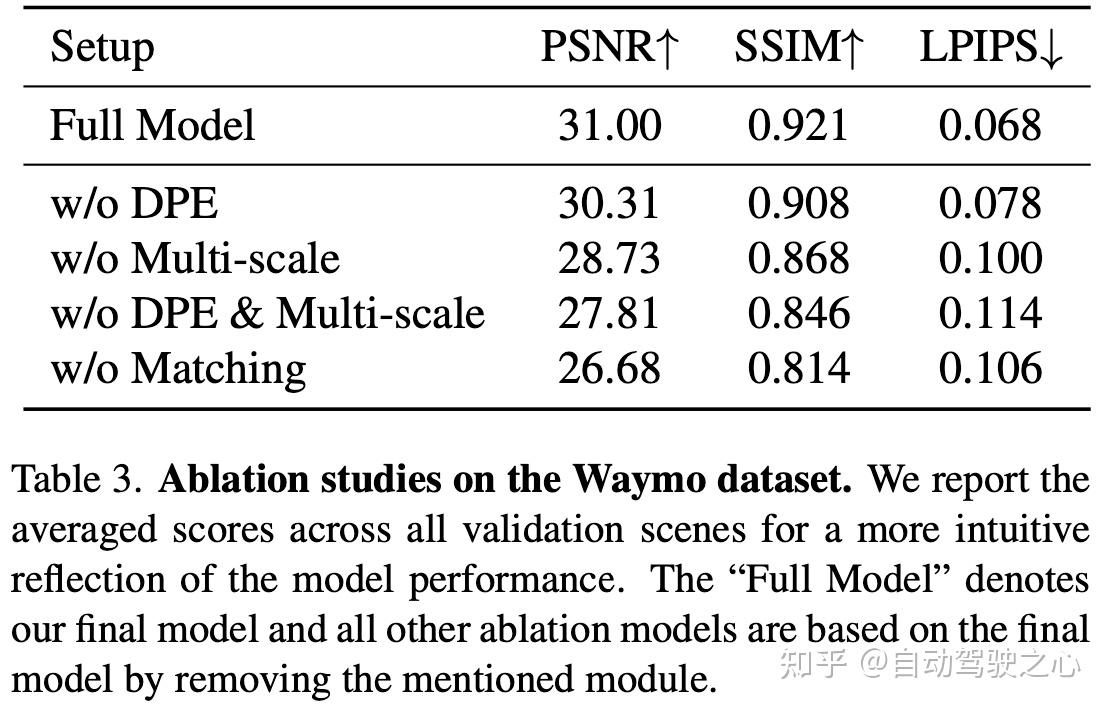

消融研究。表3详细列出了消融研究,以进一步确认所提组件的有效性。首先,可以看到完整模型达到了最高的性能,PSNR、SSIM和LPIPS得分分别为31.0、0.921和0.068。值得注意的是,移除深度引导的位置嵌入(DPE)导致了所有指标的下降(分别为0.69、1.3%和1%),强调了深度线索在促进多模态特征联合优化中的重要性。此外,缺乏多尺度高斯解码(w/o Multi-scale)的模型表现下降,PSNR为28.73、SSIM为0.868、LPIPS为0.100,突显了多层次深度解码和独立高斯推断的有效性。同时移除DPE和Multi-scale导致了更显著的性能下降,尤其是LPIPS得分下降了4.6%。

最后,为了展示我们同步多模态优化公式的效果,我们展示了不使用多模态特征匹配(w/o Matching)的结果,用下一帧的颜色图像替代稀疏深度输入。显然,多模态特征匹配在PSNR、NDS和mAP方面带来了显著提升(分别为4.32、10.7%和3.8%),突显了图像相关外观特征和深度相关几何特征信息交换和同步优化的重要性。

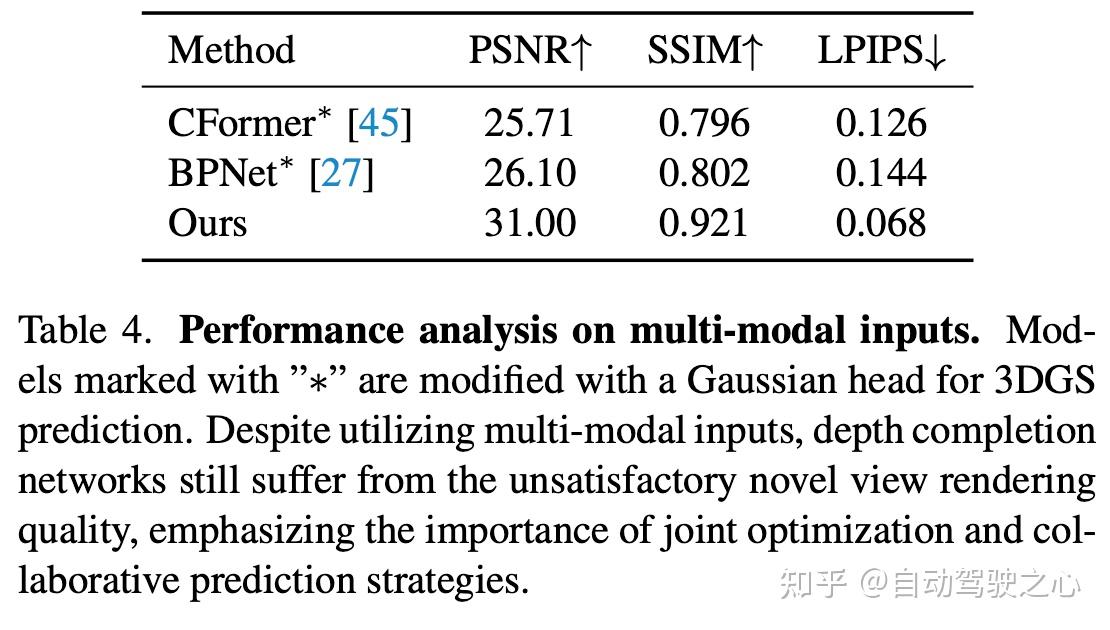

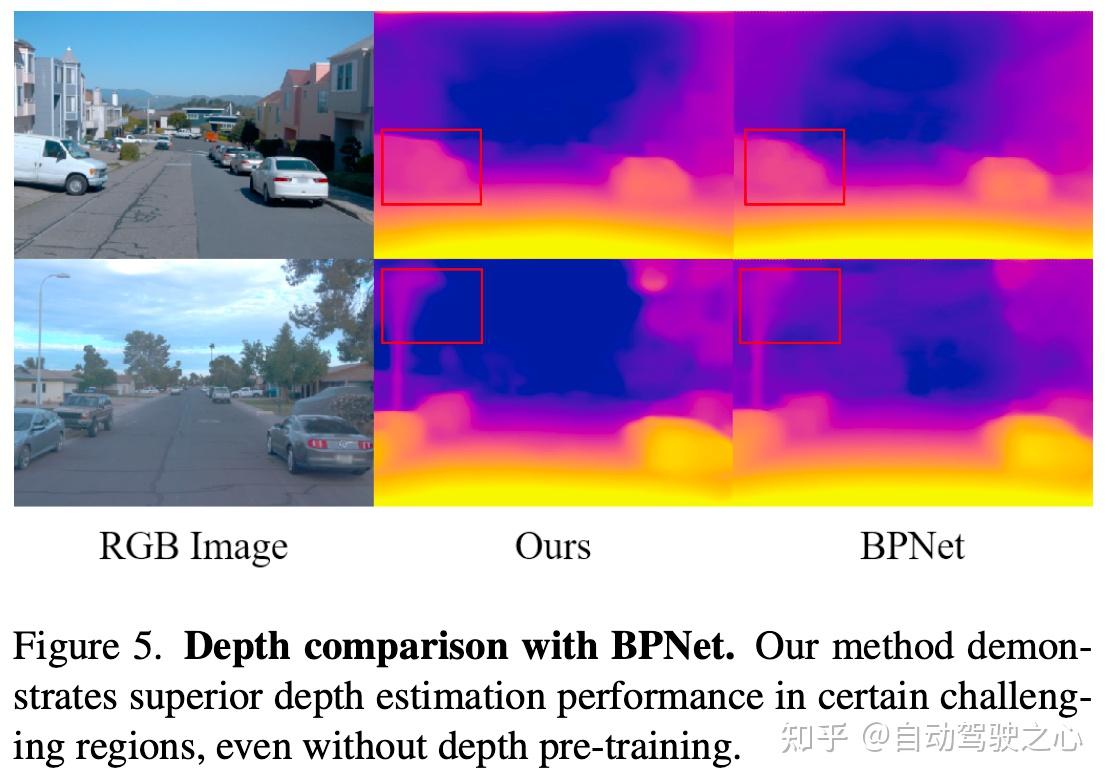

多模态输入分析。为了确保公平比较,我们使用最先进的深度补全方法构建了具有相同多模态输入的基线网络。具体来说,我们将CFormer和BPNet重新实现为比较目标,这些模型同时接受深度和图像作为输入,并使用多模态融合特征预测高斯参数。如表4所示,显然,仅增加额外的深度输入并不能显著提高新视角渲染的质量,进一步突显了我们联合优化的关键需求。此外,图5中的深度比较结果显示,我们的模型在捕捉细粒度细节(如保持汽车和杆子形状)方面表现出色,即使没有在深度补全任务上进行预训练。

跨数据集泛化。我们进行了跨数据集评估,以展示我们方法对分布外新场景的泛化能力。具体来说,直接在Waymo数据集上评估在KITTI数据集上训练的模型,无需微调。如表5所示,即使只有单视角输入图像,我们的ADGaussian方法始终优于DepthSplat,并实现了与MVSplat相当的跨数据集泛化性能,获得了更高的PSNR和SSIM得分。这一结果突显了我们在处理多样和未知场景方面的稳健性。

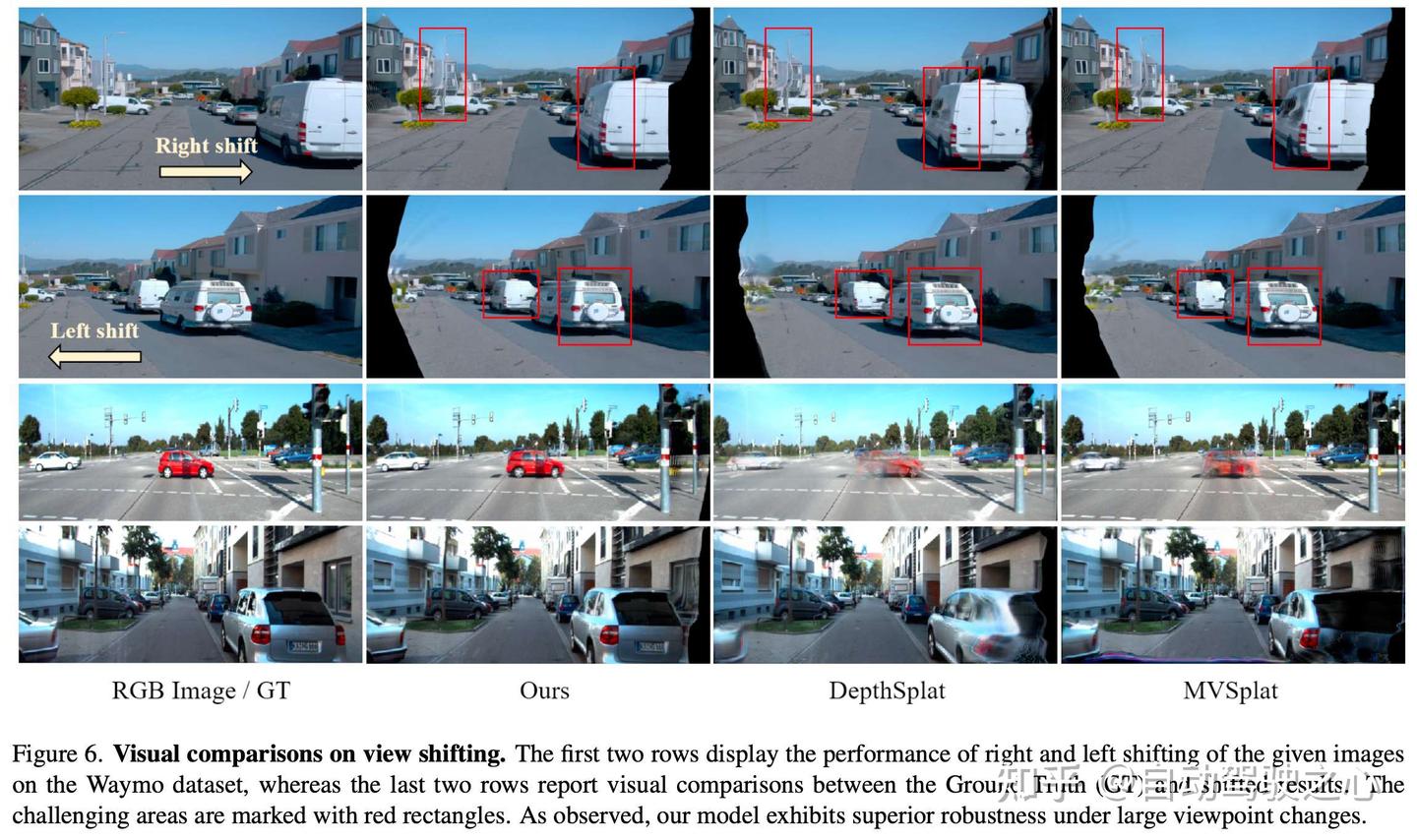

应用:新视角变换

新视角变换的概念涉及从与训练数据中存在的原始视角显著不同的视角生成图像。这项任务特别苛刻,通常需要可靠的深度估计来处理视角、尺度和遮挡的大幅变化。在这项研究中,我们进一步调查了模型在视角变换中的稳健性。首先,使用KITTI数据集中提供的真实右相机图像来评估视角变换的定量性能。如表6所示,我们的模型在零样本视角变换(从左相机到右相机)中显著优于MVSplat和DepthSplat。值得注意的是,我们的零样本视角变换结果仅略低于正常训练模型(PSNR:23.60,SSIM:0.776,LPIPS:0.164)。此外,两个数据集的视觉比较如图6所示。无论是向右还是向左变换,我们的ADGaussian在Waymo数据集上表现出卓越的整体视角变换质量,特别是在捕捉车辆形状和复杂外观细节方面。同样,与KITTI数据集上的真实图像的定性比较进一步验证了我们模型在视角变换中的优越性。

结论和局限性

本文介绍了一种新颖的多模态框架,用于可泛化的街景重建,证明了多模态特征的联合优化显著提高了几何和视觉重建质量。此外,我们验证了我们的模型支持零样本视角变换,突显了其生成可靠尺度线索的能力。

局限性

由于依赖单帧输入,我们的方法在较低质量的数据集上的准确性受到限制,并且在动态场景中的改进不如静态场景显著。这些问题可以通过在未来的工作中有效整合多帧信息来解决。

发表回复