原文链接:https://zhuanlan.zhihu.com/p/1888420130138089130

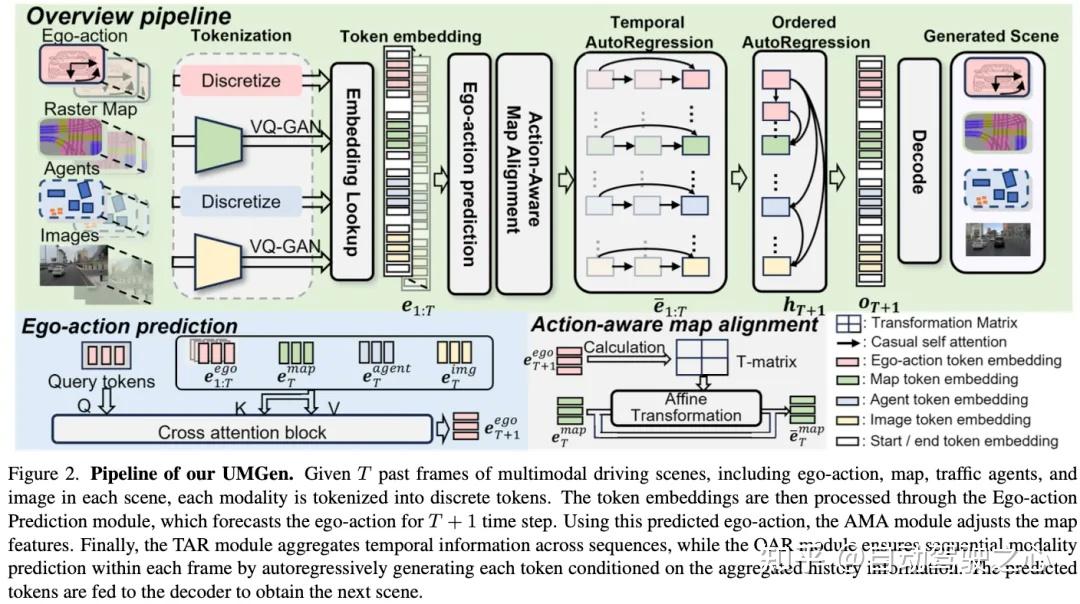

生成模型在自动驾驶(AD)领域中能够实现多样化场景的创建,但现有的方法仅捕捉有限的数据模态范围,限制了生成可控场景以全面评估AD系统的能力。本文提出了一种多模态生成框架,该框架整合了四种主要数据模态,包括新增的地图模态。通过将模态进行标记化处理,我们的场景序列生成框架可以自回归地预测每个场景,同时通过两阶段方法管理计算需求。时序自回归(Temporal AutoRegressive, TAR)组件捕捉每种模态之间的帧间动态变化,而有序自回归(Ordered AutoRegressive, OAR)组件通过按固定顺序依次预测标记来对齐每个场景中的模态。为了保持地图和自车动作模态之间的一致性,我们引入了动作感知地图对齐

(Action-aware Map Alignment, AMA)模块,该模块基于自车动作应用变换以保持这两种模态之间的一致性。我们的框架能够有效地生成复杂且逼真的驾驶场景,并确保多模态一致性,同时提供对场景元素的细粒度控制。

文章引言

生成模型在各个领域的重要性日益增加。在自动驾驶(AD)系统中,生成模型被用于生成多样化的驾驶场景——尤其是那些在数据集中罕见或未充分表示的场景或现实生活中的场景。更重要的是,生成模型可用于构建闭环仿真系统,生成逼真的交互场景,以在部署前测试AD系统,避免潜在事故。这种能力增强了自动驾驶系统在应对现实世界驾驶条件复杂性时的安全性、适应性和可靠性。

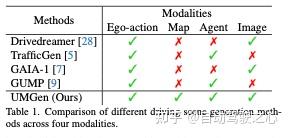

为了生成全面的驾驶场景(如表1所述),大多数现有研究主要集中在生成两种模态。例如,GUMP和 TrafficGen在给定静态地图片段中生成自车动作和代理运动;DriveDreamer和 GAIA-1

能够根据初始条件生成图像。尽管这些方法提供了有价值的见解,但它们仍存在一些局限性。GUMP 和 TrafficGen 缺乏地图进展,限制了其真实感,因为现实世界的驾驶场景涉及从自车视角动态演进的地图。DriveDreamer 和 GAIA-1 无法预测交通代理运动,这限制了对代理行为的控制,从而限制了用户特定场景的生成。

在这项工作中,我们为驾驶场景提出了一个统一的多模态生成框架(UMGen),每个场景包含四个关键模态。我们的框架整合了地图预测以增强场景表示,从而能够更精细地控制自车动作和代理行为。逐场景生成这些模态的同时确保一致性是一项重大挑战。为了解决每个模态的不同领域问题,我们将场景生成视为一个序列场景预测任务。然而,由于来自四种模态的高标记数量和视频数据长度,直接应用自回归(AR)模型是不切实际的。

为了解决这一问题,我们将序列预测任务分解为两个阶段:帧间预测和帧内预测。对于帧间预测,我们提出了时间自回归(TAR)模块,该模块使用因果注意力建模帧间的时间演变,允许每个标记仅受其过去状态的影响。对于场景内预测,我们引入了有序自回归(OAR)模块,该模块通过强制执行结构化的模态顺序来捕获每个场景内的关系,确保模态间的对齐和一致性。TAR 和 OAR 共同有效地捕获跨模态随时间的依赖关系,增强对齐同时降低计算复杂性。为了进一步保持自车动作和地图数据之间的一致性,我们引入了一个动作感知地图对齐(AMA)模块。

AMA 基于预测的自车动作对先前的地图特征应用仿射变换,将其与自车运动对齐。这种重新对齐保持了自车动作和地图模态之间的一致性。通过这些组件,我们的模型展示了强大的多模态驾驶场景生成能力,如图1所示,生成的场景序列可持续长达60秒。此外,得益于 AMA 和 OAR 模块提供的模态对齐能力,我们的模型可以通过控制自车和代理的动作来创建特定的多模态一致场景,例如切入场景。

总之,UMGen 提供了几项关键贡献:

- 我们引入了一种新颖的生成框架,整合了四种不同的模态——自车动作、道路使用者、交通地图和图像——具有灵活性以纳入其他模态,增强了驾驶场景生成的表示和保真度。

- 我们设计了一种计算高效的AR方法,包括TAR和OAR模块,以捕获帧间和帧内的依赖关系,从而以较低的计算成本生成逼真的场景。

- 我们引入了AMA模块,通过对地图特征应用仿射变换与自车运动保持一致,确保自车动作和地图之间的一致性。

我们的实验结果提供了定量和定性的证据,证明了我们方法的有效性,表明UMGen能够生成用户定义的、以自车为中心的场景,适应特定的驾驶条件。

相关工作回顾

自回归生成模型(Autoregressive Generative Models)

近年来,自回归生成模型在自然语言处理和图像生成领域取得了显著成功。例如,GPT-2和 VQGAN是这一类模型的典型代表。这种架构随后被引入自动驾驶场景生成领域,方法如利用它来预测交通代理的行为,而 GAIA-1则将其应用于顺序生成高质量驾驶视频。然而,我们的模型不仅限于生成有限模态的数据,而是针对多模态数据的生成,这些数据共同构成驾驶场景。这种扩展导致标记数量大幅增加,尤其是在场景帧数增多时,使得传统的 AR 方法(如中的方法)——将来自不同场景帧的标记连接成单一序列——变得计算上不可行。此外,仅沿时间维度应用 AR 机制而不结合帧内 AR 机制,可能会导致同一帧内不同模态之间的不一致。相比之下,我们的方法通过并行的时间间预测与帧内 AR 解码相结合,平衡了效率和一致性,从而实现了多模态驾驶场景的生成。

驾驶场景序列生成(Driving Scene Sequence Generation)

传统方法依赖手工设计规则和人类先验知识来生成驾驶场景序列,这限制了它们捕捉现实世界多样性和真实感的能力。近年来,数据驱动的深度学习方法逐渐兴起,但大多数研究仍集中在生成有限的模态集。例如,模型如基于地图片段生成多样的代理轨迹,但无法处理代理的出现和消失问题。GUMP通过类似 GPT 的生成框架解决了这一挑战。然而,缺乏地图生成功能限制了轨迹,使其局限于特定的地图片段和静态视角,这与现实世界中从自车动态视角观察车辆的情况不同。尽管 DriveDreamer2通过生成地图解决了这一限制,但它使用两个独立的网络分别生成地图和视频,导致失去了显式的逐帧控制能力。其他模型如 Dreamforge基于预定义的交通动态生成高质量驾驶视频,这限制了交互性和用户定义场景序列的生成能力。相比之下,UMGen 生成四种关键模态——自车动作、地图、代理和图像——在一个统一框架内丰富了场景表示,并提供了对用户定义场景序列生成的精细控制能力。

UMGen算法详解

问题设定

框架概览

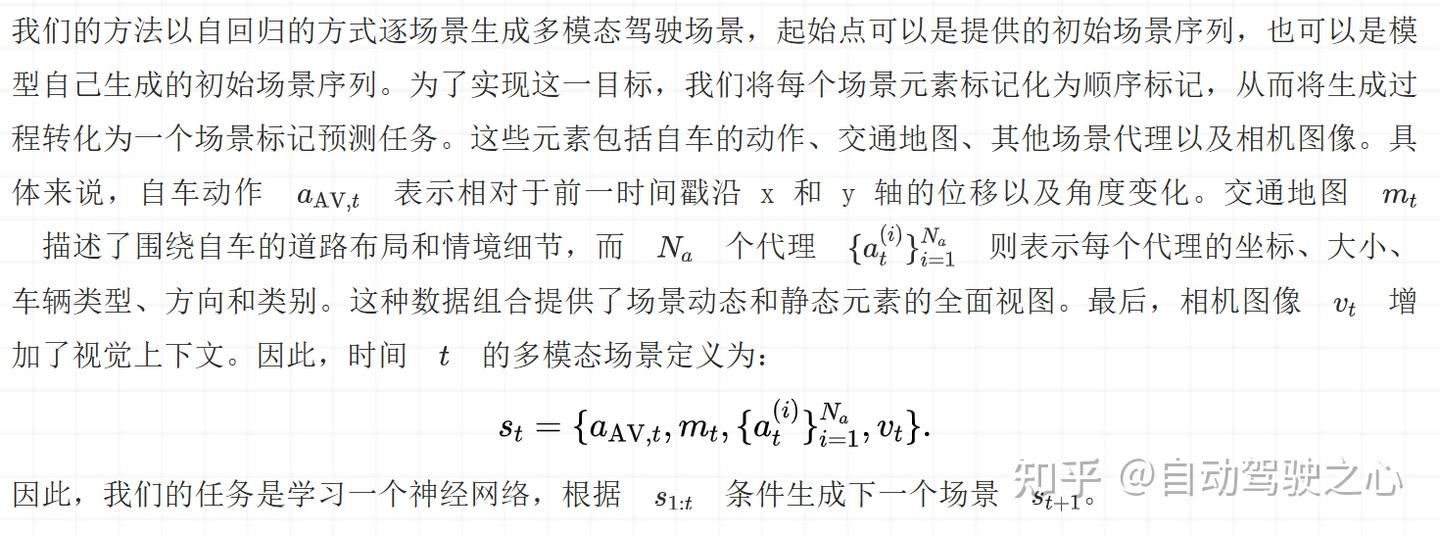

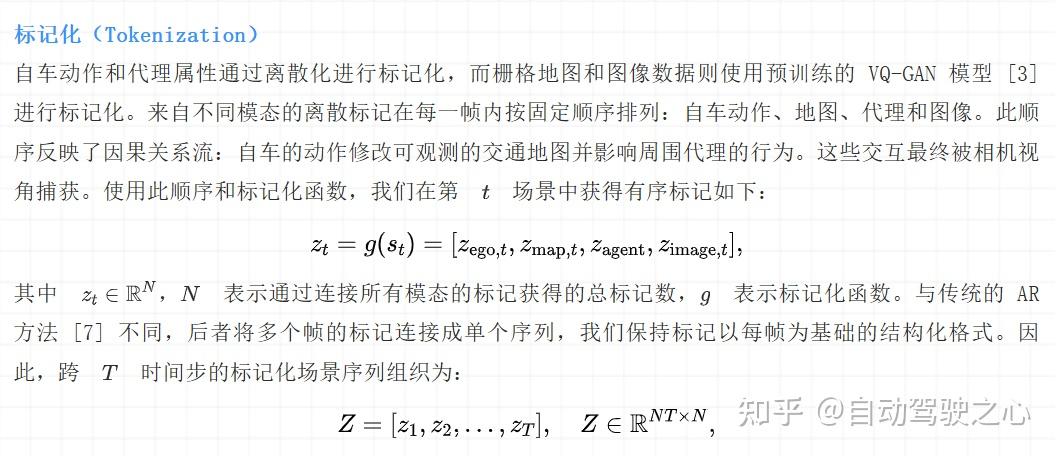

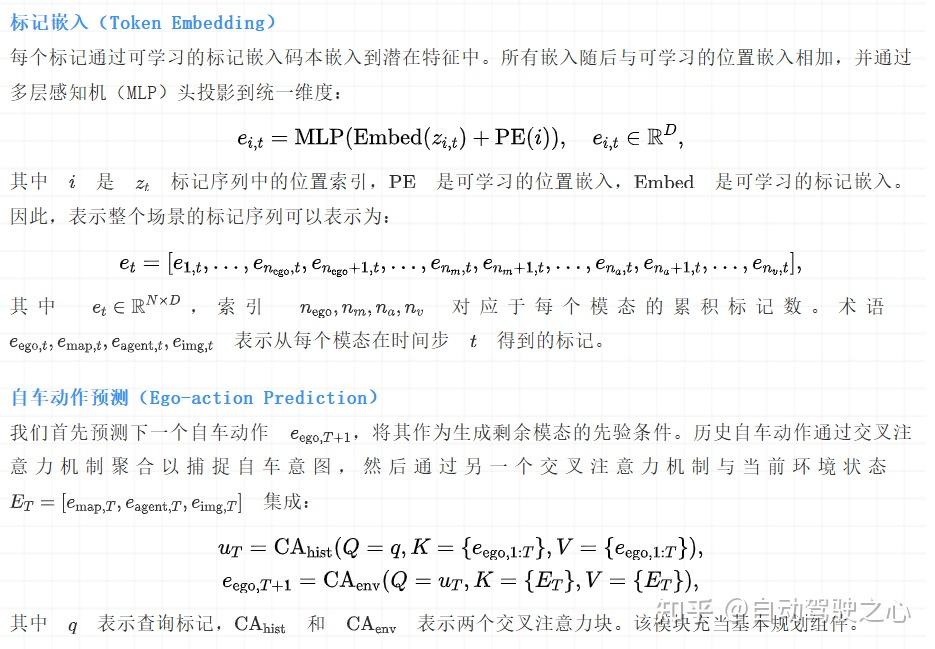

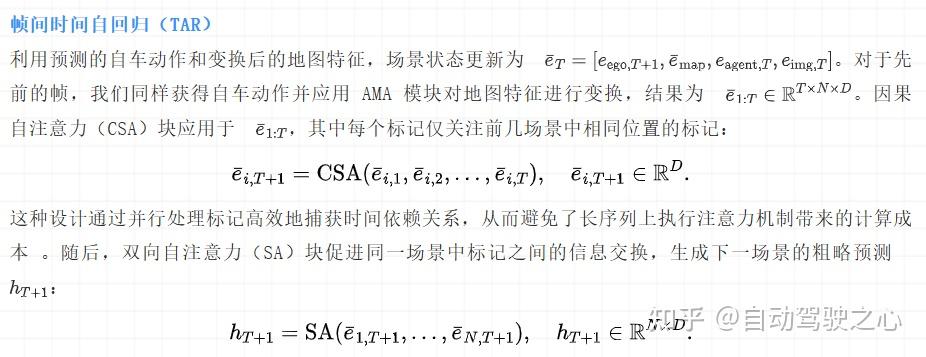

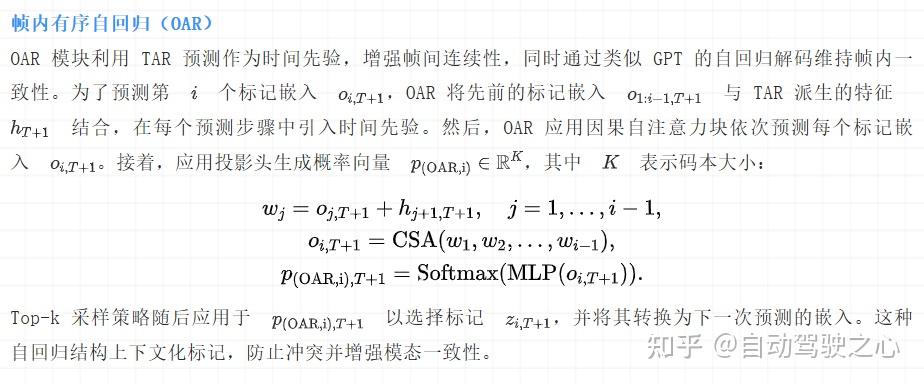

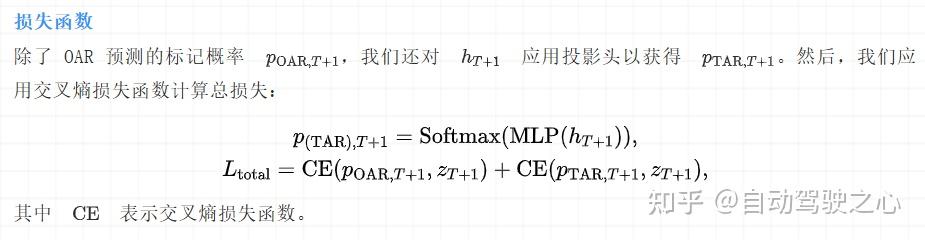

在以下公式中,我们假设过去 T 场景作为输入来预测第 T+1 时间步的场景。我们模型的整体流程如图 2 所示,包含几个核心组件:标记化(Tokenization)、自车动作预测模块(Ego-action Prediction Module)、动作感知地图对齐模块(Action-aware Map Alignment, AMA)、时间自回归模块(Temporal AutoRegressive, TAR)和有序自回归模块(Ordered Autoregressive, OAR)。我们将在下面讨论每个组件。

其中每一帧的标记保留其帧内顺序。这种结构化的标记排列使时间信息能够并行聚合,为后续模块奠定了基础。为了确保每帧的固定标记数量,我们应用填充或联合采样代理,从而在所有帧中保持一致的对象集以保证时间连贯性。

实验结果分析

我们的实验旨在评估 UMGen 在多模态驾驶场景序列生成和用户引导特定场景生成中的有效性。此外,我们还展示了模型能够生成逼真的初始场景,作为序列生成的起点。最后,我们通过消融实验验证了每个模块的关键作用。

实验设置

训练细节

在每次迭代中,我们随机选择一个包含 21 帧的序列,使模型能够利用最多 20 帧的历史信息。训练过程在 32 块 RTX4090 GPU 上进行,持续 300 个 epoch,耗时约两天。

评估细节

我们的实验基于两个公开数据集:nuPlan和 Waymo Open Motion Dataset

(WOMD)。为了评估生成的初始场景的真实性,我们采用了 最大均值差异 (MMD)分数,并遵循 TrafficGen在 nuPlan 和 WOMD 数据集上的实验设置。

MMD 指标量化了生成场景与真实场景中代理属性之间的分布差异。在生成初始场景时,由于没有时间信息的需求,我们暂时丢弃了 TAR 模块。

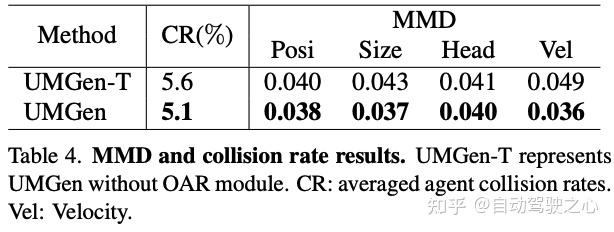

我们提供了基于 nuPlan 提供的初始帧生成的多模态驾驶场景序列的可视化结果,验证了生成多样化多模态场景和用户指定场景片段的能力。为了评估 TAR 模块相对于传统 AR 方法的计算效率,我们测量了推理过程中每标记的推理时间和 GPU 内存峰值使用量。为了验证 OAR 模块在维持标记一致性方面的效果,我们使用了 MMD 指标以及生成道路用户之间的平均碰撞率(CR)。较低的 CR 值表明标记之间的冲突减少,从而证明了更好的一致性。

驾驶场景序列生成

与其他依赖补充条件且仅生成有限模态的方法不同,我们的模型能够仅根据给定的初始帧生成多样化的多模态场景序列。为了展示多模态场景的动态演变以及生成场景的时间和模态一致性,我们在不同时间间隔内展示了两个视频样本。

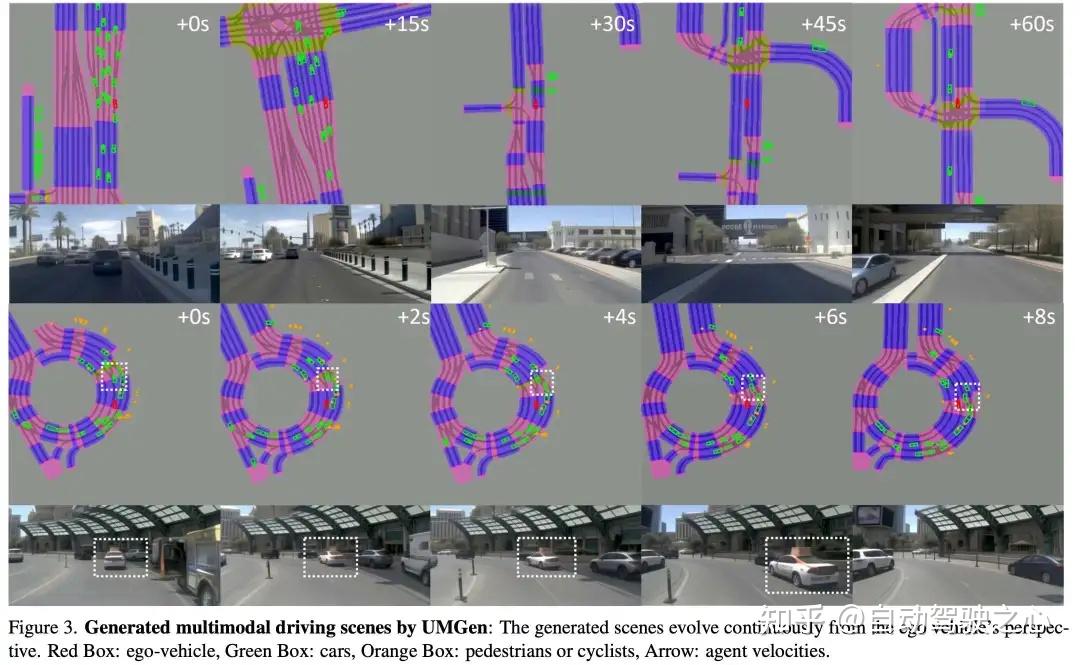

如图 3 的第一行所示,我们以 15 秒为间隔显示生成的场景,展示了随着自车移动所有模态的演变。具体而言,自车执行了车道变更、转弯和直行等操作。地图模态根据自车的运动生成了各种道路元素,包括交叉路口、弯道和直线路段。代理数量从开始时的众多逐渐减少到狭窄道路上的较少。此外,图像模态提供了反映这些动态变化的对应可视化。这种实时多模态生成能力使我们的方法能够模拟更广泛的驾驶世界。图 3 的第二行展示了自车经过酒店入口时以 2 秒为间隔的场景。虚线框用于标记同一辆车在这些帧中的位置,显示其在地图上的位置和运动与生成的图像保持一致。

这种多模态一致性和时间连续性为后续章节中生成特定多模态场景奠定了坚实基础。

初始场景生成

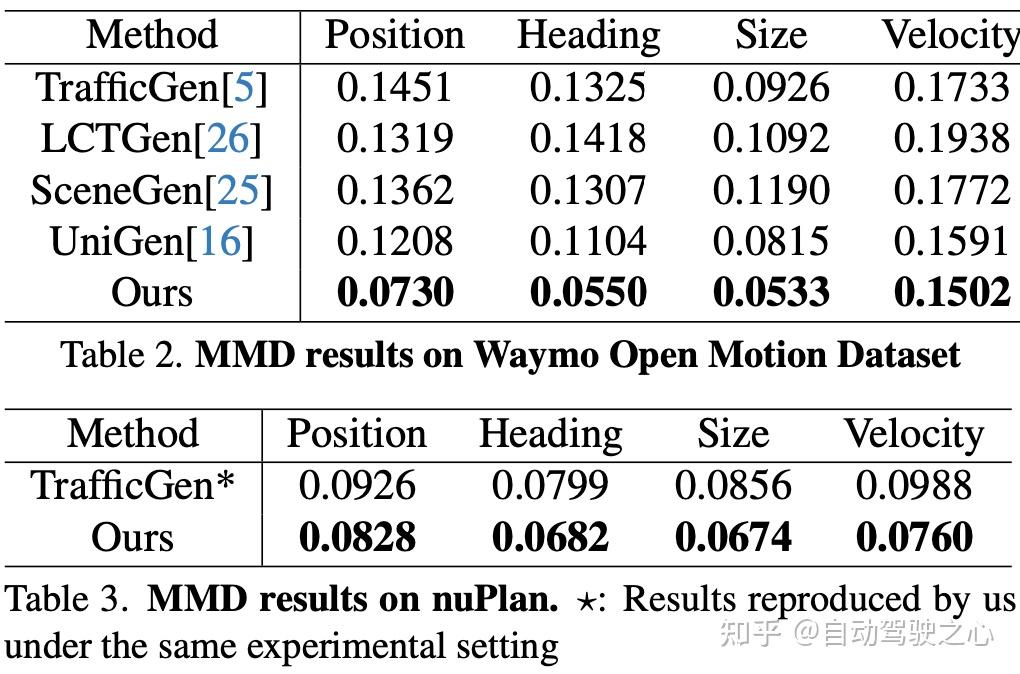

生成逼真的初始场景对于促进驾驶场景序列生成至关重要。为了评估生成的初始场景,我们遵循 TrafficGen的实验设置,并在 WOMD和 nuPlan数据集上评估 MMD 分数。如表 2 和表 3 所示,我们的 UMGen 在所有指标上实现了比其他方法更低的 MMD 值,表明它能够生成更真实的场景。

用户引导场景序列生成(User-Guided Scene Sequence Generation)

生成能够复制现实世界条件的交互式场景序列,并对自车在这些场景中的运动进行控制,对于验证自动驾驶系统至关重要。因此,本节重点展示用户引导场景生成的能力,突出模型在适应多样化自车控制和模拟各种交通互动方面的灵活性。

交互式自车控制(Interactive Ego-Vehicle Control)

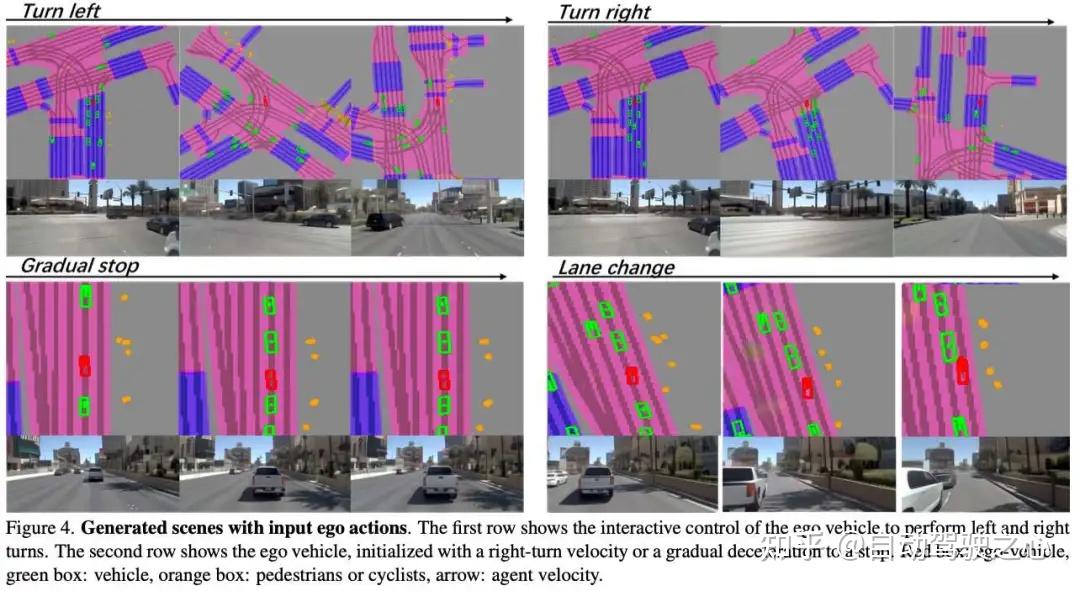

为了展示模型对自车动作的控制能力,我们提供了两个不同生成场景序列的可视化结果。

如图 4 的第一行所示,我们主动控制自车执行左转或右转操作。地图根据自车的动作进行了相应的旋转和变换,而图像模态则提供了这些变化的可视化呈现。值得注意的是,尽管右转后观察到的场景在训练数据集中并不存在,但我们的模型仍然能够生成对应的多模态场景。这表明 UMGen 具备较强的泛化能力,能够在未见过的条件下生成合理的驾驶场景。

此外,我们还展示了模型在复杂场景下的表现。例如,在第二行中,自车被引导穿过一个繁忙的十字路口,同时需要与多个代理车辆进行交互。通过精确控制自车动作,模型生成了动态演变的地图、代理行为以及对应的图像模态。这些结果不仅证明了模型对用户输入的高度响应性,还体现了其在多模态一致性方面的优势。

特定场景生成(User-Defined Scenario Generation)

除了对自车动作的控制外,我们的模型还支持生成用户定义的特定场景片段。例如,用户可以通过指定某些代理的行为(如切入、超车或停车)来创建复杂的交通交互场景。

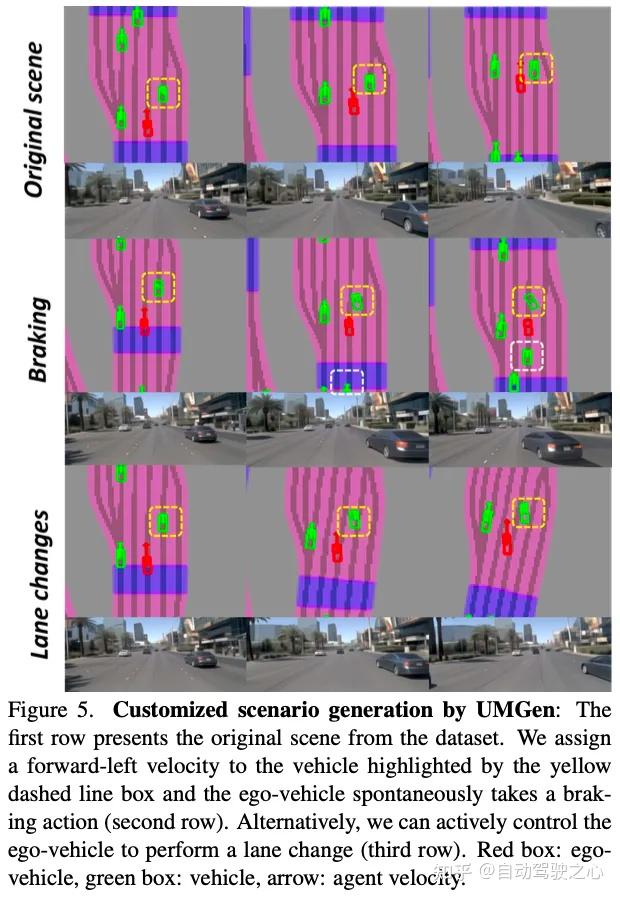

在图 5 中,我们展示了几个由用户引导生成的特定场景。第一个场景模拟了一辆代理车辆从右侧车道切入自车前方的情况。模型成功捕捉到了代理车辆的运动轨迹,并生成了与其行为一致的地图和图像模态。第二个场景展示了一辆代理车辆在自车前方突然停车的情景。模型不仅准确地预测了代理车辆的减速行为,还生成了与之匹配的交通环境和视觉内容。

这些结果表明,UMGen 不仅能够生成多样化的驾驶场景,还可以根据用户需求定制特定的交互场景。这种灵活性使得模型在自动驾驶系统的测试和验证中具有重要应用价值。

定性分析(Qualitative Analysis)

为了进一步评估生成场景的质量,我们邀请了几位领域专家对模型输出进行主观评价。专家们普遍认为,生成的场景在时间连贯性和多模态一致性方面表现出色。特别是在复杂的交通交互场景中,模型能够准确捕捉代理之间的动态关系,并生成逼真的图像模态。

此外,我们还注意到,模型在处理罕见场景时表现出了一定的鲁棒性。例如,在模拟极端天气条件(如大雨或夜间驾驶)下,模型仍然能够生成合理的多模态场景。这些结果进一步验证了 UMGen 在多样化驾驶条件下的适用性。

定量评估(Quantitative Evaluation)

为了量化用户引导场景生成的效果,我们计算了生成场景与真实场景之间的分布差异。具体而言,我们使用 最大均值差异 (MMD) 和 平均碰撞率 (CR) 作为评估指标。

表 4 展示了不同方法在用户引导场景生成任务上的性能对比。可以看出,UMGen 在所有指标上均优于其他基线方法,尤其是在代理行为一致性和图像模态真实性方面表现出显著优势。

消融实验

在本节中,我们对 UMGen 的每个组件进行了分析,以验证其关键作用。

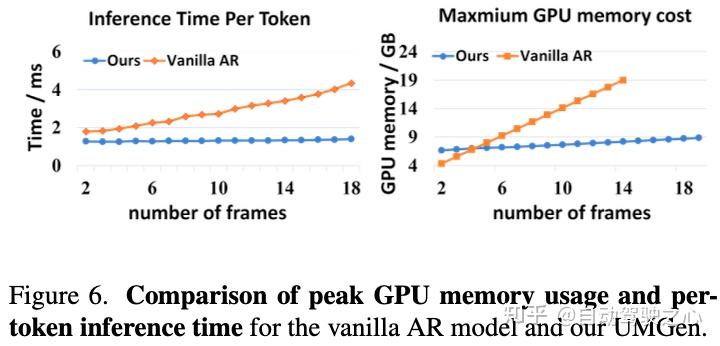

TAR 模块的有效性(Effectiveness of TAR)

我们的 TAR 模块仅对历史帧中相同位置的标记应用因果自注意力机制,从而将时间复杂度从传统 AR 模型中的 降低到 ,其中 是帧数, 是每帧的标记数。这种设计提高了计算效率,并显著减少了 GPU 内存使用量。为了验证这些优势,我们使用传统 AR 模型和 UMGen 进行了对比实验,监测了峰值 GPU 内存使用量和每标记推理时间。如图 6 所示,UMGen 在性能上保持稳定,而传统 AR 模型的 GPU 内存消耗和推理时间随着帧数的增加急剧上升,这突显了长时场景生成的挑战。

无 OAR 解码的影响(Decoding without OAR)

我们的 OAR 模块通过逐帧自回归解码标记,旨在防止帧内标记之间的不一致性。为了分析该组件的影响,我们创建了一个移除 OAR 模块的 UMGen 变体,直接从 TAR 输出解码。此变体被称为 UMGen-T,并在基于 nuPlan 验证集提供的初始帧生成场景序列的任务中进行了评估。性能通过代理之间的平均碰撞率(CR)和生成场景序列的 MMD 分数进行衡量。如表 4 所示,UMGen-T 的 MMD 值更高,表明其生成的场景显得不够真实。

更重要的是,较高的代理碰撞率表明 UMGen-T 在捕捉帧内标记关系方面存在困难,导致冲突更频繁地发生。

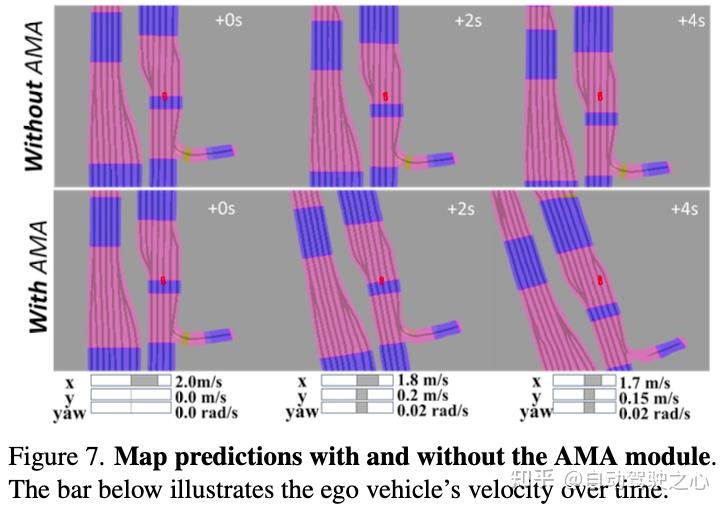

AMA 模块提升一致性(Improved Coherence by AMA Module)

鉴于 AMA 模块在维持地图与自车动作一致性方面的作用,我们进行了实验以评估其影响。我们训练了一个未包含该模块的替代模型。如图 7 所示,当自车沿直路行驶时,我们对其施加一个向前右的速度。启用 AMA 模块后,地图能够准确调整以反映自车的动作;而在没有 AMA 模块的情况下,地图表现出缺乏响应性。这一实验突显了 AMA 模块在增强自车动作与地图模态之间一致性的重要性。

结论

我们提出了 UMGen,一种生成框架,通过整合自车动作、道路用户、交通地图和图像,增强了多模态驾驶场景的生成能力。针对现有方法的局限性,UMGen 将场景生成公式化为一个序列预测任务,利用 Temporal AutoRegressive (TAR) 和 Ordered AutoRegressive (OAR) 模块实现时间连贯性和跨模态对齐,同时降低了计算成本。此外,我们引入了 Action-aware Map Alignment (AMA) 模块,通过动态对齐地图特征与自车运动,确保自车动作与地图数据之间的一致性。实验结果证明了 UMGen 在生成多样化和逼真场景方面的有效性。此外,实验还验证了 UMGen 能够通过控制自车和其他车辆生成用户指定的场景,进一步突显了其作为自动驾驶系统交互闭环模拟器的潜力。

发表回复