原文链接:https://zhuanlan.zhihu.com/p/1889842157684233822

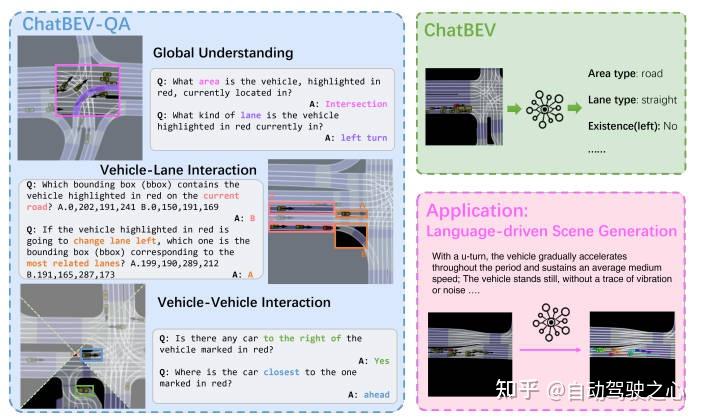

在自动驾驶与智能交通领域,基于BEV地图的理解是实现安全决策的核心挑战之一。本文提出了BEV视觉问答基准 ChatBEV-QA,突破传统数据集任务单一、规模有限的瓶颈,覆盖全局场景、车辆-车道交互、车辆-车辆交互三大维度。此外,本文微调的视觉语言模型 ChatBEV 在多任务中表现卓越,在全局理解、车辆-车道交互以及车辆-车辆交互等诸多任务上均实现了80%的以上的精度,显著超越了现有的方法。

交通场景理解是一项基本任务,旨在感知和解释交通场景中的周围环境。它在智能交通系统和自动驾驶任务中起着至关重要的作用,通过实现智能的决策并确保车辆在现实条件下安全高效地运行,为下游任务奠定基础。例如,在智能交通系统中,交通场景理解通过分析车道结构、交通状况和车辆相互作用来优化交通流量并防止事故发生。在自动驾驶方面,它增强了实时运动规划以实现更安全的导航,并通过情境感知引导改进了场景模拟,确保结果更加精确和可控。

随着视觉语言模型 (VLM) 的发展,最近的研究探索了它们在交通场景理解中的应用。利用其卓越的推理和泛化能力,VLM 能够比传统的、特定于任务的方法更全面地理解场景,而后者往往缺乏整体方法。然而,这一研究领域仍处于早期阶段,充分利用 VLM 进行场景理解需要进一步研究。

为了更好地利用 VLM 的功能并将其无缝地融入到各种任务中,本文工作专注于使用BEV地图进行交通场景理解,这有两个主要优势:

- BEV 图像广泛应用于智能交通系统或自动驾驶,因为它们提供了清晰、直观的环境表征,并且可以轻松地从多模态感知输入中得出,从而确保与下游应用程序的顺利集成

- 直接使用 BEV 可让VLM充分利用其在推理方面的优势,同时减轻其在复杂感知处理方面的弱点,因为 BEV 地图可以独立于原始传感器数据获得。这不仅提高了计算效率,而且还提高了复杂交通环境中的准确性,使VLM更有效地应用于实际应用场景

然而,对 BEV 地图理解的研究一直受到限制,主要是由于缺乏高质量的 BEV 地图注释数据。因此,针对目前的挑战,我们在文中提出了一个名为ChatBEV-QA的Benchmark。该Benchmark是一个基于 BEV 地图的新型场景理解VQA数据集,旨在涵盖广泛的场景理解任务。在此数据集的基础上,我们进一步微调了一个名为ChatBEV的视觉语言模型以进行地图理解,从而实现语言驱动的上下文准确和逻辑一致的交通场景生成。

文章链接:https://arxiv.org/pdf/2503.13938#/;

ChatBEV-QA数据集

自动化数据构建管道

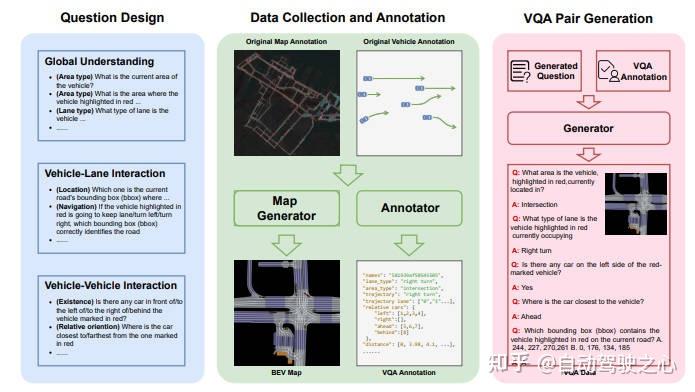

我们提出了一个三步自动化流程,从 nuPlan 数据集

生成 ChatBEV-QA 数据,如下图所示。首先,我们设计各种问题来涵盖全面的理解任务。然后,我们提取必要的注释并生成信息丰富的 BEV 图。最后,VQA 生成器根据问题创建VQA数据,标注和BEV地图。

第一步:问题设计

在本文中,我们建议从三个方面进行全面了解,并据此进一步发展六种不同类型的问题。

- 全局理解:了解更广泛的环境背景对于预测车辆行为至关重要。不同的场景会产生不同的运动模式,例如,十字路口的车辆更有可能转弯,而停车场的车辆则倾向于保持静止。因此我们引入了area type和lane type两种关键问题。

- 车辆与车道的相互作用:最近的研究经常忽视车辆与车道的相互作用,而这对于响应道路特征、交通规则和环境因素的自适应导航至关重要。因此我们引入了location以及navigation两个重要的角度。

- 车辆与车辆交互:车辆与车辆交互对于空间关系建模至关重要,直接影响行为协调。因此引入了existence以及relative orientation两类问题。

这些问题提供了一个结构化的框架,用于理解场景中车辆行为和交互的各个维度。为了增加多样性,我们进一步为每种问题类型设计了多个模板。

第二步:数据收集和标注

nuPlan 的原始注释涵盖了车辆位置、速度和车道细节等基本信息。我们增强了数据集,并设计了一个注释器,该注释器具有广泛的基于规则的函数,可以提取高级语义信息并适用于设计的问题。我们通过迭代的人工参与审查过程严格完善函数的设计,确保其输出与人类判断紧密一致。

- area type代表指示车辆当前所处的区域类型;

- lane type指定车辆当前所在车道的类型;

- trajectory描述车辆未来 50 个时间戳的轨迹对应的类别;

- trajectory lane捕获接下来 50 帧中与轨迹对应的所有车道 ID;

- relative cars存储车辆周围四个方向的其他车辆的 ID;

- distance计算当前车辆与场景中所有其他车辆之间的距离;

第三步:VQA对生成

有了问题模板和注释,就可以通过 VQA 生成器生成问题答案对。对于车道类型和区域类型的问题,生成器会随机选择一个模板并使用相应的注释文本作为答案。对于位置和导航问题,我们通过提供多项选择来简化问题。原始 nuPlan 数据集呈现长尾分布,例如直车道上有大量车辆,而转弯车道上车辆相对较少,导致答案类别分布不平衡,这可能会使模型性能偏向更常见的场景。为了缓解这个问题,我们采用了随机欠采样技术,在数据集构建过程中有选择地从多数类别中删除一定比例的样本,从而促进更均衡的分布。

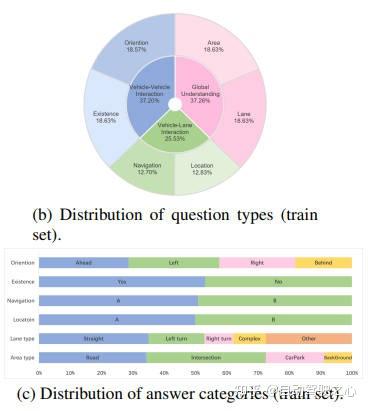

数据集统计和指标

由于整个 nuPlan 数据集非常大,我们从 nuPlan-mini 拆分中构建数据,从而提供更小、更易于管理的子集。总体而言,我们的 ChatBEV-QA 包含 25331 张 BEV 图像的 137818 个问答对,其中 21634 张 BEV 图像中有 116112 个问题用于训练,3697 张 BEV 图像中有 21706 个问题用于测试,平均每张图像约有 5.44 个问题。

下图展示了训练集上每个问题的问题类型和答案的分布,凸显了 ChatBEV-QA 的均衡组成。

由于我们设计的问题的答案属于特定集合,因此我们使用 top-1 准确率作为评估指标,这与以前的 VQA 工作中的常见做法一致。我们还分别评估了不同问题类型的表现,从而可以更详细地了解模型处理场景理解各个方面的能力。

ChatBEV系列模型

除了提出的数据集以外,我们也提供了我们的基线模型。由于 BEV 表示固有的紧凑性,其包含不同于自然图像的特定结构和与任务相关的语义信息,因此现有的 VLM 直接应用于此任务被证明是不够的。

为了解决这个问题,我们通过使用 LoRA 的视觉指令调整对几个先进的 VLM 进行了微调,并根据 BEV 地图理解的独特需求对其进行了定制。

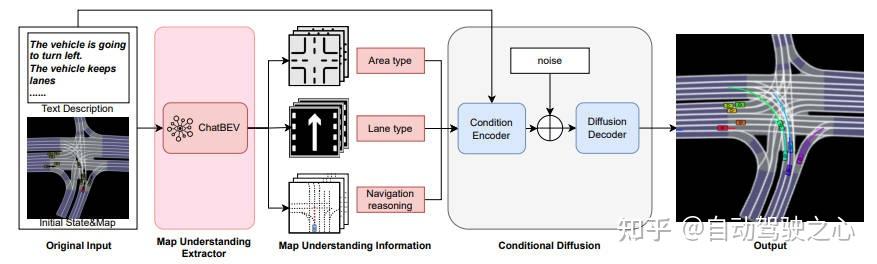

语言驱动场景生成

在本文中,我们提出了一种新颖的基于扩散的架构,其中 ChatBEV 充当地图理解提取器,提供全面的场景理解,从而有助于生成更精确、更具情境信息的输出。其整体流程如下图所示。

地图理解提取器

条件扩散模型

我们的条件编码器旨在有效地整合各种条件输入,并提供信息丰富的条件嵌入,从而促进后续的解码过程。在提取器之后,条件编码器为每个场景接受三种类型的输入:初始状态、文本描述和理解信息。对于每个输入,采用相应的前馈编码模块来提取嵌入,然后沿时间维度进行广播,之后将它们连接起来形成最终的条件嵌入。

给定条件输入,扩散解码器通过迭代细化噪声数据,在每个时间戳生成预测轨迹。这里我们采用 CTG++作为我们的扩散解码器模块。该过程首先将来自条件编码器的条件嵌入与来自前馈模块的预测未来轨迹嵌入沿时间维度连接起来。采用去噪步骤 k 的正弦位置编码来结合时间动态。编码轨迹经过时间注意块来捕捉代理关系,然后经过空间注意块来捕捉几何关系。然后,地图注意层将车道点转换为车道向量,通过多头注意实现地图感知。最后,将编码的轨迹投影回输入维度,产生预测的动作轨迹,然后通过动态函数获得结果。

实验结果

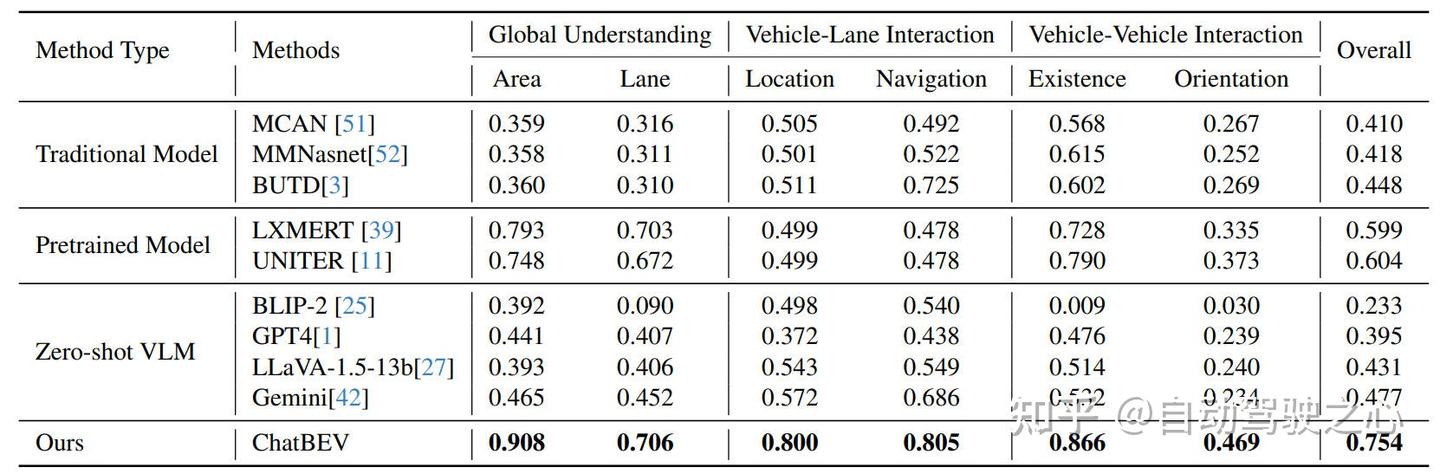

我们在ChatBEV-QA上进行了实验,并将实验结果汇总在了如下的表格中。根据相应的实验结果可以看出,即使经过仔细的训练,传统方法也难以准确解释 BEV 图并生成精确、合理的答案。

虽然 LXMERT和UNITER比传统方法取得了显著的进步,凸显了利用先验知识和预训练视觉语言模型的泛化能力的好处,但它们的性能仍然不够理想,特别是在车道交互推理方面,凸显了它们在适应 BEV 地图理解方面的局限性。Zero shot VLM 的表现与经过训练的传统方法相当,这表明领域差距显著影响了 VLM 的性能。相比之下,我们的 ChatBEV 在对数据集进行微调后,显著超越了现有方法,证明了我们的数据集和微调模型对于场景理解任务的有效性。

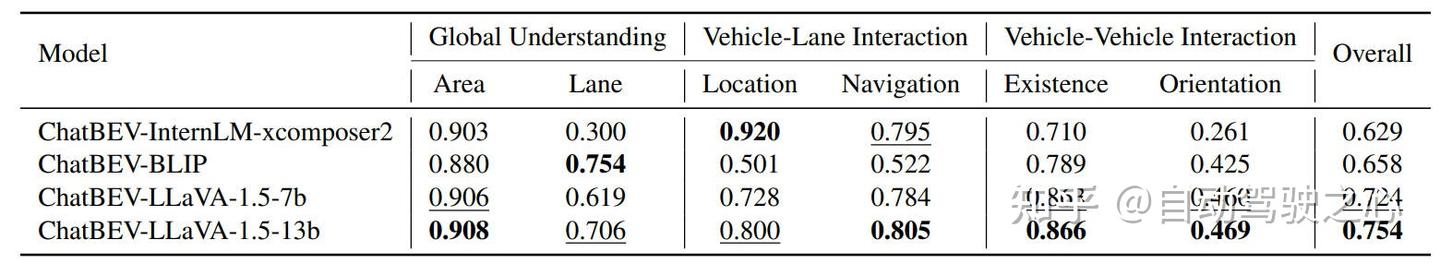

此外,我们通过微调几个最先进的模型来评估不同基础 VLM 的影响,包括 LLaVA、BLIP和 InternLM-Xcomposer2,相关的实验结果汇总在如下表格中。

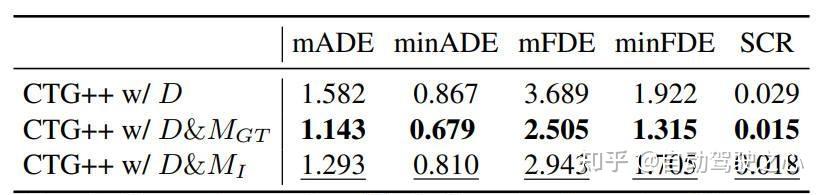

为了评估场景理解对场景生成的影响并评估 ChatBEV 的贡献,我们比较了模型在各种输入条件下的生成性能,实验结果如下表所示。

通过实验结果可以看出,仅提供文本输入对于准确场景生成的指导有限。添加真值地图理解可显著提高重建能力。虽然 ChatBEV 可能会在场景理解中引入一些错误,但它的加入仍然提高了性能。

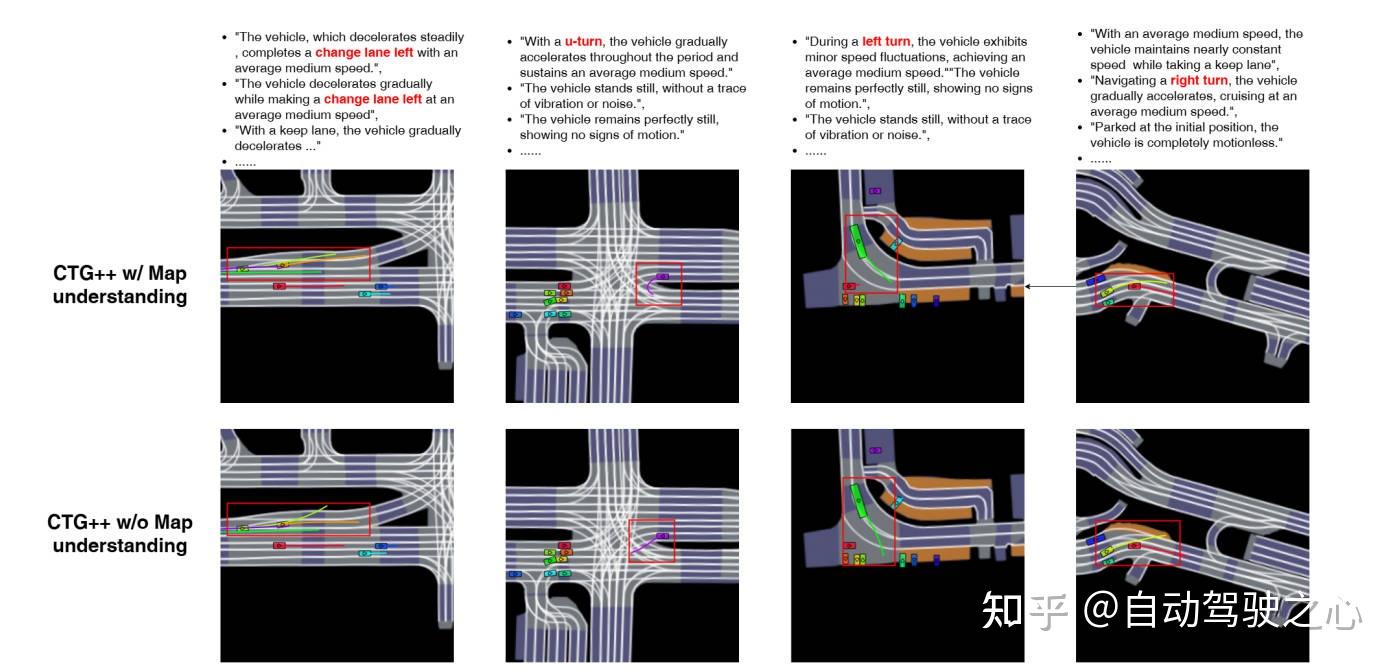

我们对结合地图理解信息的方法和不基于 CTG++ 扩散解码器的方法进行了定性比较。下图展示了几个示例。可以看出,在结合地图理解信息后,该模型表现出对车道地图的更好、更直观的理解,并减少了跑出车道的情况。

结论

在本文中,我们引入了 ChatBEV-QA,这是一个可扩展的 BEV的VQA 基准,涵盖了广泛的场景理解任务。在此基础上,我们的 ChatBEV 模型在全面场景理解方面表现出色,可以提供高级指导,实现更可控的场景生成。此外,我们的基准测试目前仅关注静态场景和与车辆相关的任务,缺乏理解动态场景和行人活动的能力。我们未来的工作将扩展到更复杂的环境,结合多智能体交互、时间推理来增强通用性。

发表回复