摘要

自动驾驶是一项具有挑战性的任务,它要求感知和理解周围环境以规划安全的行驶轨迹。尽管现有的基于视觉的端到端模型已经取得了有希望的结果,但这些方法仍然面临视觉理解、决策推理和场景泛化的挑战。为了解决这些问题,提出了一种名为GPVL(Generative Planning with 3D-Vision Language Pre-training)的生成性规划模型,用于端到端的自动驾驶。该提出的范式有两个显著方面。

一方面,设计了一个3D视觉语言预训练模块,旨在弥合鸟瞰图中视觉感知与语言理解之间的差距。另一方面,引入了一个跨模态语言模型,以自回归的方式根据感知和导航信息生成全面的驾驶决策和精细的轨迹。

在具有挑战性的nuScenes数据集上的实验表明,与最先进方法相比,所提出的方案实现了优异的性能。此外,当处理各种场景中的高级指令时,GPVL表现出强大的泛化能力

和实时潜力。GPVL的有效、稳健和高效的性能对未来自动驾驶系统的实际应用至关重要。

©️【深蓝AI】编译

论文标题:Generative Planning with 3D-vision Language Pre-training for End-to-End Autonomous Driving

论文作者:Tengpeng Li, Hanli Wang, Xianfei Li, Wenlong Liao, Tao He, Pai Peng

论文地址:https://arxiv.org/pdf/2501.08861

官方网站:https://github.com/ltp1995/GPVL

01 介绍

自动驾驶要求系统能深刻理解周围环境以确保安全和高效的部署。优秀的自动驾驶系统需要全面感知驾驶环境,并基于道路信息精确规划行驶路径。

近年来,端到端的自动驾驶框架通过传感器数据理解和输出规划决策,取得了显著进展。然而,早期方法因缺乏对驾驶场景的深入理解,导致解释性有限且难以收敛。为改善性能,一些方案利用传感器信息集成多个视觉任务,如3D目标检测和运动预测,但这些方法在结合上下文线索进行决策方面仍存在挑战。随着大型语言模型的发展,其推理能力被应用于自动驾驶,尽管如此,这些模型在处理复杂的3D空间关系时表现不佳。

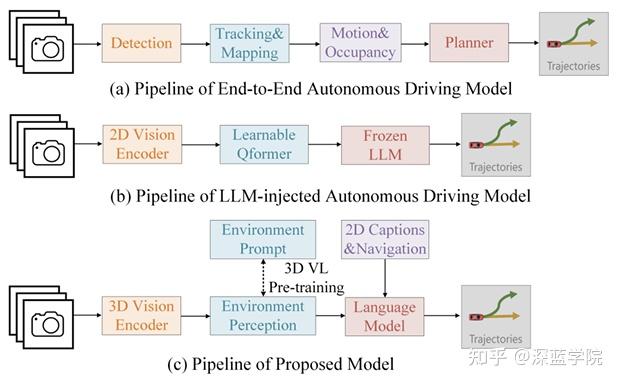

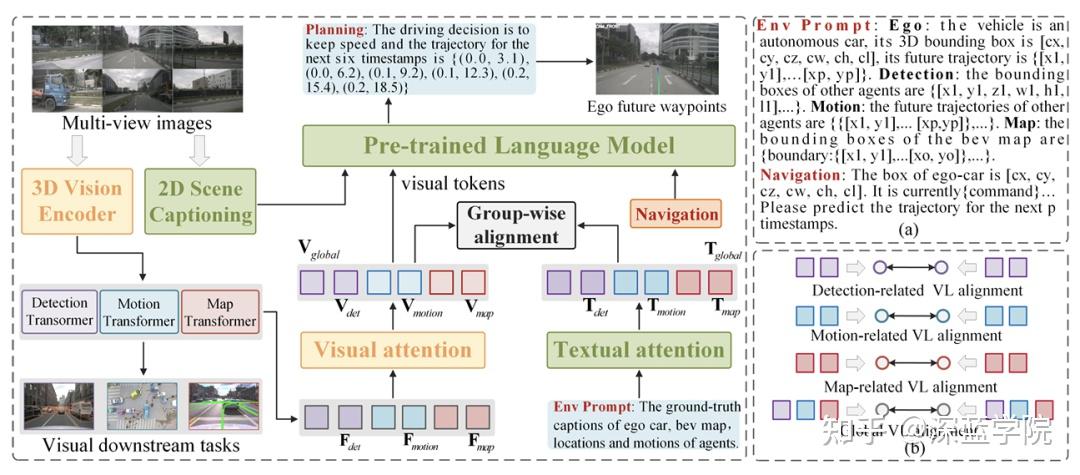

为了克服这些问题,提出了一种新的基于3D视觉语言预训练的生成性规划(GPVL)范式,如图1所示。GPVL首先提取多视角图像的鸟瞰图特征,涵盖基本语义元素;然后引入矢量化变换器学习关键感知信息。接着,开发了一个3D视觉语言预训练模块,对齐视觉特征与语言表示,促进共享特征空间

内的3D场景理解和文本推理。此外,基于预训练模型设计了2D场景字幕模型,用于生成描述。最后,将视觉字幕、对齐的3D特征和导航指令输入语言模型,自回归地生成驾驶决策和轨迹。本文的主要贡献在于以下几个方面:

- 提出了一种3D视觉语言预训练模块,建立了视觉和语言特征之间的组内相关性,有助于对驾驶环境的深入理解。

- 开发了一种跨模态语言模型,以自回归方式利用字幕、感知和导航信息生成决策和轨迹,赋予模型推理和生成能力。

- 我们提出了一个基于3D视觉语言预训练的生成性规划框架,该框架学习语言引导的感知特征并生成情境化轨迹,从而提高系统的安全性。

02 相关工作

端到端自动驾驶

端到端自动驾驶旨在创建一个完全可微的系统,直接将传感器数据转化为车辆控制指令,整合感知、预测、规划和控制模块以减少累积误差并提高安全性。现有模型可分为开环和闭环方法:前者如Hu等人(2023)和Jiang等人(2023)在真实数据集上进行训练评估;后者使用模拟器如CARLA获取反馈,优化未来位置和动作特征。

大型语言模型在自动驾驶中的应用

大型语言模型(LLM)的应用增强了自动驾驶系统的决策能力。研究如Dilu(Wen等人,2023)和GPT-driver(Mao等人,2023)利用LLM生成合理轨迹,并通过多模态语言模型建立视觉与语言间的语义关联。然而,这些方案在三维空间感知和语言表示对齐方面存在不足。本工作引入BEV视觉变换器和3D视觉语言预训练模块,以解决上述挑战并实现鲁棒轨迹生成。

03 本文方法

所提出的GPVL的整体框架如图2所示,包含三个关键组件:(1) 主干网络基于提取的鸟瞰图(BEV)特征生成监督下的检测、地图和运动特征;(2) 3D视觉语言预训练模块旨在将视觉和语言特征对齐到一个共同的语义空间中;(3) 跨模态语言模型以生成式的方式产生可靠的决策和轨迹。

3D视觉语言预训练

3D视觉语言预训练模块是通过对比学习开发的,旨在建立视觉和语言模态之间的多层次对齐。一些先前的方法引入了预训练的大规模语言模型以增强对驾驶场景的感知和理解。然而,这些方法要么缺乏3D空间信息,要么在不同表示之间存在语义差距,这阻碍了基于提取特征的准确目标定位和轨迹推断。相比之下,所提出的模型利用监督检测、运动和地图特征来感知目标的3D空间分布,并通过3D视觉语言预训练模块最小化不同特征之间的语义差距。3D视觉语言预训练模块是通过对比学习开发的,旨在建立视觉和语言模态之间的多层次对齐。一些先前的方法引入了预训练的大规模语言模型以增强对驾驶场景的感知和理解。然而,这些方法要么缺乏3D空间信息,要么在不同表示之间存在语义差距,这阻碍了基于提取特征的准确目标定位和轨迹推断。相比之下,所提出的模型利用监督检测、运动和地图特征来感知目标的3D空间分布,并通过3D视觉语言预训练模块最小化不同特征之间的语义差距。

04 实验

数据集和自动评估指标

实验在nuScenes数据集上进行,该数据集包含1,000个交通场景,每个视频约20秒,提供超过140万个3D边界框。评估指标包括位移误差(L2)和碰撞率(Collision),以及延迟(Latency)和帧每秒(FPS)来衡量实时性能。

实现细节

模型预测未来3秒的轨迹,输入图像大小为1280 × 720,使用ResNet50提取特征,BEV查询、边界框和地图点数量分别为200 × 200、200和100 × 20。训练使用AdamW优化器,学习率分三个阶段调整,最终模型在PyTorch框架下用8张NVIDIA RTX A6000显卡训练。

与最先进方法的比较

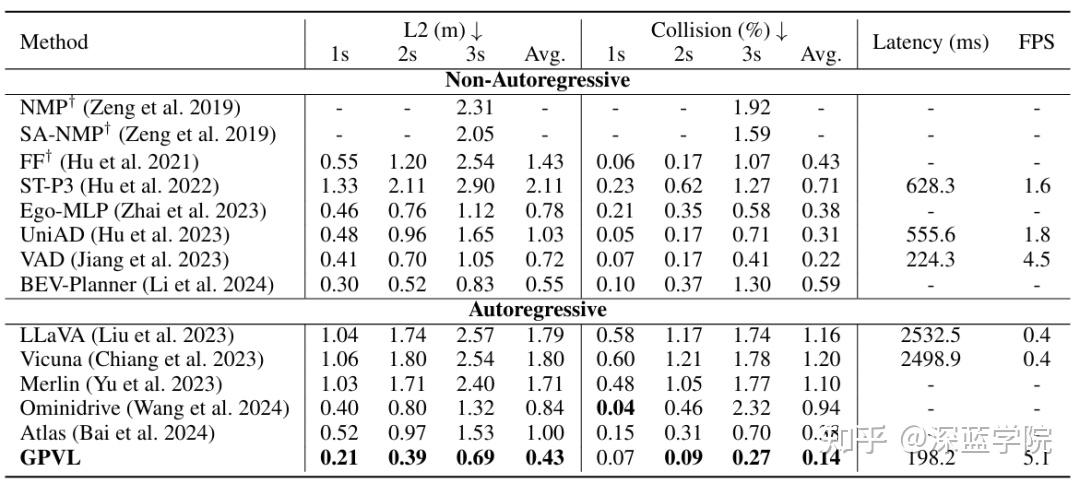

将所提出的方案与13种自动驾驶方法进行了比较,包括8种传统的非自回归方法

和5种注入LLM的自回归方法。

定量结果。表1展示了所提出的GPVL与其他最先进方法的统计对比。总体而言,GPVL的统计性能明显优于其他方法。具体来说,在L2距离指标上GPVL获得了最低的分数,相比VAD它分别在1秒、2秒、3秒时减少了0.18米、0.28米、0.34米的规划位移误差,平均减少了0.27米,这表明其轨迹预测的准确性更高。此外,GPVL在大多数碰撞率指标上的表现最佳,突出了其在避免碰撞方面的卓越安全性和稳健性。与引入辅助任务或利用LLM的方法相比,所提出的方法保持了相当的规划性能,并实现了188.7毫秒的延迟和5.3 fps的推理速度,显示了其实用应用的潜力。根据BEV-Planner的报告,所提出的方案排除了自我状态信息以防止快捷学习。

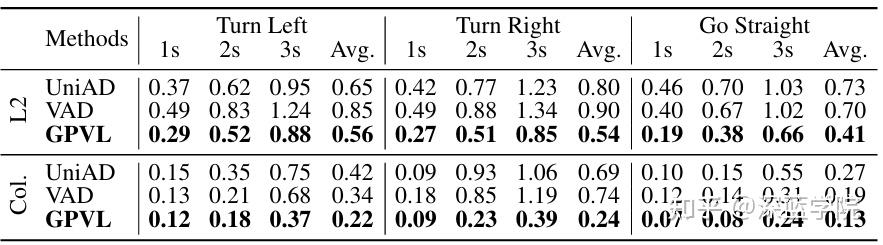

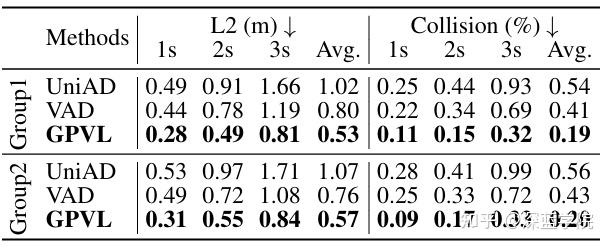

表2显示了左转、右转和直行命令下的L2和Collision评分。显然,GPVL在所有指标上都显著优于UniAD和VAD。在nuScenes数据集中,87.7%的训练样本和88.2%的验证样本是简单的直行场景。因此,UniAD和VAD更容易在这些样本上过拟合并学习捷径,导致在更复杂的转弯场景中的表现不佳。相比之下,所提出的方法在各种场景中都获得了有利的结果,展示了在不同驾驶情况下的强大泛化能力。

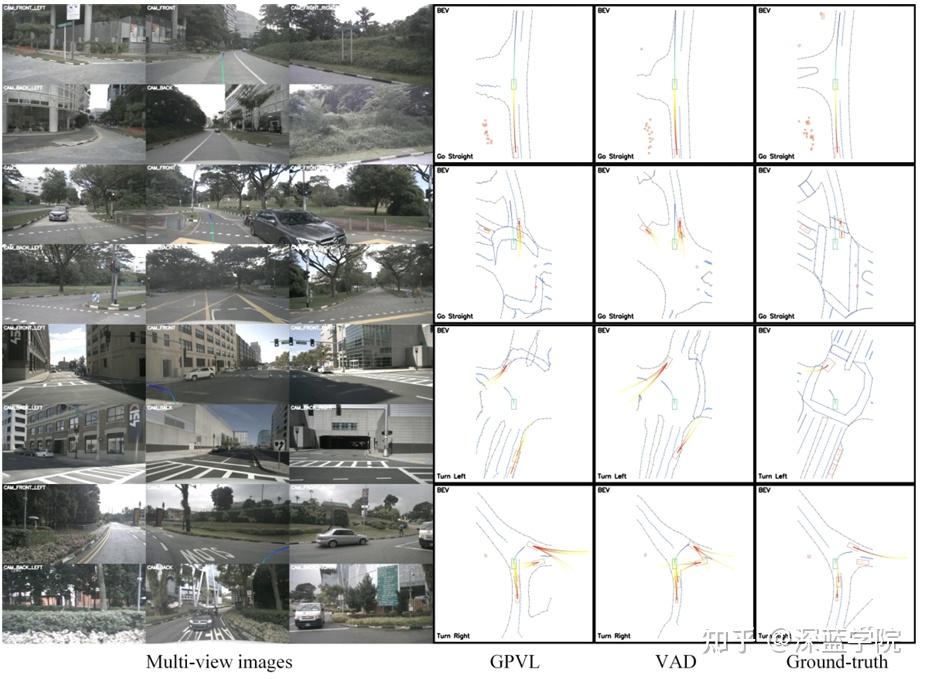

定性结果。图3展示了GPVL生成的规划结果与VAD及真实情况的对比。为了提供对驾驶场景的全面理解,包含了多视角相机图像,并在前视图中可视化了规划轨迹。总的来说,得益于所提出的3D视觉语言预训练模块和跨模态语言模型,设计的模型生成了准确且合理的轨迹。例如,在第一个场景中,当自我车辆被指示直行时,GPVL生成的轨迹引导车辆安全通过城市道路。相反,VAD的轨迹存在与路边发生碰撞的风险。在第三个场景中,GPVL的结果紧密匹配真实情况,使车辆能够在交叉路口安全左转。然而,VAD的规划决策更为激进,可能会导致与迎面而来的车辆发生碰撞。

消融研究

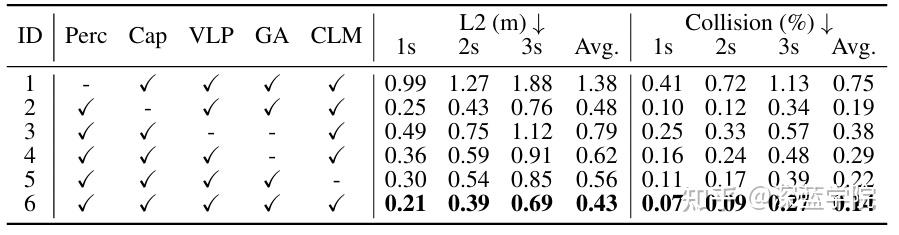

表3中的消融研究系统地探讨了GPVL的关键组件在nuScenes数据集上的贡献。没有感知模块时,GPVL在检测前景物体、预测运动和构建地图方面遇到困难,导致L2和碰撞(Collision)分数升高。禁用视觉语言预训练(VLP)和组对齐(GA)组件显著降低了性能,突显了模型在连接视觉和语言理解方面的强大能力。缺少GA会导致明显的性能下降,表明其在细粒度特征关联中的重要性。排除跨模态语言模型(CLM)会增加L2和碰撞分数,强调了其在生成合理规划决策方面的作用。最后,如表3第六行所示,所有模块的集成产生了最佳性能,展示了各组件协同作用的效果。

零样本泛化

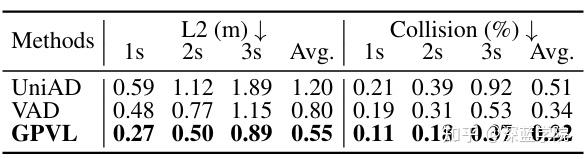

为了验证模型的泛化能力,我们在来自两个不同城市环境(即波士顿和新加坡)构建的数据集上训练并测试模型。具体来说,引入了两组实验:(1) 在波士顿数据集上训练并在新加坡数据集上测试;(2) 在新加坡数据集上训练并在波士顿数据集上测试。如表4所示,GPVL在这两组中的评估得分明显优于UniAD和VAD。

此外,为了验证GPVL的鲁棒性,我们在测试图像中引入了四种类型的噪声(即雨、雾、雪和黑暗)。如表5所示,在这些噪声条件下,UniAD和VAD受到了显著的负面影响,而对GPVL的影响较小。因此,GPVL在各种实际场景中的出色表现展示了其提高自动驾驶系统鲁棒性和安全性的能力。

05 结论与未来工作

本研究提出了一种新颖的3D视觉语言模型的生成式规划方法,用于端到端自动驾驶。该方法设计了3D视觉语言预训练模块,整合文本信息,建立3D视觉语言关系,并通过组内对齐利用不同表示间的关联,以更好地理解驾驶场景。跨模态语言模型作为生成引擎,基于对齐的特征和导航信息,自回归地生成未来轨迹。GPVL框架不仅提供可靠规划,还展现出良好的泛化能力。在nuScenes数据集上的实验显示,GPVL性能优于现有技术,未来有望推动更安全、可靠的自动驾驶技术发展。

发表回复