近年来,基于强化学习(Reinforcement Learning, RL)的驾驶策略学习方法在自动驾驶领域受到越来越多的关注,并在各种驾驶场景中取得了显著进展。然而,传统的RL方法依赖于手工设计的奖励函数,这不仅需要大量的人力投入,还往往缺乏通用性。为了解决这些局限性,我们提出了VLM-RL,一个将预训练的视觉-语言模型(Vision-Language Models, VLMs)与RL相结合的统一框架,用于通过图像观测和自然语言目标生成奖励信号。VLM-RL的核心是将对比语言目标(Contrasting Language Goal, CLG)作为奖励,利用正面和负面的语言目标生成语义奖励信号。此外,我们引入了一种层次化的奖励合成方法,将基于CLG的语义奖励与车辆状态信息相结合,从而提升奖励的稳定性并提供更全面的奖励信号。同时,采用批量处理技术优化了训练过程中的计算效率。我们在在CARLA模拟器中进行了大量实验,结果表明,VLM-RL优于最新的基线方法,使碰撞率降低10.5%、路线完成率提高104.6%,并且在未见过的驾驶场景中表现出强大的泛化能力。此外,VLM-RL能够无缝集成几乎所有标准的RL算法,有望革新依赖于手工奖励设计的传统RL范式,并实现持续的性能提升。演示视频和代码可通过以下链接访问: https://zilin-huang.github.io/VLM-RL-website/

介绍

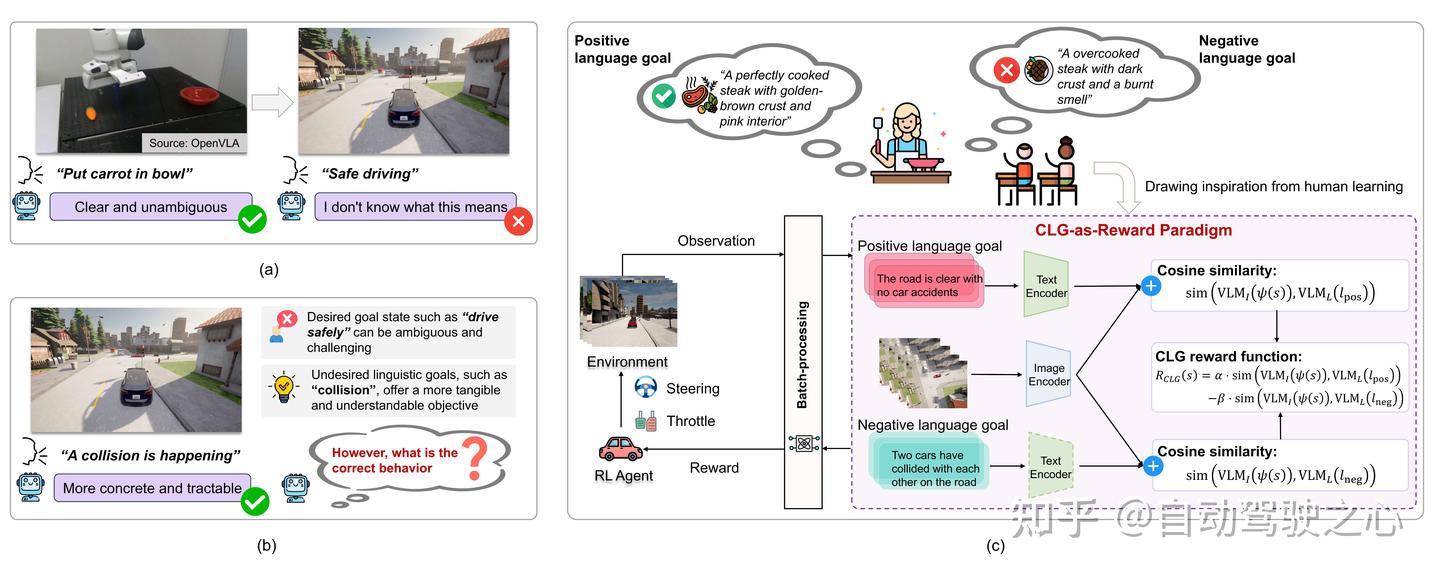

观察人类学习新技能的过程,我们发现,人类通常通过对比示例更有效地学习(图1)。例如,在教授某人如何煎牛排时,导师通常会强调正确和错误的技巧:“完美煎制的牛排应具有金黄酥脆的外壳和均匀粉红的内部”,与“如果牛排完全变成深棕色并伴有烧焦的气味,则表示煎过火了”。这种方式帮助学习者通过识别期望和不期望的结果,全面理解正确的烹饪技巧。

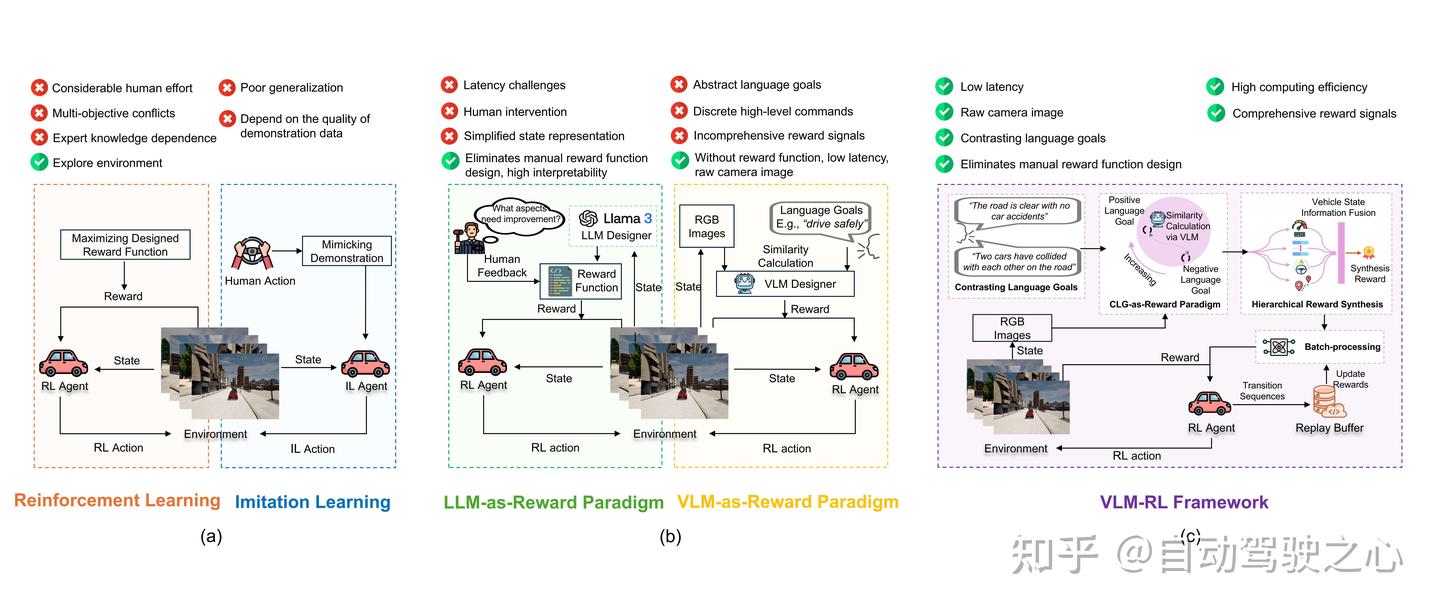

受到人类学习过程的启发,我们提出了一个整合预训练视觉语言模型与在线强化学习的统一框架,称为 VLM-RL,如图2所示。VLM-RL 从根本上重新思考了基础模型如何融入基于 RL 的自动驾驶系统中。我们首先引入了对比语言目标的概念,用于指导基于 RL 的安全驾驶任务。在此基础上,我们提出了一种新的 CLG-as-Reward范式,利用 CLG 生成更具信息性和上下文感知的奖励信号。

为了增强学习的稳定性,我们采用了一种层次化奖励合成方法,将基于 CLG 的奖励与车辆状态信息相结合。这些合成的奖励随后被集成到标准 RL 中进行策略训练。此外,我们还引入了批量处理技术,以提高训练过程中的计算效率。

据我们所知,VLM-RL 是自动驾驶领域中首个将视觉语言模型与强化学习相结合,用于在 CARLA 模拟器中进行端到端驾驶策略学习的研究工作。

方法

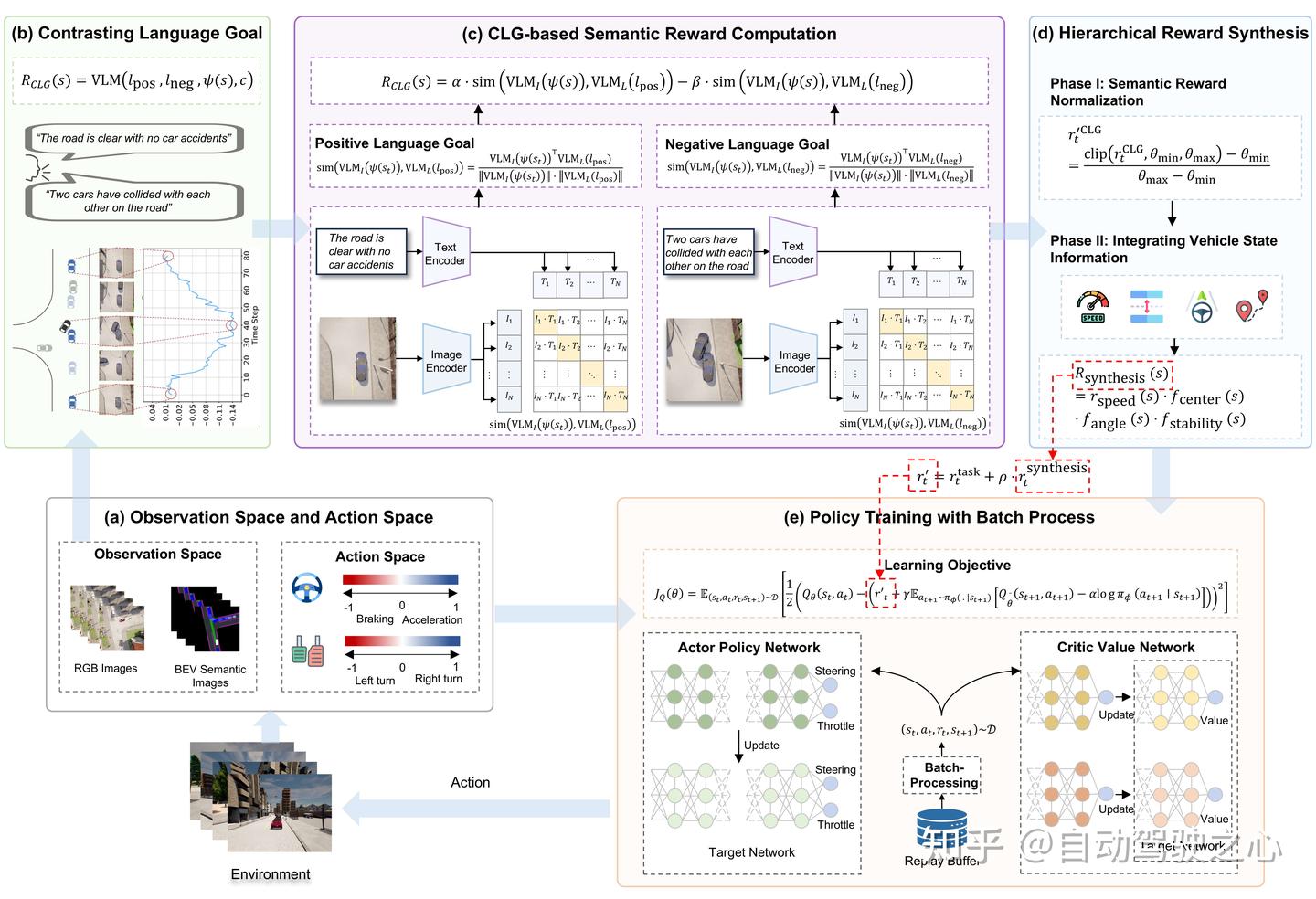

如图3所示,VLM-RL 框架由四个主要组件组成。首先,我们定义了对比语言目标的概念,该目标描述了期望和不期望的驾驶行为,为奖励计算提供了基础。其次,我们利用 CLIP 来计算当前驾驶状态与这些对比语言描述之间的语义对齐程度,从而生成语义奖励信号。第三,我们开发了一种层次化的奖励合成方法,将语义奖励与车辆状态信息(例如速度、航向角)相结合,以生成稳定且全面的奖励信号。第四,为了优化计算效率,我们实现了一种批量处理技术,该技术通过定期处理来自回放缓冲区的观测数据,而不是实时计算奖励来提高训练效率。

对比语言目标

实验和结果

评价指标

为了全面评估我们的自动驾驶系统在性能和安全性方面的表现,我们采用了多种定量指标来评估驾驶效率和安全特性。在驾驶效率评估方面,我们测量了车辆在整个测试过程中保持的平均速度(AS)、单次测试中成功完成的路线数(RC)以及车辆在每次测试中累计行驶的总距离(TD)。

安全性能通过多个互补指标进行评估。基础碰撞率(CR)用于衡量包含碰撞事件的测试比例。我们进一步通过两个频率指标分析碰撞模式:基于时间的碰撞频率(TCF),即每1000个时间步长发生的碰撞次数,以及基于距离的碰撞频率(DCF),即每行驶一公里发生的碰撞次数。为评估碰撞严重程度,我们记录了每次碰撞时的碰撞速度(CS)。此外,我们跟踪记录了碰撞间隔时间步长(ICT),即连续碰撞事件之间的平均时间步数,从而深入了解安全事故的时间分布。在测试阶段,我们还报告了成功率(SR),用于评估模型在10条预定义路线中成功到达目的地的能力。

训练效果比较

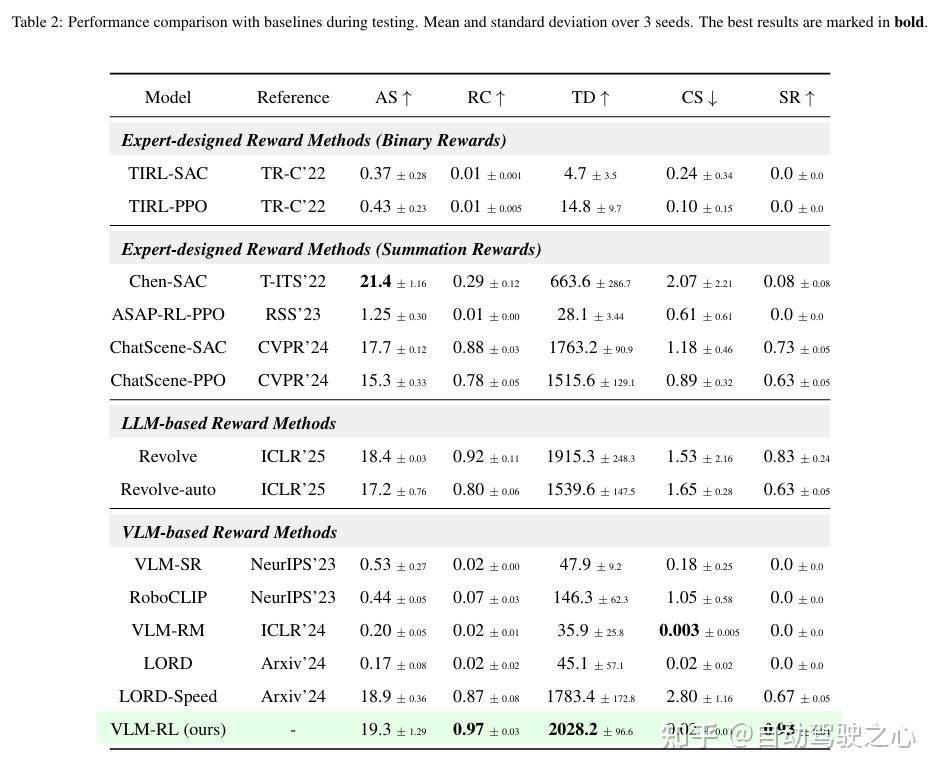

为了进一步验证 VLM-RL 的有效性,我们在 10 条预定义路线中进行了全面的测试评估,并将其性能与基线方法进行了比较。路线完成率表示每次评估中平均的路线完成率。表 2 的测试结果表明,与基线方法相比,我们的方法具有显著的优势。

在测试阶段,二元奖励方法的局限性依然明显。TIRL 变体的路线完成率仅为 0.01,总行驶距离分别为 4.7 米和 14.8 米,证实了它们无法学习有意义的驾驶行为。在具有加权求和项的专家设计奖励方法中,Chen-SAC 保持了最高的平均速度 21.4 km/h,但其成功率仅为 0.08,路线完成率为 0.29,表明其激进的驾驶风格降低了任务成功率。ChatScene 变体表现出更均衡的性能,成功率分别为 0.73 和 0.63,但其碰撞速度分别为 1.18 km/h 和 0.89 km/h,显示出潜在的安全隐患。

基于 LLM 的方法在测试中具有竞争力,Revolve 的成功率达到 0.83,路线完成率为 0.92。然而,其碰撞速度为 1.53 km/h 和 1.65 km/h,表明仍存在安全问题。大多数基于 VLM 的方法,包括 VLM-SR、RoboCLIP、VLM-RM 和 LORD,表现出极为保守的行为,其路线完成率均低于 0.07,成功率为 0.0。LORD-Speed 的效率指标显著提高,但记录了所有方法中最高的碰撞速度 2.80 km/h。

相比之下,VLM-RL 在测试期间所有关键指标上都表现出卓越的性能。它保持了 19.3 km/h 的高平均速度,同时记录了 0.02 km/h 的低碰撞速度,与最保守的方法安全性相当。最值得注意的是,VLM-RL 实现了最高的成功率 0.93 和路线完成率 0.97,以及最长的总行驶距离 2028.2 米。这些结果表明,我们的方法不仅能够学习更有效的驾驶策略,还表现出更好的测试场景泛化能力。在效率和安全性指标上取得的显著改进验证了基于 CLG 和分层奖励设计的方法在提供全面且平衡的学习信号以实现安全驾驶任务中的有效性。

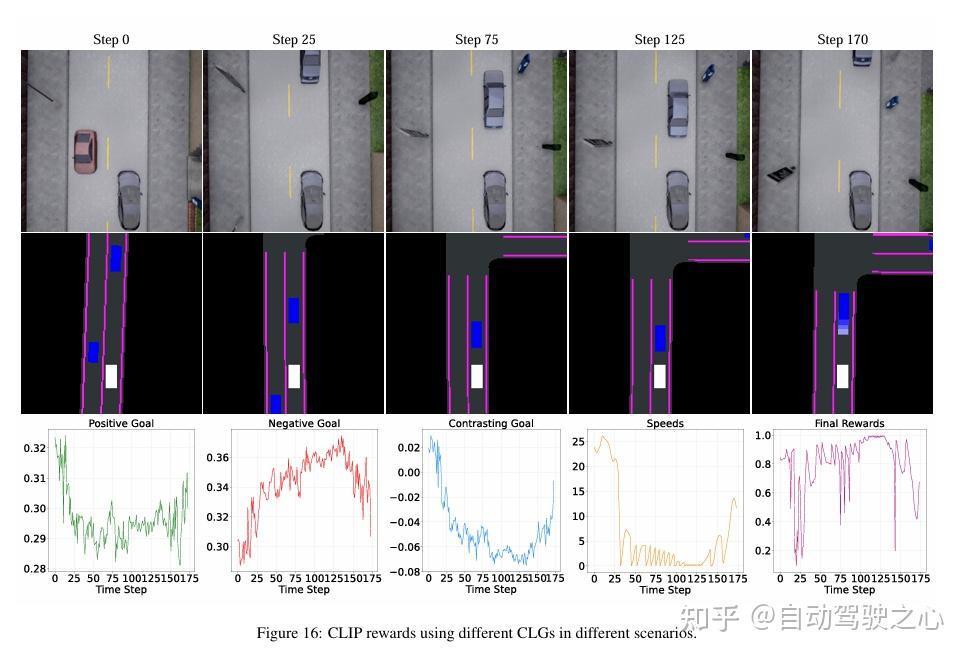

可视化

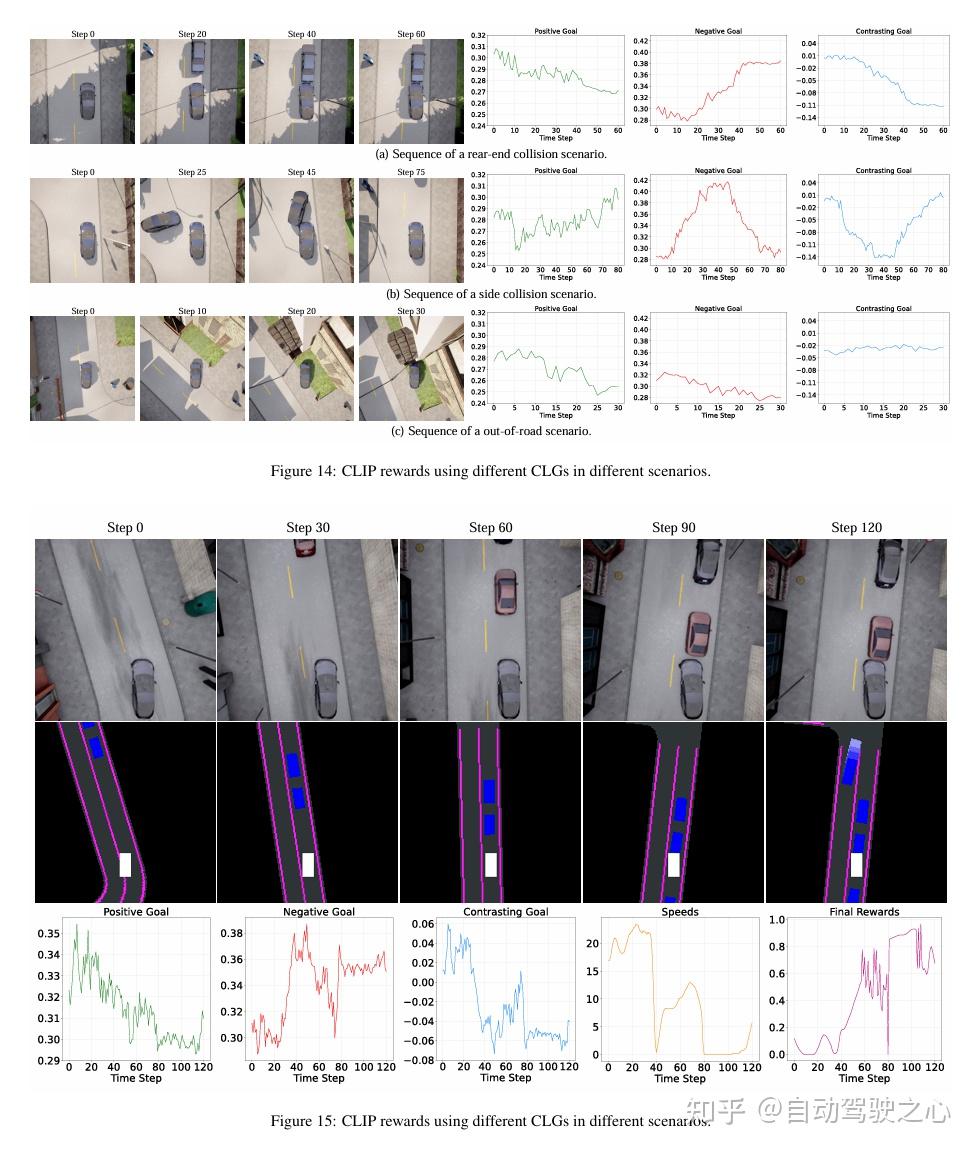

为了更好地理解基于 CLIP 的语义奖励的效果和局限性,我们可视化了三个具有代表性的失败案例,并分析了正目标、负目标和 CLG 如何捕获不同的驾驶行为。如图 14 所示,我们展示了图像序列及其对应的语义相似度分数在三种挑战性场景中的变化。

在图1 4(a) 展示的追尾碰撞场景中,我们观察到,当自车逐渐接近前车时,正目标的相似度分数逐渐下降,而负目标的相似度分数逐渐上升。这种模式与我们的设计意图一致:不安全行为应导致较低的正目标相似度和较高的负目标相似度。最终的对比得分显示出明显的下降趋势,正确反映了追尾碰撞行为的不理想性质。

图 14(b) 展示的侧面碰撞案例揭示了另一个有趣的模式。在第 30 到第 45 步的碰撞期间,正目标的相似度并未显著下降,这表明 VLM 有时难以单独通过正目标捕捉安全违规行为。然而,负目标的相似度在碰撞期间表现出显著的峰值,导致对比得分出现适当的下降,从而正确惩罚了该不安全行为。

图14(c) 展示的偏离道路场景突出了纯基于 VLM 的语义奖励的局限性。随着车辆偏离道路,正目标相似度下降的同时,负目标相似度也呈现下降趋势。这导致对比得分相对平稳,未能充分惩罚偏离道路的行为。这一局限性源于我们的语言目标主要聚焦于与碰撞相关的行为,而未明确考虑道路边界违规。

这些观察结果揭示了基于 VLM 的语义奖励的潜力和局限性。尽管 CLG 能有效捕获许多不安全行为,但在某些场景下可能无法提供适当的学习信号,特别是那些未在语言目标中明确描述的场景。这突显了我们分层奖励合成方法的必要性,通过结合高层语义理解与低层车辆状态信息,提供更全面且可靠的奖励信号。

结论

本文提出了 VLM-RL,一个将预训练视觉-语言模型(VLMs)与强化学习(RL)相结合的统一框架,用于安全自动驾驶。本研究的主要贡献在于通过利用 VLMs 的语义理解能力,解决了奖励设计的挑战。具体而言,我们提出了对比语言目标(CLG)作为奖励的范式,利用正目标和负目标生成语义奖励。同时,我们引入了一种分层奖励合成方法,将基于 CLG 的奖励与车辆状态信息结合,提升了奖励的稳定性,并提供了更全面的学习信号。为缓解计算挑战,我们采用了一种批处理技术,实现了训练过程中的高效奖励计算。

在 CARLA 仿真器中进行的大量实验验证了 VLM-RL 的有效性。与最先进的基线方法相比,VLM-RL 在安全性、效率和对未见驾驶场景的泛化能力上实现了显著提升。特别是,VLM-RL 将碰撞率降低了 10.5%,路线完成率提高了 104.6%,并在多样化交通环境中展现出稳健的性能。这些结果验证了将 VLMs 与 RL 相结合的潜力,为开发更加可靠且具备上下文感知能力的自动驾驶策略提供了新途径。

发表回复