原文链接:https://zhuanlan.zhihu.com/p/1969077910980789203

大家好,我是CV君。今天想和大家聊一篇非常“接地气”的论文,它关乎于让AI智能体(比如自动驾驶汽车、无人机和机器狗)真正理解我们生活的3D世界。这项工作来自香港科技大学、新加坡南洋理工大学、新加坡国立大学、复旦大学以及上海人工智能实验室的学者们,他们共同推出了一个名为 3EED 的全新基准数据集。

3EED,全称是“Ground Everything Everywhere in 3D”,意为“在3D世界中定位万物”。这个名字非常直白地揭示了它的雄心:构建一个能让AI在各种复杂户外场景下,通过自然语言指令精准找到目标物体的“终极考场”。

想象一下,你对一个机器人说:“去找到那辆停在两辆黑色汽车中间的白色轿车。”要完成这个任务,机器人不仅要“看懂”摄像头和激光雷达传来的数据,还要理解“中间”、“白色”这类描述,并最终在三维空间中锁定目标。这就是“3D视觉定位”(3D Visual Grounding)技术,它是实现高级人机交互和自主导航的关键。

然而,之前的研究大多局限在室内环境,或者只使用单一平台(比如汽车)的数据,规模也有限。这就像一个学生只在教室里做题,却要应对野外生存挑战一样,能力远远不够。

为了解决这个问题,3EED应运而生。

- 论文标题: 3EED: Ground Everything Everywhere in 3D

- 作者: Rong Li, Yuhao Dong, Tianshuai Hu, Ao Liang, Youquan Liu, Dongyue Lu, Liang Pan, Lingdong Kong, Junwei Liang, Ziwei Liu

- 机构: 香港科技大学(广州)、新加坡南洋理工大学、香港科技大学、新加坡国立大学、复旦大学、上海人工智能实验室

- 录用会议: NeurIPS 2025 Datasets and Benchmarks Track

- 论文地址: https://arxiv.org/abs/2511.01755

- 项目主页: https://project-3eed.github.io/

- 代码仓库: https://github.com/iris0329/3eed

3EED:一个前所未有的跨平台3D“大百科全书”

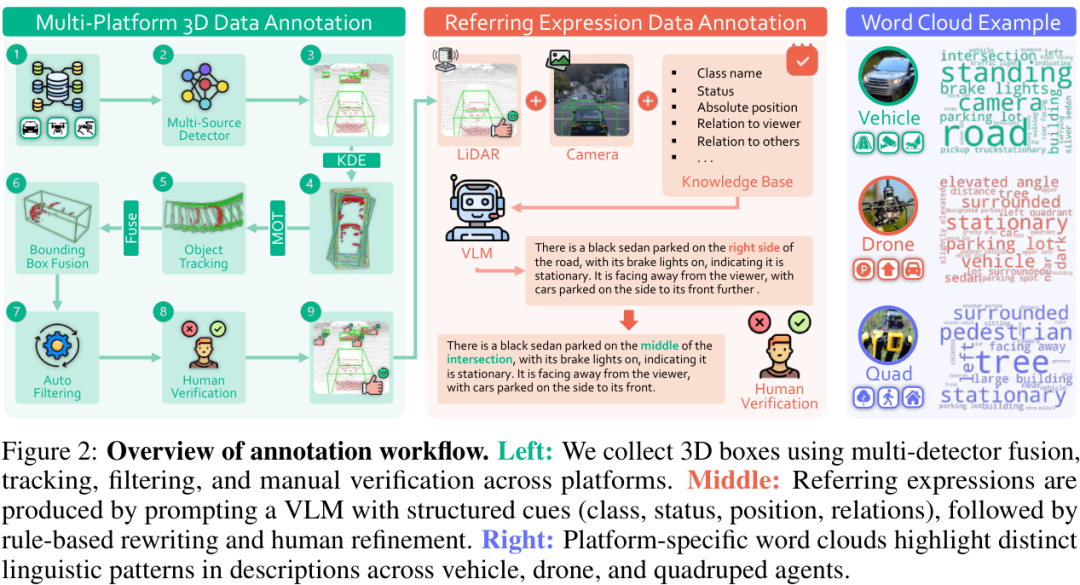

相较于以往的数据集,3EED的突破是全方位的。作者们将它的优势总结在了下面这张表格中,可以看到,无论是在平台多样性、场景覆盖范围还是数据规模上,3EED都遥遥领先。

具体来说,3EED的核心亮点包括:

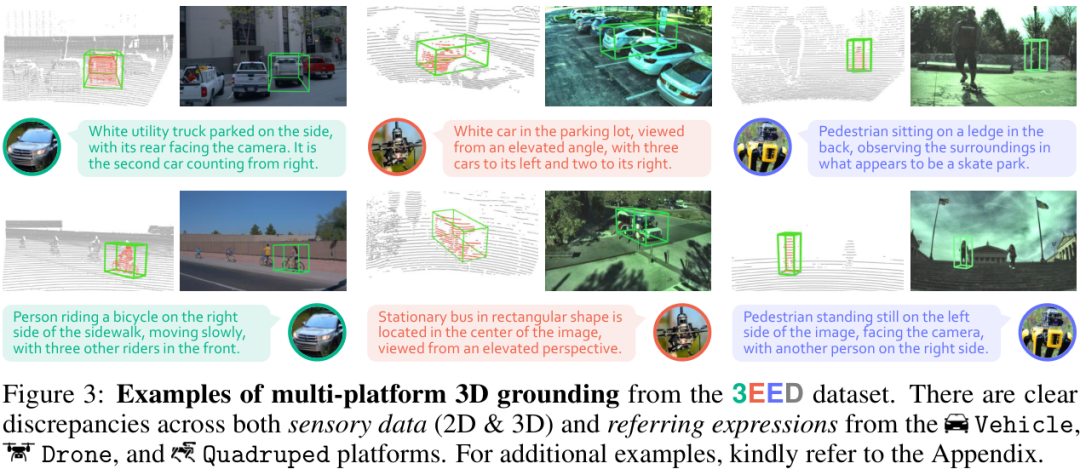

从下图中可以直观地感受到不同平台带来的数据差异。无论是传感器捕捉到的画面,还是描述物体的语言习惯,都截然不同。例如,无人机视角更倾向于描述物体在画面中的象限位置,而机器狗视角则更关注近距离的互动。

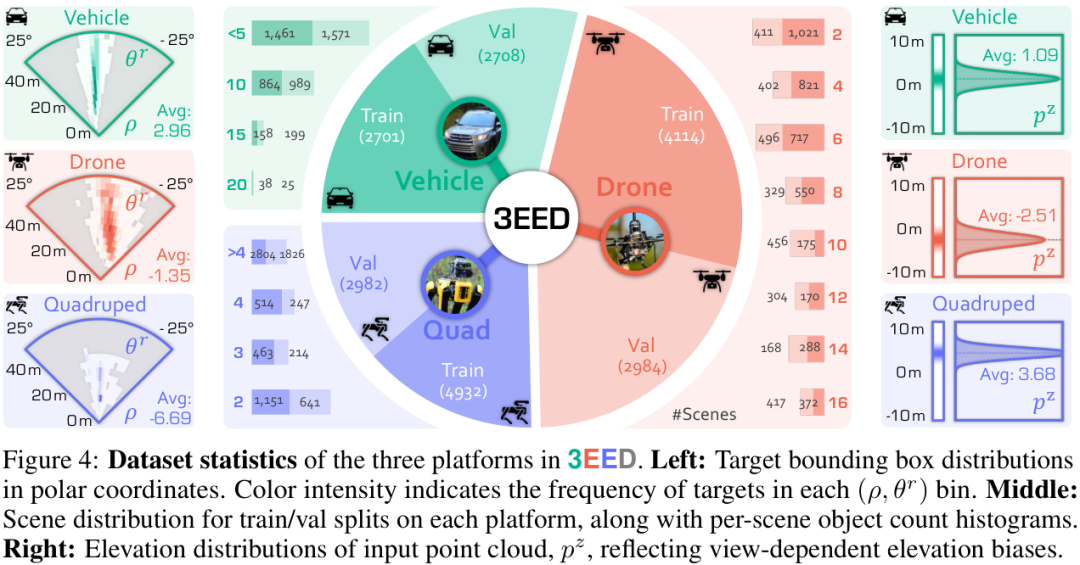

数据集的统计分析也进一步揭示了平台的差异性。例如,无人机采集的场景通常物体更密集,但点云更稀疏;而汽车采集的数据点云密度最高。这些差异为研究模型的鲁棒性和泛化能力提供了绝佳的试验场。

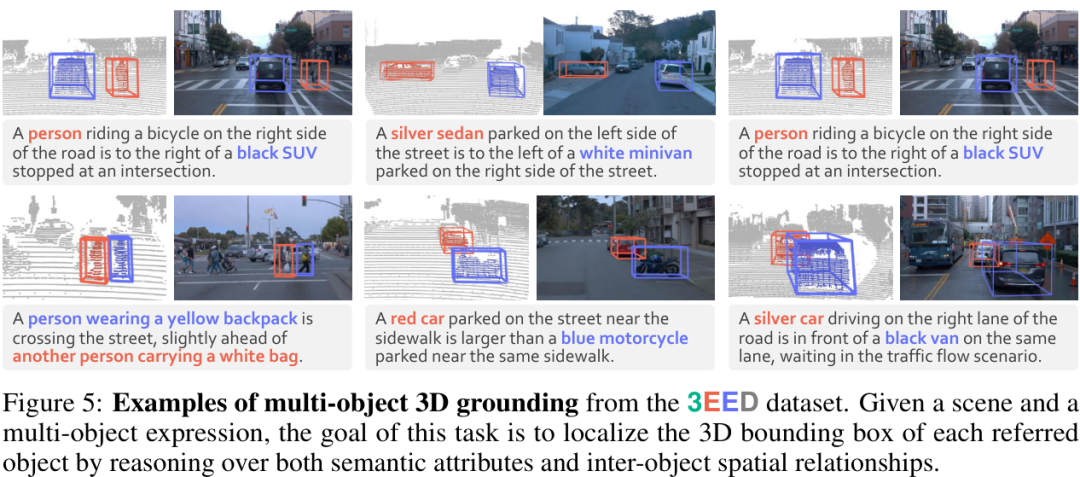

此外,3EED还支持更复杂的 多目标定位 任务,即一句话可能提到多个物体,模型需要将它们全部找出来。

为跨平台学习设计的基准模型

仅仅提供数据集是不够的,为了方便后续研究,作者还提出了一个统一的跨平台基准模型。这个模型针对3EED的特性,设计了几个关键模块来应对挑战:

- 跨平台对齐(Cross-Platform Alignment, CPA): 这是一个简单而有效的预处理步骤。通过将所有平台的点云数据旋转到统一的重力方向,并对无人机数据进行高度归一化,可以减少由不同视角带来的几何偏差。这样,模型就无需花费额外的精力去“纠正”姿态,可以更专注于理解内容。

- 多尺度采样(Multi-Scale Sampling, MSS): 户外场景的物体尺寸和距离变化极大,近处的交通锥和远处的卡车对感受野的要求完全不同。MSS允许模型在多个尺度上(从0.6米到4.8米)同时提取特征,确保无论是近处的小物体还是远处的稀疏目标,都能被有效捕捉。

- 尺度感知融合(Scale-Aware Fusion, SAF): 在MSS的基础上,SAF模块通过一个轻量级的网络动态地为每个点分配不同尺度的权重,然后将它们融合成一个统一的特征表示。这使得模型可以“智能地”选择最合适的尺度来分析局部几何,从而更好地适应不同平台带来的密度变化。

实验结果:挑战与机遇并存

有了新“考场”和新“考生”,结果如何呢?

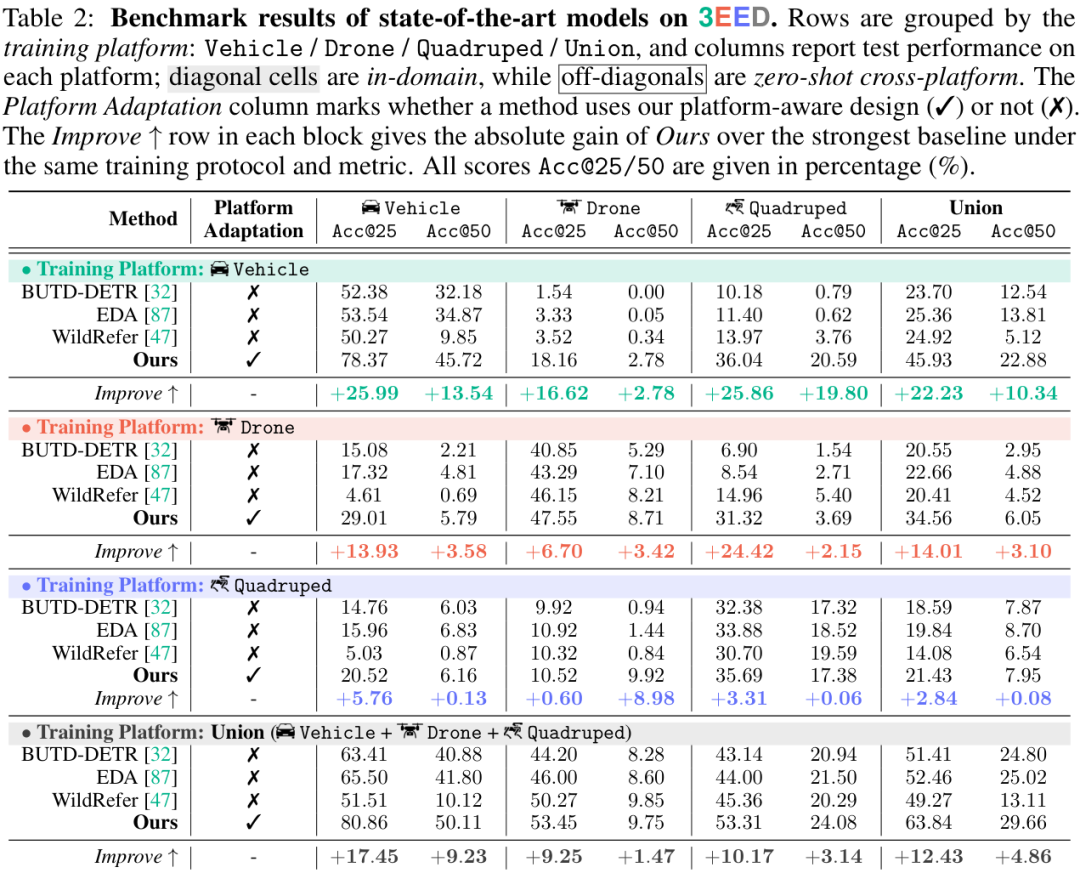

实验结果(如下表所示)揭示了一个严峻的现实:现有模型在跨平台泛化方面存在巨大鸿沟。例如,一个在汽车数据上训练得很好的模型(在汽车测试集上Acc@25达到53.54%),直接拿到无人机数据上测试时,性能会暴跌至 3.33%。这充分说明了跨平台3D定位的巨大挑战。

然而,好消息是,作者提出的基准模型(Ours)在所有设定下都显著优于之前的SOTA方法。特别是在使用 平台自适应(Platform Adaptation) 设计后,性能提升巨大。例如,在汽车数据上训练时,Ours的Acc@25达到了 78.37%,比之前的最佳模型提升了 25+个百分点。当在所有平台的联合数据上训练时,Ours模型也取得了最佳的综合性能,证明了3EED多样化数据对于训练通用模型的重要性。

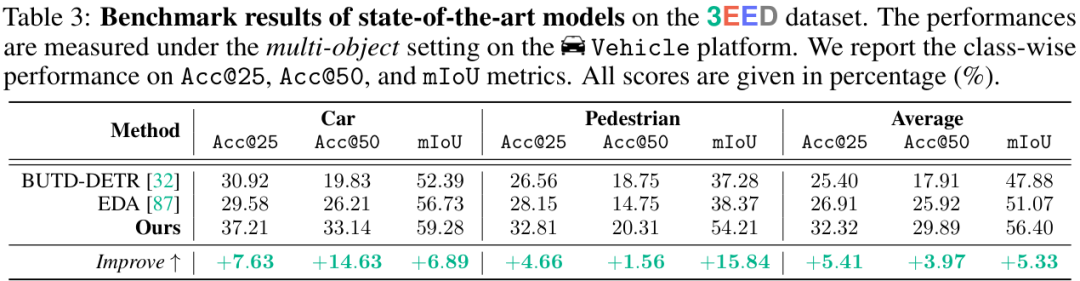

在更具挑战性的多目标定位任务上,Ours模型同样表现出色,在各项指标上都取得了SOTA性能。

消融实验

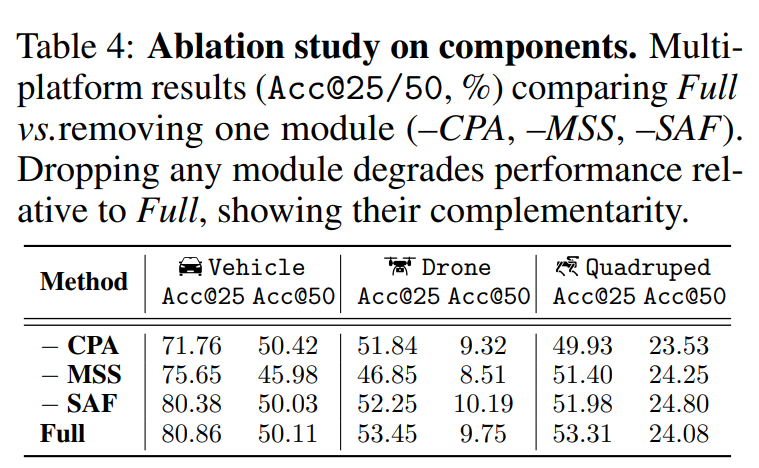

消融实验也证明了CPA、MSS和SAF每个模块的有效性和互补性。去掉任何一个模块都会导致性能下降。

定性结果

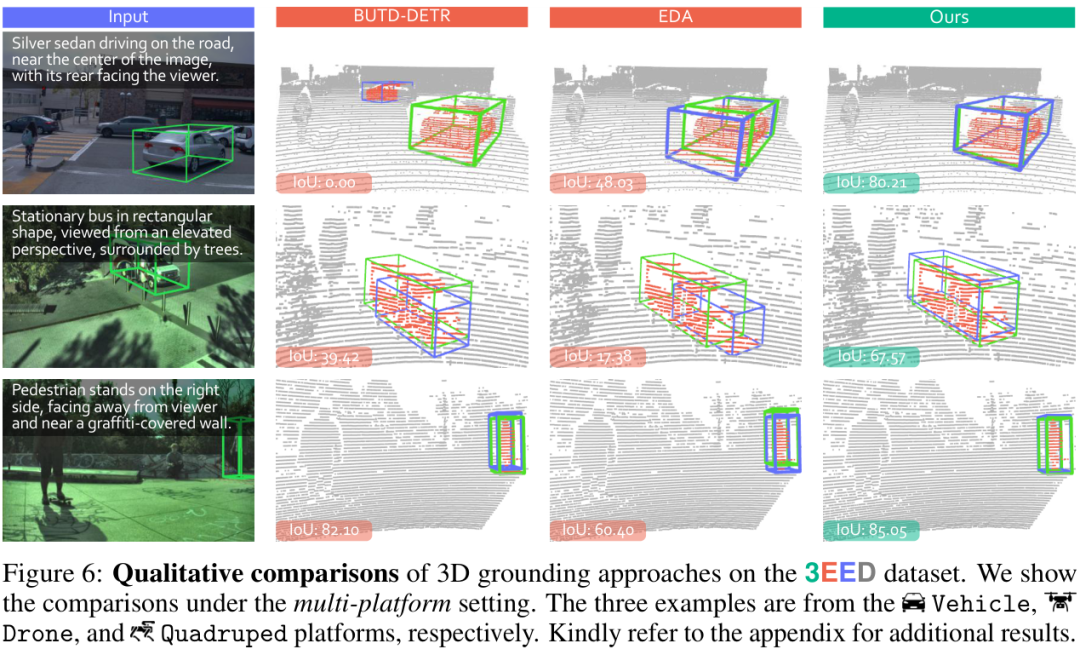

从定性结果对比中可以更直观地看到,无论是在汽车、无人机还是机器狗的视角下,Ours模型都能给出更精准、更贴合的定位结果。

总结

CV君认为,3EED数据集的发布,对于推动3D感知、具身AI和人机交互领域的发展具有里程碑式的意义。它不仅暴露了现有技术的短板,也为未来的研究指明了方向。作者已经开源了数据集和代码,强烈建议感兴趣的同学去探索一番。

发表回复